Fraud 2.0: как боты становятся умнее и что с этим делать

Привет, это Adlook!

Верите ли вы в теорию мёртвого интернета?

Для тех, кто слышит о ней впервые, коротко объясним суть. Теория появилась несколько лет назад, и её сторонники считают, что интернет постепенно захватывают боты и нейросети. Уже сейчас значительная часть контента создаётся искусственным интеллектом и публикуется обученными ИИ-агентами. Боты отвечают на комментарии, оставленные другими ботами, а доля человеческого контента стремительно сокращается.

Звучит как чистой воды конспирология, не так ли? Возможно. Но не спешите с выводами. В интернете есть исследования, которые заставляют задуматься.

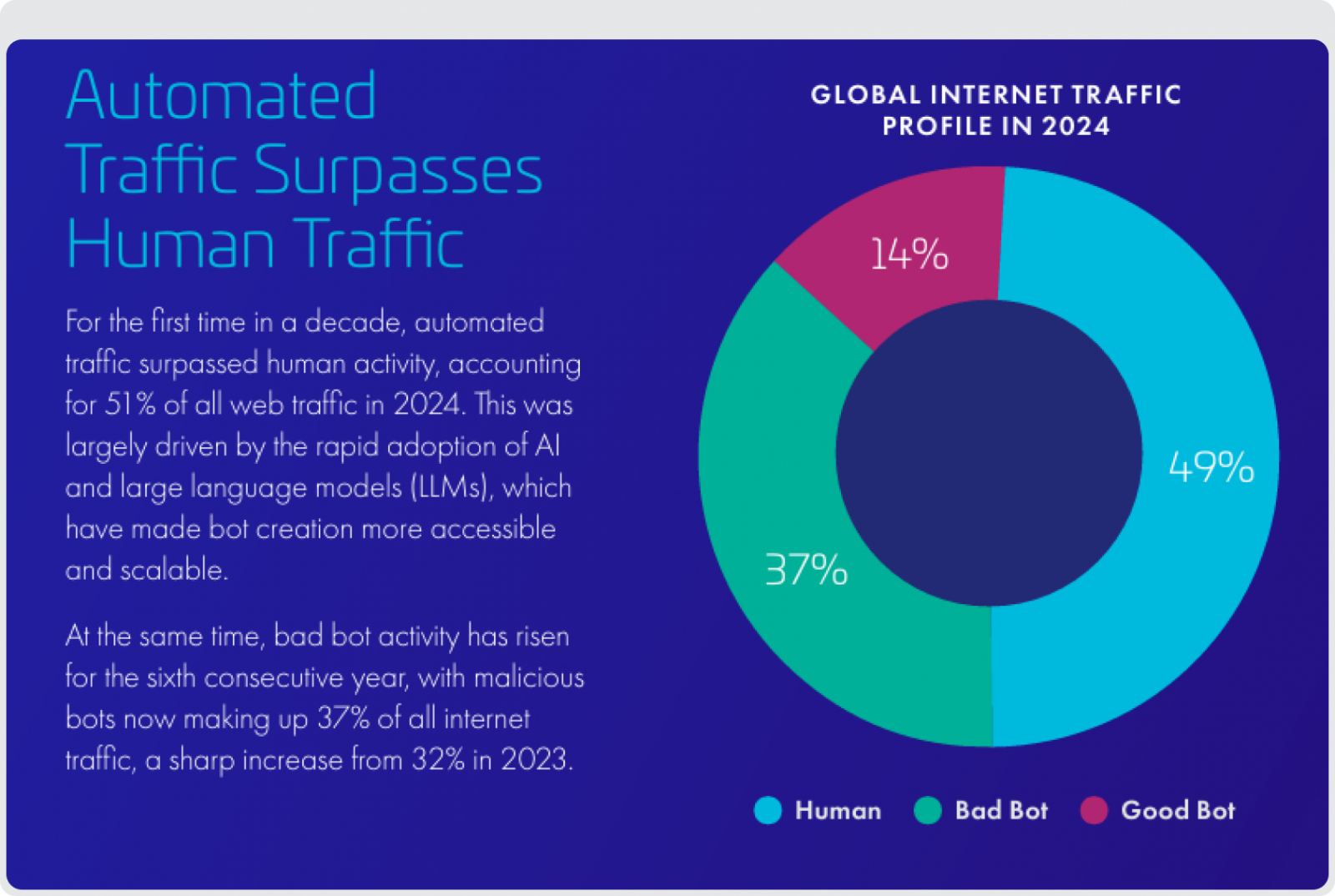

Если обратиться к отчёту компании Imperva, в 2024 году произошёл переломный момент: более половины интернет-трафика (а именно 51%) сгенерировали боты, а не реальные пользователи.

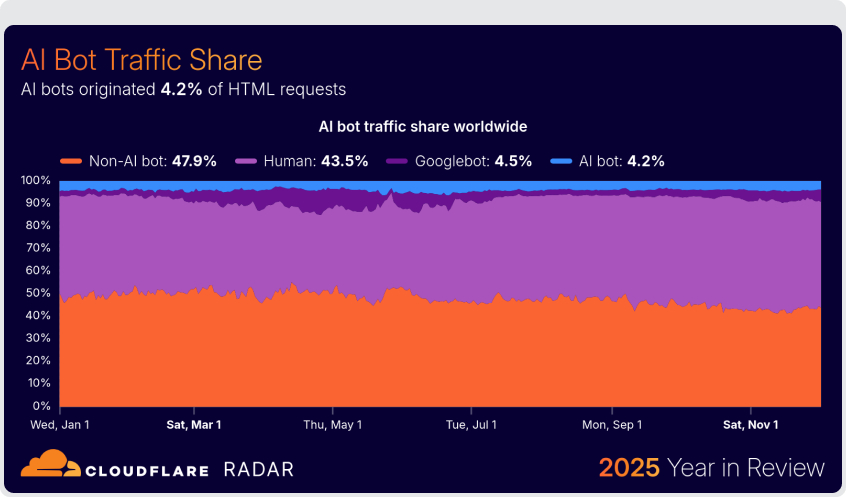

При этом со временем разрыв между миром людей и ботов продолжает расти. Если в 2024 году доля автоматизированного трафика лишь немного превысила человеческий, то в 2025 разница стала ещё заметнее: на долю ботов приходится уже 56,5% трафика, тогда как на долю людей — 43,5% (по данным Cloudflare).

Что тревожит ещё сильнее: значительную часть бот-трафика составляют вредоносные боты. Те самые, которые ежедневно наносят ущерб владельцам сайтов: скликивают рекламу, крадут личные данные, перегружают серверы. Развитие ИИ дало им дополнительный импульс. Современные боты умеют имитировать поведение реальных людей, обходить продвинутые алгоритмы защиты и маскироваться под обычные сессии.

Если вы когда-нибудь замечали странные всплески трафика без видимых причин, резкое падение конверсии или подозрительную активность — вполне возможно, на вашем сайте уже хозяйничают боты. А если подобных признаков пока нет — всё равно стоит быть готовым к «незваным гостям» и понимать, как их вовремя обнаружить и прогнать.

В этой статье мы расскажем:

- почему боты сегодня — это серьёзная проблема;

- как современные боты обходят защиту и маскируются под людей;

- что можно сделать, чтобы защитить сайт — рассмотрим как базовые меры, так и продвинутые инструменты.

Почему бот-трафик — это проблема

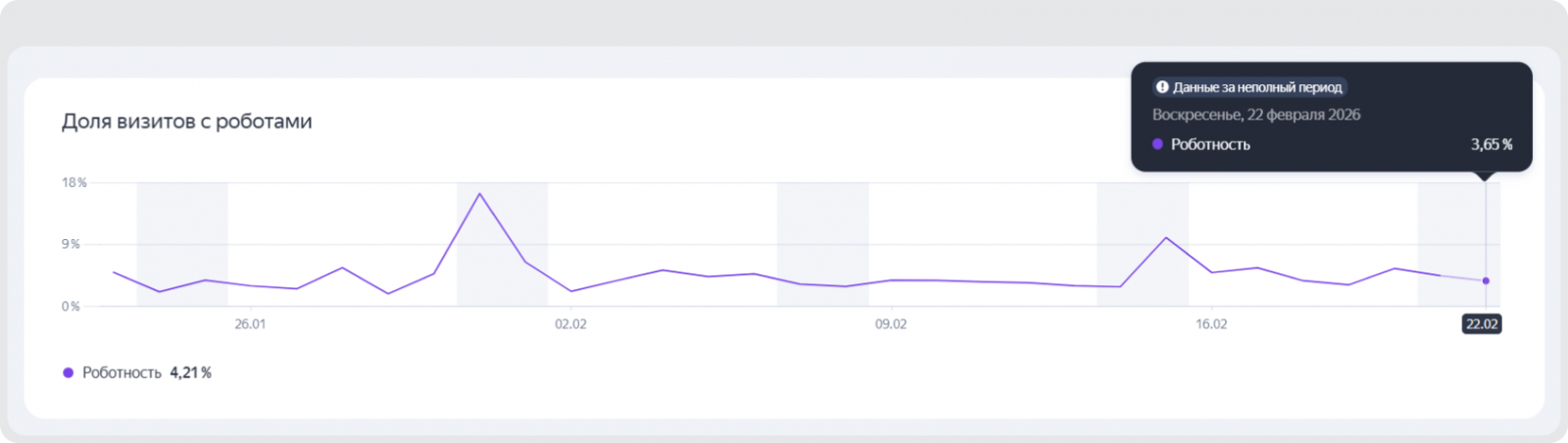

Чтобы понять масштаб проблемы, достаточно заглянуть в отчёты Яндекс Метрики и посмотреть долю роботного трафика. В нормальных условиях процент ботов на сайте обычно не превышает 5–15%. Это нормальные показатели, и стремиться к нулю здесь не нужно. Cайт обязательно должны посещать полезные боты:

- роботы индексации — благодаря им ваш сайт появляется в выдаче Google, Yandex, Bing и других поисковых систем;

- мониторинговые боты — они проверяют работоспособность сервера и скорость загрузки страниц, а в случае сбоев или падения сайта уведомляют владельца;

- пользовательские чат-боты — если они работают не внутри сайта, а по API или через внешние интеграции.

Однако когда процент бот-трафика превышает 15–30% и появляются явные признаки вредоносной активности, тогда и начинаются проблемы.

Риски безопасности

Кибератаки — это не мифические угрозы. Если в фильмах хакеры взламывают Пентагон или что-то покруче, то в реальности под прицел попадают тысячи обычных сайтов.

Цели злоумышленников могут быть самыми разными:

- они могут пытаться получить доступ к админке, используя брутфорс для подбора паролей;

- если им это удастся, они попробуют украсть чувствительные данные пользователей (имена, адреса электронной почты, логины и пароли, номера телефонов, платёжные данные);

- впоследствии эти данные могут быть слиты в сеть или проданы в теневом интернете.

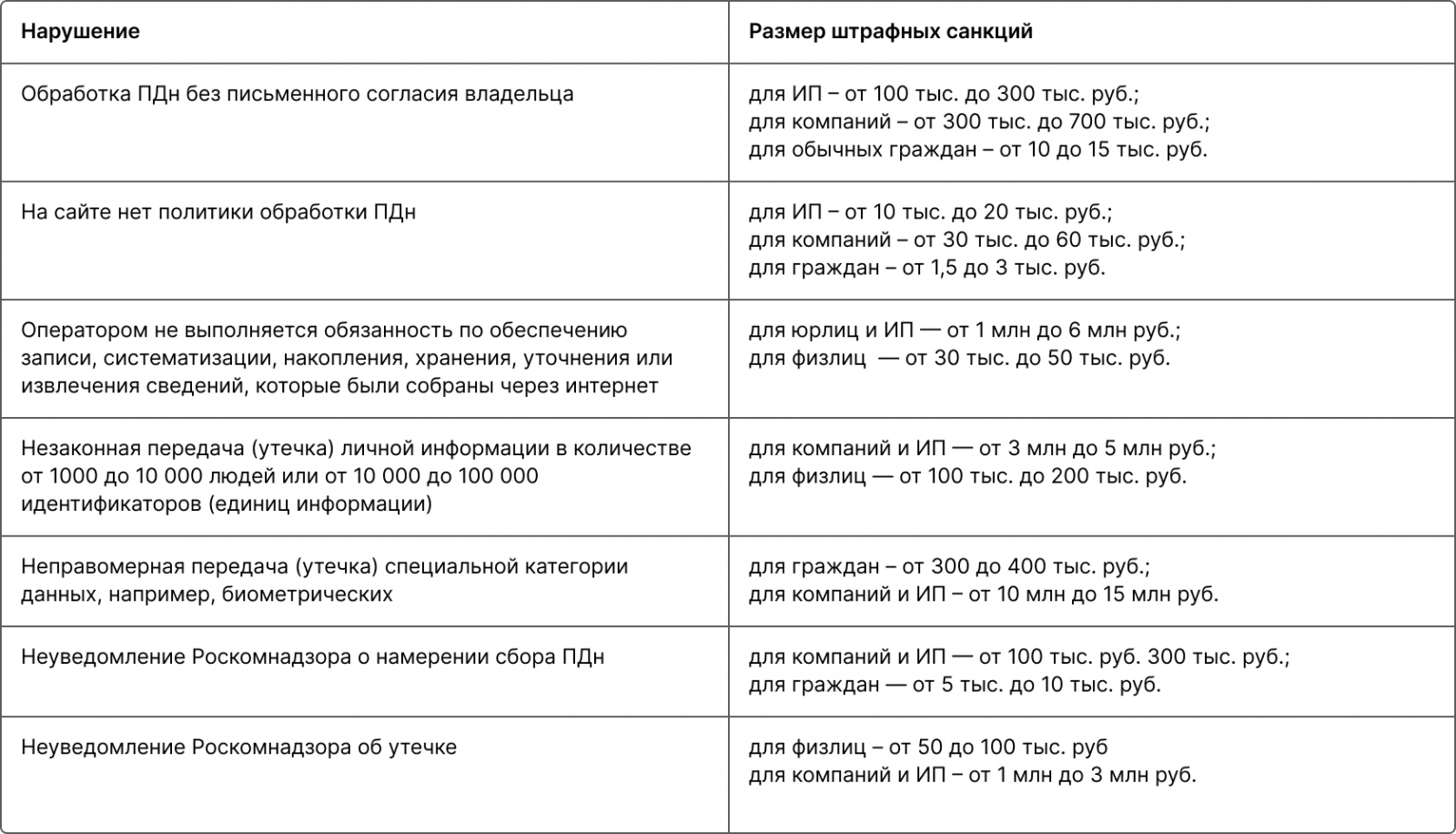

Владелец сайта как оператор ПДн несёт ответственность за сохранность персональных данных, поэтому такой тип атак бьёт больнее всего.

Перегрузка серверов и сбои

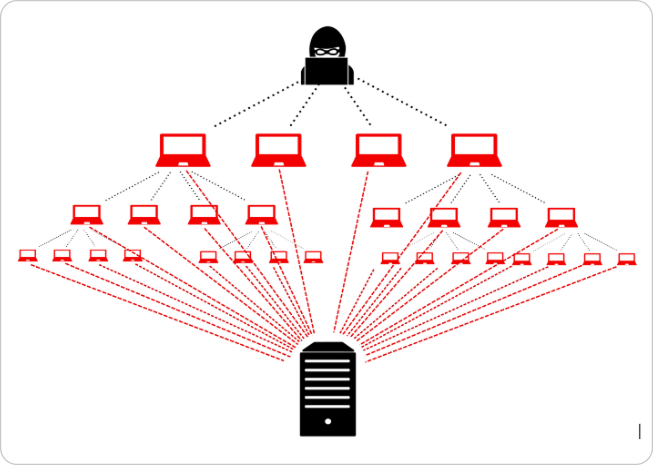

Некоторые сайты подвергаются направленным DDoS-атакам. Их цель — перегрузить инфраструктуру сайта и сделать его недоступным для обычных пользователей.

Ботам не нужно спать и делать перерывы на кофе. Они могут отправлять тысячи запросов к страницам, поиску, API, добавлять сколько угодно товаров в корзину и делать другие повторяющиеся действия.

Если защита слабая:

- растёт нагрузка на сервер;

- сайт начинает тормозить;

- падает доступность или сайт временно «ложится»;

- реальные пользователи не могут зайти на ресурс и уходят.

В ходе DDoS-атаки вы рискуете столкнуться с серьёзным взломом или утечкой данных. Если атака произошла по вашей вине, вы утратите репутацию в глазах клиентов и партнёров. Согласитесь, если люди будут знать, что сайт уже взламывали ранее, вряд ли они снова доверят вам свои логины, пароли и другие данные.

DDoS-атаки особенно болезненно бьют в пиковые периоды: во время распродаж, запусков продуктов, рекламных кампаний. Потери могут исчисляться сотнями тысяч или миллионами рублей, и такие случаи — вовсе не редкость.

Клик-фрод и денежные потери

Если вы покупаете рекламу или монетизируете через неё сайт, то, скорее всего, вы знаете, насколько жёстко рекламные сети относятся к бот-трафику. Сайты с подозрительной активностью не проходят модерацию, а площадки с высокой долей ботов быстро попадают в чёрные списки.

Почему? Всё из-за фрода.

Автоматические программы имитируют клики по объявлениям на веб-сайтах. Формально активность есть и она фиксируется, но фактически живая аудитория этих действий не совершает. В итоге рекламодатели платят за воздух, а когда схема вскрывается, владелец площадки теряет часть дохода или вовсе получает бан за клик-фрод.

Что особенно неприятно, боты-кликеры могут ничем не выдавать себя. Они не кликают 1000 раз за минуту, а распределяют действия по времени, чтобы не вызывать подозрений. Также они могут использовать и другие уловки, чтобы их действия были восприняты как поведение реальных пользователей.

Кража контента и данных

Парсинг — ещё одна, на первый взгляд, незаметная проблема. Формально сам по себе парсинг не нарушает закон, однако на практике он может наносить серьёзный ущерб.

Боты могут копировать:

- карточки товаров;

- цены;

- описания;

- статьи и иной контент;

- структуру страниц.

И дальше использовать это для:

- создания «зеркал»;

- демпинга цен;

- обучения собственных сервисов;

- перепродажи данных.

Представьте, что вы вкладываете ресурсы в контент и развитие проекта, а кто-то забирает себе весь результат за несколько часов. Это нельзя назвать честной конкуренцией, однако именно так сейчас работает рынок. Хорошая новость в том, что защититься от парсинга можно, хоть и сложно.

Искажение аналитики

Для владельца сайта данные — это основа для принятия решений. Вы анализируете трафик, показатели конверсии, поведение аудитории. Но если значительную часть посещений создают боты, картина искажается.

Приведем простой пример.

Представьте, что трафик вырос на 30%, а продажи — нет. Конверсия падает, вы начинаете менять рекламные креативы, тексты на лендинге, перераспределять бюджет, тогда как причина может быть в том, что на сайт заходят не люди, а заскриптованные программы.

Как итог:

- решения принимаются на «грязных» данных;

- ухудшаются поведенческие метрики;

- бюджет расходуется неэффективно.

Именно поэтому важно следить за показателем бот-трафика и вовремя избавляться от любых типов вредоносных ботов.

Как эволюционируют современные боты

Если раньше сайты можно было взломать при помощи простых скриптов, написанных «на коленке», то сегодня почти все CMS имеют как минимум базовую защиту, пробить которую непросто. Именно поэтому владельцы бот-ферм постоянно развивают и дообучают их, а с появлением нейросетей этот процесс стал ещё быстрее и эффективнее. Именно это делает Fraud 2.0 по-настоящему опасным.

Боты научились имитировать поведение человека

Это, пожалуй, главное изменение.

Современные боты всё реже используют одни и те же паттерны действий. Сегодня они умеют:

- менять IP-адреса,

- выдерживать паузы между действиями;

- имитировать движение мыши;

- обрабатывать сложные формы;

- имитировать заходы с разных устройств (мобильных, десктопов).

В общем и целом, их поведение напоминает поведение реальных людей.

Представьте: бот заходит на сайт, читает статью 40 секунд, переходит в каталог, открывает несколько товаров и возвращается назад. В логах мы видим почти идеальную пользовательскую сессию. Если антибот-система проверяет только скорость запросов или их тип — она просто не видит угрозу. Поэтому нужно что-то помощнее.

Боты обходят классические капчи

Заметили ли вы, насколько сложнее стала капча на некоторых сайтах? Часто используется сразу несколько уровней: сначала сессия проверяется незаметно (в фоне или по клику на маленький чекбокс), а затем, если вы вызываете подозрения, вас просят разгадать загадку от Жака Фреско.

Всё это неспроста. Если раньше было достаточно предложить ввести символы с картинки, что вводило ботов в ступор, то сегодня задания стали значительно сложнее — вам предложат собрать пазл, провести слайдер или выбрать изображения с определёнными объектами — велосипедами, светофорами, лодками. Но и это ещё не гарантия защиты.

Боты уже сейчас используют:

- автоматическое распознавание текста с помощью ИИ;

- машинный анализ изображений;

- работают через распределённые сети, из-за чего их активность детектится реже.

И даже это ещё не всё. Если все эти уловки не сработают, владельцы ботов могут просто передать капчу на дешёвые сервисы, где их решают реальные люди за копейки (метод использовался и раньше, но сейчас по-прежнему остаётся рабочим).

Всё это значит, что простая капча, пусть и создаёт дополнительный барьер, но уже работает очень слабо. Будущее — за адаптивной капчей, прохождение которой либо требует много времени и ресурсов, либо становится непосильной задачей для бота.

Боты комбинируют атаки

Раньше бот выполнял одну задачу, например, парсинг или брутфорс.

Теперь одна и та же сеть может:

- проверять украденные логины и пароли,

- создавать фейковые аккаунты,

- кликать по рекламе,

- собирать данные,

- и параллельно нагружать сервер.

Вы видите аномалии, но не всегда сразу понимаете, с чем именно нужно бороться. Время может быть упущено, а последствия становятся серьезными.

Боты учатся на своих ошибках

Вот здесь начинается настоящий Fraud 2.0. Современные боты используют алгоритмы, которые анализируют:

- где и по какой причине их заблокировали;

- на каком этапе сработала защита;

- какие параметры вызвали подозрение.

После этого поведение корректируется. Если скорость запросов была слишком высокой — она уменьшается. Если IP попал в блок — меняется пул адресов. Если капча усложнилась — подключается другой метод обхода.

Это уже не статичный примитивный скрипт, а адаптивная система.

Что это означает для владельца сайта?

Главная проблема не в том, что боты стали умнее, а в том, что старые методы защиты перестали работать. Простая капча, фильтр по IP или базовый WAF уже не дают стопроцентной гарантии. Действия ботов стали больше напоминать поведение реального человека — а значит, и защита должна быть сложнее, поведенческой и многослойной.

Как защититься от бот-атак

Важно понимать: нет одной «волшебной кнопки», которая решит сразу все проблемы безопасности. Работает только комплексный подход. Один инструмент можно обойти. Несколько уровней защиты — уже гораздо сложнее.

Давайте разберем, что какие шаги действительно могут помочь.

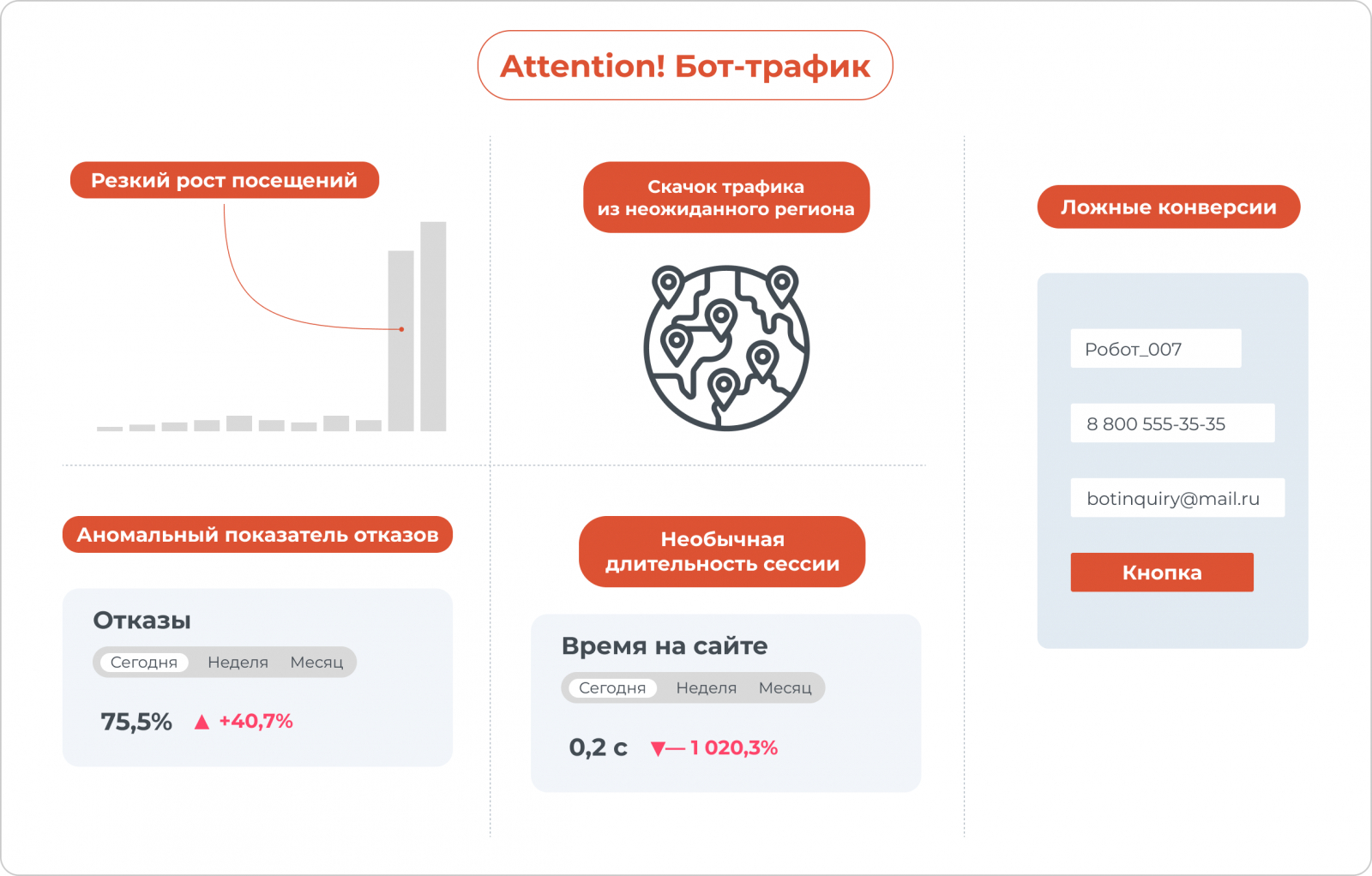

1. Следите за трафиком и логами

Иногда атака заметна не сразу. Но есть явные тревожные сигналы:

- резкий рост посещений;

- трафик из нетипичных регионов;

- аномальный рост показателя отказов;

- странные поведенческие метрики;

- появление ложных конверсий.

Чтобы вовремя заметить бот-трафик, старайтесь анализировать серверные логи и регулярно заглядывать в системы аналитики, например, в Яндекс Метрику. Если всё в порядке, значит защита справляется на «отлично», и пока ничего менять не нужно. Но как только вы заметите типичные признаки появления ботов на сайте — значит, пора принимать меры.

2. Используйте современные антибот-системы

Если на сайте до сих пор стоит только базовая капча и фильтр от CMS — этого уже недостаточно. Лучше использовать специализированные решения, которые:

- анализируют трафик по множеству параметров (смотрят поведение пользователя в сессии, частоту и последовательность действий, отпечатки браузера);

- распознают ботов в реальном времени;

- блокируют подозрительные действия, не мешая настоящим пользователям.

Примеры таких систем: KillBot, Cloudflare Bot Management, StormWall, DDoS-Guard. Их подробный обзор и сравнение вы сможете найти в статье «10 лучших антиботов для сайта» в блоге Adlook.

3. Обновляйте и гибко настраивайте капчу

Капча всё ещё полезна, но только если она используется как дополнительный уровень защиты, а не единственное решение.

В 2026 году лучше всего работает адаптивная капча, которая:

- проводит простую проверку, если подозрений нет;

- даёт дополнительные задания, если есть вероятность бот-активности.

Важно регулярно тестировать, как капча работает на практике. Слишком сложная капча — такая же проблема, как и слишком простая. Если пользователи не смогут или не захотят её проходить, вы потеряете часть трафика.

В статье «Капча для сайта» мы собрали лучшие сервисы, а также подготовили подробную инструкцию по установке капчи, которая подойдёт для большинства CMS. Также мы ответили на частые вопросы:

- почему возникает ошибка при заполнении капчи;

- и когда капчу можно не ставить на сайт.

Обязательно ознакомьтесь с материалом.

4. Защищайте API и чувствительные точки

Очень часто атаки идут не на веб-страницы, а напрямую через API.

В таком случае стоит:

- ограничить количество запросов (rate limiting);

- использовать токены и валидацию;

- скрывать лишние эндпоинты;

- логировать подозрительную активность;

- разделять публичные и внутренние API.

Отдельное внимание уделите формам регистрации, входа в админку и восстановления пароля. Это наиболее уязвимые места для хакерских атак.

Рекомендуется изменить стандартный адрес входа в админ-панель. Типовые URL вроде /admin или /wp-admin — первое, что проверяют боты при автоматическом сканировании. Нетипичный адрес не заменяет полноценную защиту, но усложняет массовые атаки и отсеивает часть примитивных скриптов.

Дополнительно стоит подключить двухфакторную аутентификацию и ограничить доступ к админке по IP, если это возможно.

5. Делайте резервные копии и усиливайте инфраструктуру

Даже при хорошей защите никто не застрахован от неприятных инцидентов.

Поэтому:

- регулярно делайте бэкапы (рекомендуется хранить копии за последнюю неделю, месяц, квартал, полгода и год);

- сохраняйте копии в надёжном месте, а лучше — сразу в нескольких (подойдёт облачное хранилище, инфраструктура хостинг-провайдера и обычный внешний жёсткий диск);

- используйте защищённый хостинг;

- обновляйте CMS и плагины (но не всегда это стоит делать сразу — иногда лучше выждать паузу, пока обновление будет протестировано сообществом и разработчиками).

Бэкап поможет в случае атаки или взлома быстро восстановить сайт и минимизировать последствия.

О том, как настроить автоматическое создание бэкапов мы рассказали в статье «Резервная копия сайта: как сделать самостоятельно в 2026 году».

6. Подходите к защите как к процессу, а не разовой задаче

Многие вебмастера настраивают защиту один раз, а после надолго забывают о ней. «Зачем возиться, если и так всё надёжно?» — но это большое заблуждение.

Боты постоянно развиваются, а значит, и защита тоже должна обновляться.

Важно:

- периодически пересматривать правила фильтрации;

- тестировать систему на устойчивость;

- отслеживать новые сценарии атак;

- работать с проверенными решениями, которые регулярно обновляются.

На рынке постоянно появляются новые антибот-системы, способные справляться с угрозами разной степени сложности. Часто можно найти решение дешевле и эффективнее, чем ваше текущее, даже если старое уже стало привычным.

Заключение

Интернет больше не принадлежит только людям. Существенную часть трафика генерируют автоматизированные программы, и с каждым годом их становится всё больше, а их действия — всё более «человечными». Если часть ботов по-прежнему помогает интернету существовать в привычном нам виде, большинство всё же используется в вредоносных целях.

Потому защита сайта в 2026 году — приоритет для каждого вебмастера. И чем раньше вы начнёте подходить к ней системно, тем стабильнее будет работа вашего проекта и тем меньше риски финансовых и репутационных потерь.

Must-have меры безопасности:

- следить за трафиком и отслеживать подозрительную активность;

- выбрать и установить надёжную антибот-систему;

- настроить многоуровневую проверку капчи, особенно если на сайте есть формы регистрации, входа в личный кабинет или комментариев;

- защитить API и чувствительные точки;

- регулярно делать резервные копии.

Чтобы глубже разобраться в теме и выстроить надёжную систему защиты, рекомендуем ознакомиться с нашими подробными материалами:

Это был Adlook, на связи!