Почему компании все чаще строят платформы с большими данными на открытом ПО

Еще несколько лет назад выбор платформы для хранения больших данных (Big Data) для компании выглядел относительно простым. Рынок предлагал зрелые коробочные решения от крупных вендоров, которые обещали закрыть весь контур работы с данными – от хранения и обработки до аналитики и отчетности. Для бизнеса это означало понятную ответственность, централизованную поддержку и предсказуемость развития.

Однако к 2025–2026 году эта модель не просто дает сбои – она трещит по швам под напором новых реалий. Российский рынок больших данных и ИИ по итогам 2025 года достиг объема в 520 млрд рублей, показав рост около 20%. Но драйвер этого роста – уже не просто сбор данных, а потребность в извлечении из них реальной, рентабельной ценности с помощью ИИ. Все больше компаний – от среднего бизнеса до крупных корпораций – осознанно отказываются от коробочных платформ в пользу собственных платформ для больших данных. И этот выбор почти никогда не сводится к экономии на лицензиях.

Когда коробка была логичным выбором

Исторически коробочные платформы решали важную задачу – позволяли быстро запустить работу с данными без глубокой архитектурной экспертизы внутри компании. Один вендор брал на себя ответственность за всю систему, предлагал понятный план развития продукта и снижал риски для бизнеса, который только начинал работать с большими объемами данных.

В условиях относительно стабильных сценариев использования данных такой подход действительно работал. Но по мере того, как данные превращались из вспомогательной функции в один из ключевых активов бизнеса, ограничения коробочных решений стали проявляться все сильнее. В 2026 году уже недостаточно просто хранить данные – их нужно превращать в топливо для ИИ, а это требует принципиально иной архитектуры.

Данные перестали быть отчетностью

Главное изменение последних лет заключается в том, что данные больше не являются побочным продуктом операционной деятельности. Они напрямую влияют на продуктовые решения, автоматизацию процессов, работу ИИ-моделей и принятие решений в реальном времени.

Большинство коробочных платформ проектировались в период, когда ключевой задачей была аналитика «по факту» – отчеты, дашборды, ретроспективный анализ. В сегодняшних реалиях, где бизнесу нужны эксперименты, потоковая обработка, быстрые изменения и сложные сценарии использования данных, такая архитектура начинает ограничивать развитие. Сегодня эффективность ИИ-решений зависит не столько от выбора модели, сколько от качества, структуры и управляемости данных. Без комплексного подхода к подготовке данных большинство ИИ-инициатив терпят неудачу на этапе промышленной эксплуатации.

Универсальность против гибкости

Коробочные платформы по определению стремятся быть универсальными. Это их сильная сторона на старте, но именно она становится слабым местом при росте бизнеса. Как только процессы компании выходят за рамки стандартных сценариев, начинается поиск компромиссов между требованиями бизнеса и возможностями продукта.

Любое нестандартное решение оборачивается либо сложной доработкой, либо зависимостью от вендорской «дорожной карты». В результате платформа, которая должна ускорять развитие, начинает его сдерживать. В то время как экосистема, построенная на открытом ПО, предлагает десятки специализированных OLAP-решений (решения по оперативной аналитической обработке данных) – от ClickHouse для сверхбыстрых запросов до DuckDB для встраиваемой аналитики, – коробочные продукты вынуждены предлагать универсальный, а потому компромиссный инструмент.

Зависимость от вендора как стратегический риск

Если раньше зависимость от одного поставщика воспринималась как приемлемая плата за стабильность, то сегодня она все чаще рассматривается как стратегический риск. Речь идет не только о стоимости лицензий, но и об ограничениях в развитии архитектуры, сложностях интеграции новых инструментов, а также о рисках, связанных с регулированием и геополитикой.

Для компаний, которые строят долгосрочную стратегию работы с данными, контроль над технологическим фундаментом становится критически важным. 2025 год наглядно продемонстрировал уязвимость пути, основанного на некоммерческих версиях открытого ПО (open-source) или узкоспециализированных внутренних экспертах. Закрытие части направлений таких проектов, как Greenplum или MinIO, показало: компании, полагающиеся на них, рискуют столкнуться с прекращением поддержки ключевых компонентов и геометрически растущей стоимостью решений, что может парализовать развитие.

Открытое ПО как вопрос управляемости, а не экономии

Важно подчеркнуть: выбор открытого ПО для обработки больших данных – это не про «бесплатно». Это про контроль и управляемость.

Используя компоненты такого ПО, компания самостоятельно определяет архитектуру платформы, выбирает инструменты под конкретные задачи и выстраивает масштабирование в соответствии с бизнес-приоритетами. Архитектура начинает обслуживать бизнес-логику, а не подстраивать ее под ограничения продукта.

Кроме того, подход на основе открытого ПО позволяет эволюционно развивать платформу. Новые сценарии, будь то потоковая аналитика, ML-пайплайны (автоматизированные цепочки этапов, превращающие данные в предсказательную модель) или интеграция с ИИ-сервисами, внедряются тогда, когда это нужно бизнесу, а не когда они появляются в релизе вендора.

ИИ-архитектуры 2026: Data Lakehouse (гибкое и производительное хранилище данных), RAG (метод, при котором большая языковая модель перед генерацией ответа обращается к внешней базе знаний) и векторный поиск

Сегодня бизнесу нужны не просто данные, а управляемый фундамент для ИИ. Именно здесь открытое ПО предлагает архитектуры, которые коробочные решения догоняют с трудом.

Рынок активно движется в сторону архитектуры Data Lakehouse, объединяющей дешевизну хранения «сырых» данных с производительностью и управляемостью классических хранилищ. Такой подход позволяет работать со структурированными и неструктурированными данными в едином слое, обеспечивая высокую скорость обработки ИИ/ML-нагрузок. Открытые табличные форматы (Iceberg, Delta Lake) делают данные доступными для разных движков без привязки к одному вендору.

Критически важной становится поддержка векторного поиска, лежащего в основе архитектуры RAG (Retrieval-Augmented Generation – метод, при котором большая языковая модель перед генерацией ответа обращается к внешней базе знаний). RAG позволяет дополнять ответы больших языковых моделей (LLM) актуальными данными из корпоративных баз знаний, минимизируя «галлюцинации» и повышая достоверность информации. Движки на основе открытого ПО (например, ClickHouse, Apache Doris, StarRocks) уже интегрируют векторный поиск, позволяя создавать ИИ-ассистентов на собственных данных без отдельной дорогостоящей инфраструктуры. Российские разработки также идут в этом направлении: например, Yandex B2B Tech представила технологию векторного поиска в YDB, доступную как в облаке, так и при локальной работе на серверах компании.

Экономика и инфраструктура: графический процессор (GPU) и синтетические данные

Переход на открытое ПО меняет и экономику инфраструктуры. В условиях дефицита локальных вычислительных мощностей и ограничений на импорт оборудования компании ищут гибкие пути. Спрос на вычисления с помощью графического процессора и облачные сервисы, предоставляющие доступ к вычислительным мощностям на базе графического процессора по модели подписки или оплаты по факту использования (GPUaaS), в 2026 году удвоится: это позволяет кратно ускорять обработку данных и обучение моделей, оптимизируя затраты до 15-35% за счет модели оплаты по мере использования.

Кроме того, для обучения ИИ все чаще используются синтетические данные. Они сохраняют статистические свойства реальных массивов, но очищены от коммерческой тайны и персональных данных. По прогнозу Gartner, к 2028 году 60% данных для обучения ИИ будут синтетическими. Это снимает проблемы безопасности и конфиденциальности, позволяя выносить тяжелые вычисления в облака без риска утечек.

Прозрачная экономика владения

Да, собственная платформа больших данных требует инвестиций в команду, экспертизу и эксплуатацию. Но при зрелом подходе компания получает прозрачную и управляемую стоимость владения. Расходы на развитие, масштабирование и поддержку становятся предсказуемыми и напрямую связаны с ростом бизнеса.

В отличие от коробочных решений, где стоимость часто растет непропорционально нагрузке (лицензии привязаны к объему данных или числу узлов), открытое ПО позволяет гибко управлять экономикой платформы и избегать неожиданных финансовых сюрпризов. Разделение хранения и вычислений, ставшее стандартом для современных платформ, позволяет масштабировать эти компоненты независимо, платя только за то, что реально используется.

Где открытое ПО действительно дает преимущество

Практика показывает, что собственные платформы больших данных особенно эффективны там, где данные являются критическим активом, существует несколько сценариев их потребления, важна скорость изменений и экспериментов, а также требуется глубокая интеграция с ИИ и автоматизацией. Для компаний, строящих RAG-системы (метод, при котором большая языковая модель перед генерацией ответа обращается к внешней базе знаний) или планирующих обучать собственные модели, гибкость открытого ПО – это уже вопрос производительности и конкурентоспособности.

В таких условиях коробочные решения нередко начинают тормозить развитие, тогда как подход на основе открытого ПО, наоборот, становится конкурентным преимуществом.

Когда открытое ПО – не лучший выбор?

При этом важно честно признать: открытое ПО подходит не всем. Если у компании нет команды или плана ее развития, отсутствует четкое понимание, зачем вообще нужна платформа больших данных, а бизнес ожидает эффекта «включили – и работает», коробочное решение может оказаться более рациональным выбором.

Открытое ПО требует зрелости, как технологической, так и управленческой. Дефицит квалифицированных кадров и сложность архитектуры – главные риски этого пути.

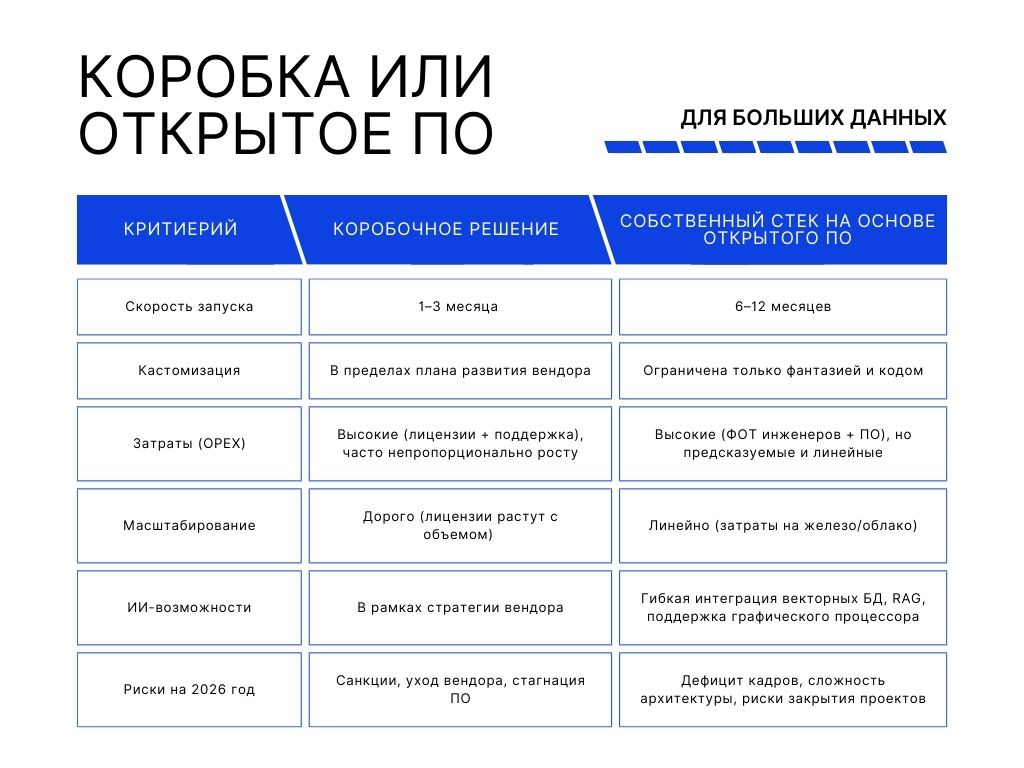

Коробка против открытого ПО в 2026 году

Чтобы помочь руководителям компаний и ИТ-направлений внутри бизнеса быстрее принять решение, добавим компактное сравнение:

Вывод для топ-менеджмента компаний

Выбор между коробочной платформой для больших данных и открытым ПО – это не вопрос технологий. Это вопрос стратегии и зрелости бизнеса.

Коробочные решения дают скорость и простоту на старте. Открытое ПО обеспечивает контроль, гибкость и долгосрочную устойчивость. Именно поэтому в 2026 году все больше компаний, особенно в условиях новой экономики данных и тотальной цифровизации, делают осознанный выбор в пользу собственных платформ больших данных на базе открытого ПО. Не потому, что это дешевле, а потому, что это позволяет превратить данные в настоящий актив, а не в ограничение, и гибко реагировать на вызовы рынка, где ИИ и данные стали главным источником конкурентного преимущества.