Kling AI Motion Control: нейросеть, которая переносит движения из видео

Когда ищут нейросеть для видео, чаще всего хотят простого результата: оживить фото, перенести танец или жесты и получить реалистичное ИИ-видео, а не «пластиковую» анимацию.

Проблема большинства видеонейросетей в том, что динамика быстро ломается. В движении появляются типичные ошибки:

- искажаются позы

- «плывут» руки

- лицо теряет выражение

- движения выглядят искусственно

Особенно заметно это в танцах, челленджах и любых активных сценах.

Именно поэтому Kling AI Motion Control стал одним из самых популярных инструментов для создания ИИ-видео. Он позволяет переносить движения из реального видео на персонажа и получать более естественную анимацию — без характерного «пластика».

Что такое Kling AI Motion Control и чем он отличается от обычных видеонейросетей

Перенос движения — простыми словами

Механика Kling Motion Control довольно простая.

В генерации участвуют два источника:

- видео-референс задаёт движение (танец, жесты, наклоны)

- изображение задаёт внешний вид персонажа

Нейросеть объединяет эти данные и создаёт новое видео.

В итоге получается ролик, где:

- внешность берётся из изображения

- движения повторяются из реального видео

Благодаря этому динамика выглядит естественно. Нейросеть не «угадывает» движения, а повторяет уже существующую пластику.

Именно этот принцип делает Kling AI Motion Control одним из самых реалистичных способов создать видео через нейросеть.

Kling Motion Control vs обычный Kling AI

Разница между режимами принципиальная.

Обычный Kling AI

- генерирует видео с нуля

- движения создаются нейросетью

- иногда появляются артефакты

Kling Motion Control

- использует референс-видео

- переносит движения на персонажа

- лучше сохраняет ритм и анатомию

Поэтому Kling Motion Control чаще используют для реалистичных роликов, где важна естественная пластика.

Для каких задач Kling AI Motion подходит лучше всего

Танцы и динамичные сцены

Одна из самых популярных задач — перенос танцевальных движений.

Kling Motion Control хорошо работает для:

- танцевальных роликов

- челленджей для TikTok

- коротких видео для Reels и Shorts

- сцен с активной работой рук и корпуса

В таких случаях motion transfer сохраняет ритм и пластику движения, чего обычно не хватает при обычной генерации видео через нейросеть.

Видео с детьми и питомцами

Дети и животные двигаются непредсказуемо. Это сложная задача для обычных видеонейросетей.

Перенос движения помогает:

- точнее повторять жесты

- избегать искажений поз

- сохранить «живое» ощущение движения

Поэтому Kling AI часто используют для анимации семейных видео или роликов с питомцами.

Аватары и персонажи

Ещё одно популярное применение — создание видео-аватаров.

Через Kling Motion Control можно:

- оживлять фотографии

- анимировать персонажей

- делать видео-аватары для соцсетей

Это позволяет быстро создать короткие ролики, где персонаж двигается естественно и повторяет движения из реального видео.

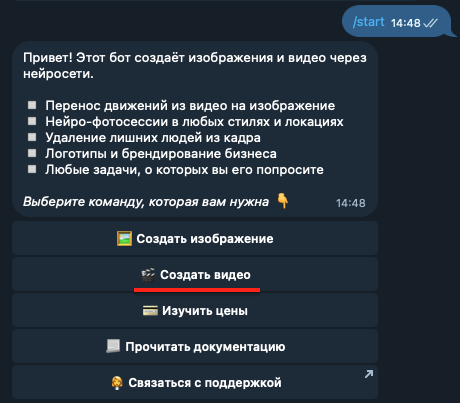

Пошагово — как сделать видео с Kling Motion в Telegram

Для пользователей из России самый удобный вариант — Telegram, где Kling Motion Control уже интегрирован. Например, в Pauk AI режим motion transfer вынесен отдельно — можно сразу выбрать перенос движений, без лишних настроек.

Как запустить генерацию

- загрузите изображение персонажа;

- добавьте видео-референс с движением;

- при необходимости укажите короткий промпт;

- запустите генерацию видео в Telegram.

Через несколько минут вы получите ролик, где внешность берётся из изображения, а движения — из реального видео.

Почему Telegram — самая удобная среда для Kling AI Motion Control

Почему сайты и приложения проигрывают

Многие сервисы для генерации видео через нейросеть работают через сайты или отдельные приложения. Но на практике такой формат часто усложняет работу.

Типичные проблемы веб-сервисов:

- длинные очереди на генерацию видео

- перегруженные интерфейсы с десятками параметров

- необходимость заново настраивать генерацию при каждом запуске

Для быстрых экспериментов с Kling AI Motion Control это неудобно. Когда нужно протестировать несколько видео или попробовать разные движения, такие ограничения сильно тормозят процесс.

Поэтому многие пользователи переходят на более простой формат — работу через Telegram.

Как это реализовано в Pauk AI

В Telegram интерфейс становится намного проще. Например, в Pauk AI режим Kling Motion Control вынесен отдельно и доступен прямо в чате.

Это позволяет быстро запускать генерацию видео без лишних действий.

Преимущества такого формата:

- все режимы Kling AI Motion Control собраны в одном месте

- минимальное количество шагов до запуска генерации

- можно легко тестировать несколько видео подряд

- не нужно переключаться между сайтами и вкладками

В итоге нейросеть для видео в Telegram сегодня становится самым удобным способом работы с motion transfer. Вы просто загружаете изображение и видео-референс — остальное делает нейросеть.

FAQ — частые вопросы о Kling AI Motion Control

Подходит ли Kling Motion Control для новичков?

Да. Формат довольно простой: фото персонажа + видео-референс + запуск генерации. Именно поэтому Kling AI в Telegram часто используют даже без опыта работы с видеонейросетями.

Можно ли использовать своё видео?

Да. Вы можете загрузить любое видео-референс, из которого будут перенесены движения.

Это позволяет:

- сохранить естественную пластику

- повторить реальные жесты

- получить более живую динамику

Чем Kling Motion Control лучше обычного Kling AI?

Обычный Kling AI генерирует видео с нуля. В режиме Kling Motion Control движения берутся из реального видео.

За счёт этого:

- меньше артефактов

- лучше сохраняется анатомия

- движения выглядят естественнее

Итог — стоит ли использовать Kling AI Motion Control в 2026 году

Kling AI Motion Control сегодня считается одним из самых эффективных способов создать реалистичное видео через нейросеть. Формат motion transfer позволяет переносить реальные движения и получать гораздо более естественную анимацию.

По сравнению с обычной генерацией или дипфейками результат выглядит живее: сохраняется ритм, пластика и динамика движения.

Самый удобный сценарий работы — Kling Motion Control через Telegram. Быстрый запуск, минимум настроек и предсказуемый результат делают этот формат особенно удобным для экспериментов с ИИ-видео.