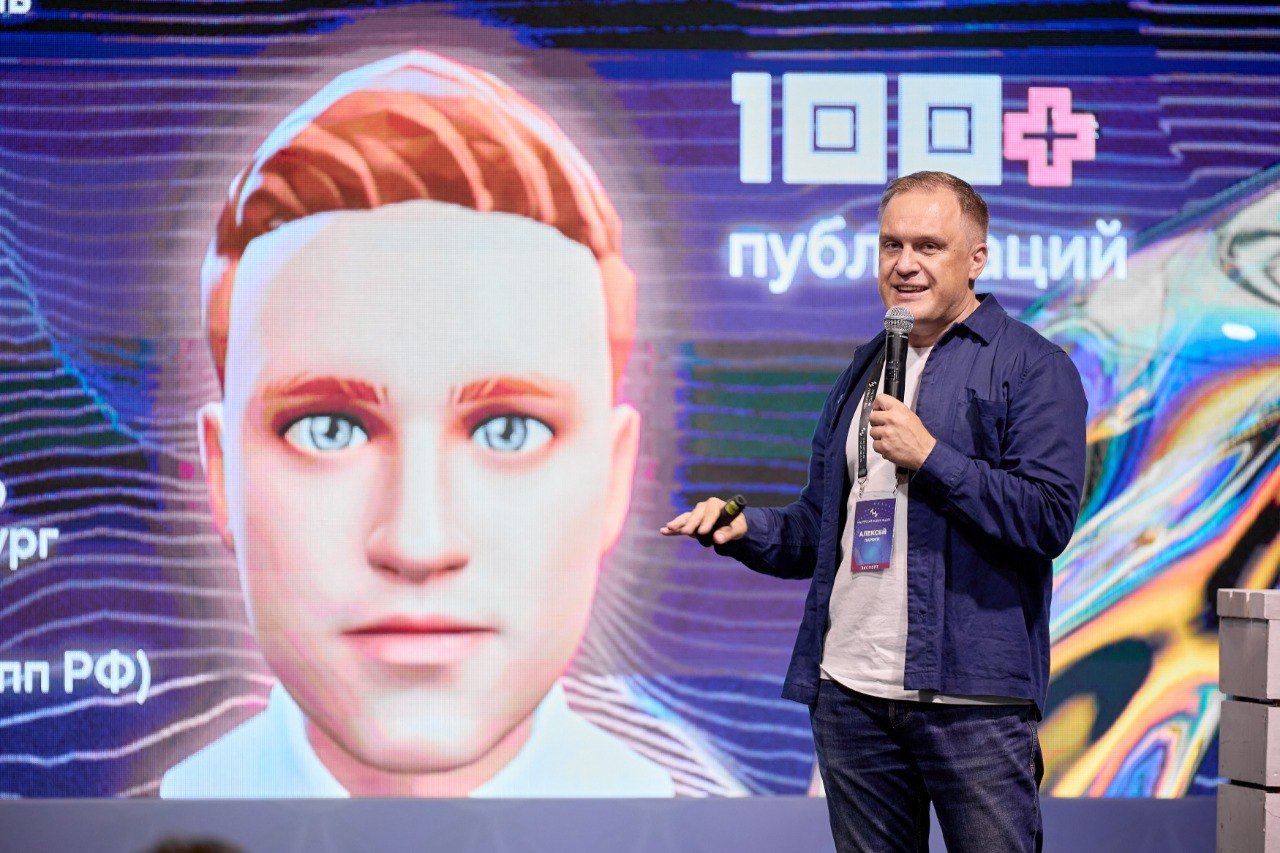

Нейросети украдут наши души. Технология дипфейк в массовых коммуникациях

Как у любой прорывной технологии, у дипфейков есть и негативные последствия. Вот только некоторые проблемы, связанные с их использованием:

Манипуляция и обман: мошенники могут чужими изображениями высказывать расистские лозунги, разжигать ненависть, распространять фейки, разводить родственников на деньги.

Нарушение частной жизни: представьте лицо примерного семьянина в не самой этичной сцене. Или неугодного бизнесмена, который продаёт запрещённые вещества. Всё это может быть использовано для шантажа.

Распространение фейковых порноизображений: ещё один вариант для шантажа и буллинга. Причём как знаменитостей, так и простых людей.

Использование образов людей без их согласия: видео, где фигурируют люди, которых уже нет с нами, и разрешение на съёмку которых дают наследники. Эта тема заслуживает отдельного обсуждения с участием заинтересованных лиц.

Вот негативные примеры:

https://www.youtube.com/watch?v=zO2cz4RpE9o - про мошенника, который использовал дипфейки в Тиндере

https://www.youtube.com/shorts/ig7PJ0nU3Vo - про создание порнографических дипфейков

В общем, всё не так радужно, как я писал в первом посте. Наше общество ещё не настолько кристально, чтобы закрывать глаза эти проблемы. Создание и распространение дезинформации, подделки и обманы через дипфейки должны преследоваться по закону. Но как составить законодательную базу, по которой дипфейки помечались бы как этичные и неэтичные?

И здесь интересный момент. Многие технологические компании, например IBM и Microsoft, в этих вопросах прибегают к помощи… церкви. Да, сегодня церковь по всему миру активно участвует в разработке правил использования дипфейков. Этому я посвящу следующий пост.

Другие полезные тексты я чаще публикую в своих каналах: Полезный Парфун | Presentopia | Поло с крокодильчиком