Создать ИИ видео танец на основе своего фото через нейросеть Kling AI Motion Control от Kuaishou — Готовые промты для танцующих фотографий

Представьте: у вас есть обычная фотография, но уже через несколько минут она оживает и начинает танцевать под музыку. Без сложного монтажа, без навыков анимации. Просто загрузили фото - и получили вирусное видео, которое собирает тысячи просмотров.

В 2026 году это уже не фантастика, а реальность благодаря нейросетям, таким как Kling AI Motion Control от Kuaishou. А если добавить готовые промты и удобные инструменты, например сервис aihere, процесс становится максимально простым даже для новичка.

Как сделать видео танец из фото через нейросеть Kling AI Motion Control: Пошаговая инструкция

Шаг 1: подготовка фото для анимации

Первый и самый важный этап - это правильная подготовка изображения. Именно от качества исходного фото зависит, насколько реалистично будет выглядеть будущий танец. Лучше всего выбирать снимок, где человек изображен в полный рост или хотя бы по пояс, с четко видимыми руками и ногами. Лицо должно быть хорошо освещено, без сильных теней или размытия.

На практике пользователи отмечают, что нейросеть лучше всего работает с фотографиями на простом фоне, где нет лишних деталей. Это помогает Kling AI Motion Control точнее определить позу и корректно анимировать движения. Если фото неидеальное, его можно предварительно улучшить прямо в сервисе - там есть удобные инструменты для подготовки изображений.

Шаг 2: выбор готовых промтов

После загрузки изображения следующим шагом становится выбор промта, который задает стиль и характер движения. Вместо того чтобы придумывать описание с нуля, гораздо проще воспользоваться готовыми решениями на aihere. Сервис предлагает большую библиотеку промтов, адаптированных специально под анимацию танцев.

➝➝➝Забрать бесплатно 100+ готовых промтов для ИИ танцев

Вы просто выбираете категорию, например TikTok танцы, hip-hop или K-pop, и подставляете готовый текст в Kling AI Motion Control. Это значительно экономит время и повышает качество результата, потому что промты уже протестированы и оптимизированы под актуальные алгоритмы 2026 года. Интерфейс интуитивно понятный, поэтому даже новичок разберется буквально за пару минут.

Шаг 3: генерация танцующего видео

Финальный этап - это запуск генерации. После того как вы загрузили фото в выбранный промт, Kling AI Motion Control анализирует изображение и создает плавную анимацию движений.

Через короткое время вы получаете готовое видео, где персонаж из вашей фотографии танцует в выбранном стиле. При необходимости результат можно пересоздать с другим промтом или слегка изменить настройки. Благодаря связке с aihere этот процесс становится максимально быстрым и удобным, а итоговое видео выглядит профессионально и современно.

Топ 10 готовых промтов для танцующих видео по фото Kling AI

1. Танец ИИ "Токсис - Возьми телефон детка", мем из ТикТока, повтори движения - оживи фото

2. Тренд танцующее фото, "Танец дэдпула" через нейросеть – шаблон ИИ повторения движений с видео для Shorts

3. Оживи своё фото под звук «Я также знаю, что вы не удовлетворяете свою жену» — тренд ТикТок в Motion Control: Готовый промт 2026

4. Как сделать танцующее фото ребёнка "Пупсик - Тина Король" тренд ТикТок Shorts — Kling AI: готовые промпты ИИ через нейросеть

5. Нейросеть делает танцующее видео под трек "Нелюбовь - Гости из будущего" из вашего фото – повторение движений с видео, готовый промт ИИ

6. Танец ИИ с мини версией себя: Промт для миниатюрной фигурки человека с большой головой

7. Тренд танцующее фото через ИИ под трек "Одного (Remix) - Татьяна Куртукова" – повторение движений с видео, готовый промт нейросети

8. Как сделать танцующее фото по видео нейросетью – промт повторения движений, сохранение лица и тела для TikTok

9. Как сделать танцующее фото ребёнка тренд повторение движений с видео через нейросеть – промт ИИ с сохранением лица и тела

10. Трендовый танец под песню «Матушка земля» в Kling Motion-Control через нейросеть – готовый шаблон ИИ по фото

Создать ии видео танец в нейросети Kling Motion Control

Нейросеть Kling AI Motion Control от Kuaishou стала одним из самых обсуждаемых инструментов для создания анимации из фото. В отличие от старых решений, где движения выглядели неестественно, Kling делает акцент на реалистике: плавная пластика тела, корректная работа с позой и деталями лица. Именно поэтому видео с его использованием часто выглядят как настоящая съемка, а не результат генерации.

Главная особенность Kling - это управление движением через промты и Motion Control. Пользователь может буквально «задать» танец словами, а нейросеть интерпретирует его в виде полноценной анимации. Это открывает огромные возможности для создания контента: от вирусных роликов до персонализированных аватаров и рекламных видео.

Важно и то, что Kling отлично сочетается с готовыми решениями, такими как aihere. Вместо долгих экспериментов с текстовыми описаниями можно использовать уже проверенные промты и сразу получать качественный результат. Это особенно актуально для новичков, которые только начинают работать с ИИ-видео и хотят быстро увидеть эффект.

В 2026 году Kling активно используется в соцсетях, маркетинге и digital-контенте. Его выбирают за простоту, скорость генерации и впечатляющий визуальный результат. И если раньше для создания подобных видео требовались навыки анимации, то сейчас достаточно одного фото и правильно подобранного промта.

Как повторить трендовый ии танец из фото через нейросеть онлайн

Kling AI Motion Control - это мощный инструмент, который позволяет управлять движением персонажа на основе текста или шаблонов анимации.

Основной принцип работы:

- Загружаете фото (портрет или полный рост)

- Выбираете стиль движения или вводите промт

- Нейросеть анализирует позу

- Генерирует плавную анимацию танца

Что важно учитывать:

- лучше использовать фото с четким силуэтом

- лицо должно быть хорошо видно

- фон желательно простой

Популярные сценарии использования:

- TikTok и Reels видео

- аватары для соцсетей

- мемы и развлекательный контент

- продвижение брендов

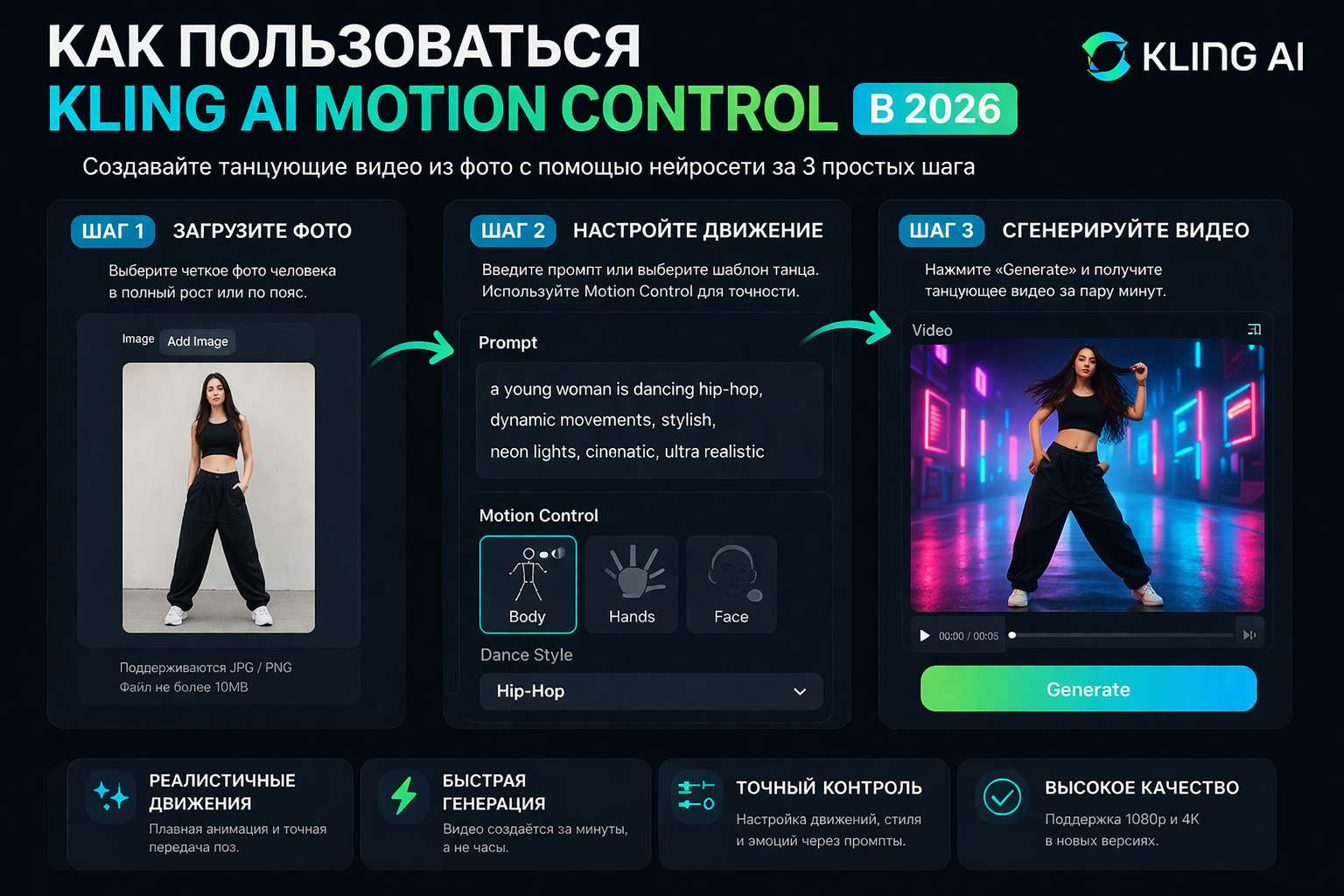

Как пользоваться Kling AI Motion Control в 2026

Регистрация и доступ к Kling AI

Чтобы начать работу с Kling AI Motion Control от Kuaishou, сначала нужно получить доступ к самой платформе. В 2026 году сервис чаще всего доступен через официальный интерфейс https://kling.ai или интеграции внутри китайских экосистем. Для регистрации потребуется аккаунт, иногда с подтверждением номера телефона или через сторонние сервисы авторизации.

После входа пользователь попадает в рабочую панель, где доступны инструменты генерации видео. Интерфейс может отличаться в зависимости от версии, но базовая логика остается одинаковой: загрузка изображения, настройка движения и запуск генерации.

Загрузка и анализ исходного фото

Следующий этап - загрузка фотографии, на основе которой будет создан танец. Kling автоматически анализирует изображение сразу после загрузки. Нейросеть распознает тело человека, определяет ключевые точки и строит цифровую модель позы.

Важно понимать, что система не просто «накладывает» анимацию, а адаптирует движение под конкретное фото. Если человек стоит прямо - движения будут одни, если в пол-оборота - другие. Поэтому выбор исходного изображения напрямую влияет на финальный результат.

Настройка Motion Control и ввод промта

После анализа фото пользователь переходит к управлению движением через Motion Control. Здесь задается основной стиль танца и характер анимации. В отличие от простых генераторов, Kling позволяет детально контролировать поведение персонажа через текстовые описания.

Промт может включать стиль танца, скорость, энергичность, эмоции и даже условия сцены. Например, можно указать уличный стиль, сценическое освещение или плавные движения. Нейросеть интерпретирует этот текст и превращает его в последовательность движений, адаптированную под загруженное фото.

Генерация видео и обработка результата

После настройки всех параметров запускается процесс генерации. Kling создает видео по кадрам, синтезируя движение на основе заданного промта и исходной позы. Этот процесс может занимать от нескольких секунд до нескольких минут в зависимости от качества и сложности сцены.

Готовое видео можно просмотреть сразу в интерфейсе. Если результат не устраивает, пользователь может изменить промт, добавить уточнения или выбрать другой стиль движения и перегенерировать ролик. Такой подход позволяет добиться максимально точного и качественного результата без использования дополнительных сервисов или агрегаторов.

Экспорт и использование готового видео

Финальный шаг - экспорт готового видео. Kling позволяет сохранить результат в различных форматах и разрешениях, что удобно для дальнейшего использования. Видео можно публиковать в соцсетях, использовать в рекламе или интегрировать в контент.

В 2026 году Kling AI Motion Control становится полноценным инструментом для создания видео без необходимости в монтаже или сложных программах. Все происходит внутри одной нейросети: от анализа фото до финального танцующего ролика.

Как нейросеть Kling Motion Control оживляет фото в ии танец

Нейросеть Kling Motion Control от Kuaishou работает на основе анализа изображения и генерации движения, максимально приближенного к реальному. Когда вы загружаете фотографию, система сначала распознает ключевые точки тела - положение головы, рук, ног и корпуса. Это позволяет ей «понять», как именно должен двигаться человек в кадре, чтобы анимация выглядела естественно.

Далее в работу вступает механизм Motion Control. Он интерпретирует текстовый промт как набор инструкций для движения. Например, если в описании указано hip-hop dance или dynamic moves, нейросеть подбирает соответствующие паттерны движения, добавляет ритмику и синхронизацию. В результате получается не просто хаотичное движение, а полноценная танцевальная анимация с логикой и стилем.

Особенность Kling в том, что он учитывает не только тело, но и микродвижения - повороты головы, мимику, работу плеч и рук. Именно за счет этого видео выглядит живым и реалистичным. Дополнительно алгоритмы обрабатывают свет, глубину и перспективу, чтобы персонаж органично «вписывался» в кадр и не выглядел как наложенный эффект.

В связке с готовыми промтами, например с платформы aihere, процесс становится еще точнее. Пользователь задает правильное описание движения, а нейросеть уже преобразует статичное фото в динамичное видео, где человек танцует так, будто изначально был снят в движении.

Принцип работы Kling Motion Control: как фото превращается в реалистичный танец

В основе работы Kling Motion Control от Kuaishou лежит сочетание компьютерного зрения и генеративных моделей движения. Когда пользователь загружает фотографию, нейросеть сначала проводит глубокий анализ изображения: определяет положение тела, угол наклона, пропорции и даже предполагаемую анатомию человека. Это необходимо для того, чтобы будущая анимация выглядела не случайной, а логически корректной и физически правдоподобной.

После анализа система создает так называемый «скелет движения» - цифровую модель, которая повторяет структуру тела на фото. Именно на этот каркас затем накладываются движения, заданные через Motion Control. Промт в этом случае выступает как инструкция: он задает стиль танца, интенсивность движений, эмоции и даже атмосферу сцены.

Далее нейросеть синтезирует промежуточные кадры, создавая плавный переход от одной позы к другой. За счет этого движения выглядят естественно, без резких скачков или искажений. Параллельно обрабатываются детали: мимика, повороты головы, движение рук и даже мелкие жесты, которые делают видео более «живым».

Финальный этап - это рендеринг готового видео. Kling учитывает освещение, глубину кадра и визуальные эффекты, благодаря чему персонаж не просто двигается, а выглядит как часть полноценной сцены. Именно поэтому танцы, созданные через эту технологию, часто воспринимаются как настоящая съемка, а не результат работы ИИ.

Как начать свой ии танец через нейросеть прямо сейчас

Если вы хотите создавать вирусные видео из обычных фото:

- Подготовьте качественное изображение

- Используйте Kling AI Motion Control

- Возьмите готовые промты на aihere.ru👈

- Экспериментируйте со стилями

ИИ-контент в 2026 году - это не просто тренд, а новая норма. И чем раньше вы начнете, тем быстрее получите результат.