Kling AI нейросеть на русском: Клинг ИИ бесплатно — разбор настроек движения и детализации

Вы пишете хороший промпт, загружаете красивую картинку, нажимаете generate — а на выходе получаете ролик, где герой будто скользит по льду, фон “плывет”, а детализация лица теряется уже на второй секунде. У большинства пользователей первое знакомство с Kling выглядит именно так: ожидание киношной анимации, а результат — почти удачный, но все еще сырой. Проблема обычно не в самой модели, а в том, что настройки движения и детализации в таких генераторах решают больше, чем кажется.

Именно поэтому вокруг Kling, Kling ai и запросов вроде нейросеть Kling столько интереса. Пользователи приходят не просто “оживить картинку”, а получить управляемое движение, аккуратную камеру, стабильный объект в кадре и понятный способ довести генерацию до приличного результата. Если заходить в сервис без понимания, как работают motion, camera control, start/end frames и локальные инструменты управления, даже сильная Kling ai нейросеть будет давать нестабильный результат.

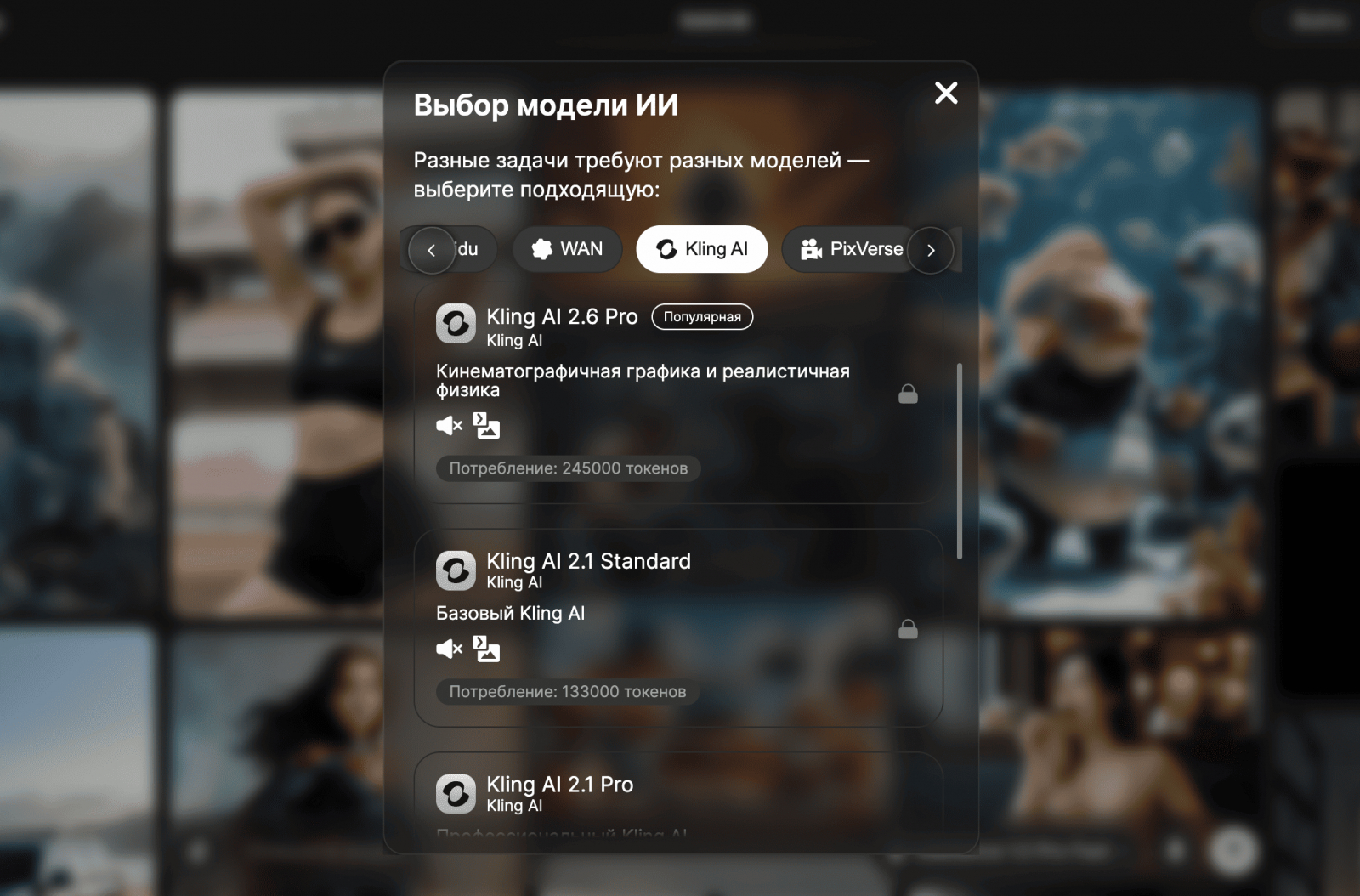

Для тех, кто хочет разобраться спокойно и без путаницы, удобнее всего начинать с Kling ai на русском: не как с “волшебной кнопки”, а как с рабочего инструмента, у которого есть конкретные сильные стороны. В экосистеме Kling официально доступны text-to-video, image-to-video, Motion Brush для анимации отдельных частей изображения, camera movement с шестью типами движения камеры и “master shots”, а также сценарии со start и end frames, где можно задавать начальный и конечный кадр для более управляемого перехода. В релизах Kling 2.5 Turbo отдельно подчеркивались усиленные динамика, амплитуда движения камеры, стабильность и креативность генерации.

Если говорить проще, Kling al и Kling al нейросеть — это в первую очередь не “еще одна нейронка для видео”, а инструмент, который особенно ценят за умение работать с image-to-video, оживлением фото, направлением движения и более кинематографичным ощущением ролика. В этой статье разберем, что такое Kling бесплатно и Kling ai бесплатно на практике, зачем пользователи ищут Kling нейросеть бесплатно, чем отличаются Kling 2.1, Kling 2.5 и Kling 2.5 turbo в пользовательском восприятии, как понимать настройки движения и детализации, чем Kling отличается от других генераторов и как писать промпты так, чтобы ролики выглядели не “как нейросеть старалась”, а как нормальный управляемый видеоряд.

Что такое Kling и зачем его вообще используют

Если говорить без маркетинговой мишуры, Kling video и Kling video-подход нужен тем, кто хочет создавать видео из текста или из изображения, а не только генерировать статичные картинки. Сервис особенно часто используют в четырех сценариях:

- оживление фото;

- короткие рекламные и продуктовые видео;

- cinematic image-to-video ролики;

- тестирование идей для Reels, Shorts, TikTok и креативов.

По официальным гайдам Kling, платформа поддерживает text-to-video и image-to-video, а в более новых моделях и гидах появились start & end frames, native audio, motion control и multi-shot-логика для части моделей семейства VIDEO 3.0. При этом именно image-to-video и motion control сделали Kling узнаваемым у широкой аудитории.

Пользовательский интерес понятен: люди ищут Kling ai нейросеть бесплатно, Kling видео, Kling оживить фото и Kling ai скачать, потому что хотят быстро получить эффект “ожившей картинки”. И здесь действительно есть сильная сторона: Kling ai нейросеть оживить фото работают лучше всего тогда, когда вы не пытаетесь заставить одну статичную картинку превратиться в хаотичный экшен, а задаете осмысленное, локальное, физически понятное движение.

Kling на русском: почему этот вопрос вообще важен

Когда пользователи ищут Kling нейросеть на русском они ищут не только локализацию интерфейса. Им нужен понятный способ взаимодействия: как формулировать промпты, что означают настройки, как интерпретировать модели и где заканчивается “красивый результат” и начинается настройка генерации как процесса.

Это особенно важно, потому что часть аудитории приходит в Kling не из профессионального motion-дизайна, а из среды “хочу быстро сделать красиво”: маркетологи, владельцы бизнеса, контент-креаторы, SMM-специалисты, продавцы на маркетплейсах, блогеры и просто любопытные пользователи. Для них Kling ai нейросеть на русском и Kling ai нейросеть бесплатно на русском — это по сути запрос на понятную, рабочую инструкцию без технической перегрузки.

Основные фишки Kling, ради которых его и используют

Если отбросить лишнее, у Kling есть несколько функций, из-за которых его реально выбирают.

Image-to-video как базовый сценарий

Самая популярная точка входа — Kling ai фото и Kling ai нейросеть фото. Пользователь берет изображение и оживляет его. Это работает особенно хорошо для:

- портретов;

- фэшн-кадров;

- продуктовых фото;

- cinematic key visual;

- обложек и постеров;

- иллюстраций и moodboard-кадров.

Секрет здесь не в том, чтобы “дать максимум движения”, а в том, чтобы задать правильный тип движения. Kling лучше раскрывается, когда анимация логична: ветер в волосах, разворот корпуса, плавный dolly-in камеры, моргание, поворот головы, движение ткани, легкая партикльная среда.

Motion Brush и локальное управление движением

Официальный гайд Kling по Motion Brush описывает возможность анимировать конкретные части изображения, добавлять движение до 6 элементов одновременно и использовать Static Brush, чтобы удерживать фон или другие области статичными. Это одна из самых сильных сторон системы, если вы хотите управлять движением не глобально, а локально.

На практике это значит следующее: если у вас фото девушки на улице, не надо заставлять “двигаться весь кадр”. Лучше отдельно оживить волосы, край плаща, немного руку и фоновые листья. Именно так Kling видео перестает быть хаотичным и начинает выглядеть дороже.

Camera Movement и кинематографичность

Официальный guide по camera movement указывает, что Kling поддерживает 6 типов управления камерой — включая zoom, pan, tilt, roll — и 4 master shots для более режиссерского управления сценой.

Это критически важная часть. Большинство новичков недооценивают камеру и пытаются “вытянуть” ролик за счет движения объекта. На деле именно камера часто делает результат кинематографичным. Медленный zoom in, мягкий truck, боковой pan, легкий tilt — все это помогает даже очень простой сцене выглядеть как видео, а не как “дергающаяся картинка”.

Start & End Frames

Сценарий start/end frames особенно полезен, если вы хотите не просто “оживить”, а направить трансформацию. В официальной справке Kling этот режим подается как отдельный способ задать начальный и конечный кадр в image-to-video.

Для пользователя это значит, что можно заранее думать не только о первом кадре, но и о том, куда сцена должна прийти. Например:

- герой смотрит в камеру → герой отворачивается в профиль;

- общий план товара → более близкий hero-shot;

- пустая улица → включаются огни и появляется туман;

- статичная поза → легкий шаг вперед.

Это сильный инструмент Kling ai нейросеть против “блуждающего движения”, когда модель двигается, но непонятно зачем.

Разбор настроек движения: что реально влияет на результат

Теперь к самому важному — к тому, что в тайтле: движение и детализация.

Амплитуда движения

Главная ошибка новичка — дать слишком много движения. Хочется, чтобы кадр “жил”, и пользователь начинает писать: dynamic motion, dramatic movement, flowing hair, intense camera movement, fast action, cinematic energy. В итоге кадр разваливается.

Практическое правило простое:

- слабый источник → слабое движение;

- хороший source image → умеренное движение;

- сложная сцена → очень дозированное движение;

- если нужен реализм — лучше недодать, чем передать.

Именно здесь хорошо раскрываются Kling 2.1, Kling 2.5 и особенно Kling 2.5 turbo как ориентиры в пользовательских обсуждениях: чем лучше модель справляется с динамикой, тем сильнее соблазн “врубить побольше движения”. Но почти всегда лучший результат дает controlled motion, а не maximal motion. В релизе Kling 2.5 Turbo прямо отмечалось, что модель получила более динамичное движение и более крупную амплитуду движения камеры, но это не означает, что любой кадр нужно анимировать агрессивно.

Тип движения: объект или камера

Очень важный вопрос: кто должен двигаться — герой или камера? Новички часто заставляют двигаться и то, и другое одновременно, из-за чего получается ощущение “нейросетевого шторма”.

Рабочий принцип:

- если кадр already detailed, двигайте камеру;

- если композиция сильная и герой статичен, дайте локальное движение объекту;

- если фон сложный, лучше мягкая камера + минимальный motion объекта;

- если нужен fashion/editorial эффект — камера часто важнее объекта.

Пример:

- плохой запрос: “woman walking dramatically, camera spins around, hair flying, city moving fast”

- хороший запрос: “slow dolly in, subtle head turn, gentle hair movement, background remains stable”

Локальное движение против глобального

Motion Brush полезен именно потому, что глобальное движение часто ломает картинку. Если анимировать весь кадр, детализация начинает “плавать”: кожа становится пластиковой, мелкие элементы дрожат, одежда ломается по краям.

Лучше подходить так:

- выбрать 1–3 активные зоны;

- обозначить 1–2 статичные зоны;

- не анимировать все сразу;

- помнить, что “легкое движение” почти всегда выглядит дороже “очень заметного”.

Скорость и энергия

Скорость движения в AI-video — это не только “быстро или медленно”. Это еще и восприятие качества. Чем быстрее сцена, тем выше риск артефактов. Поэтому для реалистичного ролика полезно:

- замедлять сложные сцены;

- не заставлять мелкие детали двигаться резко;

- не соединять быстрый pan и сложный foreground;

- быть осторожнее с толпой, руками и волосами одновременно.

Разбор настроек детализации: как не убить лицо, ткань и фон

Если движение — это скелет ролика, то детализация — его кожа. Именно на деталях AI-видео чаще всего разваливается.

Детализация объекта

Когда пользователи говорят, что “Kling сделал красиво”, чаще всего они имеют в виду не сам motion, а то, как держатся:

- лицо;

- глаза;

- волосы;

- руки;

- складки ткани;

- аксессуары;

- продуктовые детали;

- текстуры поверхности.

Чтобы детализация не уезжала, полезны три принципа:

- Не перегружайте кадр изначально.

- Не давайте слишком амбициозное движение.

- В промпте фиксируйте ключевые визуальные свойства.

Например:

- “preserve facial features”

- “maintain sharp eyes and skin texture”

- “stable product details”

- “keep clothing folds realistic”

Детализация фона

Фон в Kling легко портится, если вы одновременно даете активный объект, активную камеру и мелкую глубину сцены. В итоге детали на заднем плане начинают мерцать или смазываться.

Если фон важен, делайте так:

- уменьшайте амплитуду движения;

- используйте Static Brush там, где фон должен стоять;

- не злоупотребляйте сложной погодой и частицами;

- избегайте перенасыщенного описания окружения в промпте.

Лицо и руки

Это классическая боль почти всех video generators. Если сцена строится вокруг человека, лицо и руки — зоны повышенного риска. Поэтому:

- не заставляйте руки делать сложные жесты без необходимости;

- не комбинируйте близкий портрет и резкий поворот;

- не требуйте слишком резкого изменения выражения лица;

- для beauty, fashion и portrait роликов выбирайте мягкие движения.

Продуктовая детализация

Если вы делаете рекламу товара, мелкие элементы — логотипы, швы, этикетки, кнопки, текстуры — должны быть важнее динамики. В product-shot лучше слабее двигать, но удержать форму объекта, чем получить яркий, но “поплывший” товар.

Чем Kling отличается от других нейросетей

Сравнивать AI-video генераторы напрямую трудно, потому что каждый хорош в своих сценариях. Но если говорить пользовательским языком, нейросеть Kling и Kling ai нейросеть чаще выбирают за сочетание трех вещей:

- уверенное image-to-video;

- заметно более киношное ощущение движения;

- хороший баланс между управлением камерой и анимацией объекта.

По сравнению с нейросетями, которые делают “красивые, но слишком декоративные” ролики, Kling ai видео часто воспринимается как более контролируемый инструмент. Особенно когда вы понимаете, как писать motion-промпты. А по сравнению с генераторами, которые сильны в абстрактной визуальности, Kling video удобнее там, где нужна предметность: лицо, одежда, продукт, сцена, кадр как shot, а не как калейдоскоп.

Еще одно отличие — сценарии с Motion Brush, camera movement и start/end frames. Это не просто “дополнительные кнопки”, а реально рабочие инструменты контроля, которые сильно влияют на результат. Именно поэтому в 2026 году в официальных гайдах Kling так много внимания уделяется motion control, image-to-video и режиссерским сценариям работы с кадром.

Если говорить проще: Kling — это не “всегда лучший генератор”, а очень сильный инструмент именно там, где вы хотите управлять оживлением изображения, а не просто получить рандомный красивый клип.

Как писать хорошие промпты для Kling под разные задачи

Теперь к самому практичному — к промптам.

Общая формула сильного промпта

Хороший промпт для Kling почти всегда состоит из 5 блоков:

- субъект;

- действие;

- камера;

- среда;

- ограничения по качеству.

Пример структуры:

- subject: “young woman in beige trench coat”

- action: “slightly turns her head, hair moves gently in the wind”

- camera: “slow dolly in”

- environment: “soft afternoon light, urban street background”

- quality lock: “preserve facial features, realistic fabric motion, stable background”

Плохой и хороший промпт

Плохой:“beautiful woman cinematic dynamic motion amazing realism dramatic camera”

Хороший:“close-up portrait of a young woman in a beige trench coat, slight head turn, gentle wind moving the hair, slow dolly in camera, soft golden-hour light, background remains stable, preserve facial details and natural skin texture”

Разница в том, что второй промпт:

- задает объект;

- задает конкретное действие;

- задает тип камеры;

- ограничивает хаос;

- подсказывает модели, что важно сохранить.

Промпты для разных задач

1. Оживление портрета

“portrait of a man looking at camera, subtle blink, slight smile, soft breathing motion, slow push in, realistic skin detail, stable background”

Подходит для сценариев Kling ai оживляем фото бесплатно и Kling ai нейросеть оживить фото бесплатно.

2. Fashion / editorial

“full body fashion shot, model slightly shifts weight, coat fabric moves in soft wind, slow side tracking shot, keep body proportions stable, maintain outfit texture”

3. Product video

“luxury perfume bottle on reflective surface, subtle camera orbit, soft light glints, light mist in background, maintain product shape and label clarity”

4. Атмосферная сцена

“abandoned street at dusk, neon sign flickers softly, thin fog drifts through frame, slow cinematic zoom in, preserve architectural details”

5. История с начальным и конечным кадром

“start frame: woman standing still in doorway, end frame: woman turns away into the room, smooth transition, soft ambient motion, maintain scene realism”

Советы по использованию Kling, которые реально работают

Не пытайтесь “сразу в кино”

Новички часто хотят выжать максимум из первого рендера. На практике лучше:

- сделать 3 спокойных варианта;

- сравнить, где движение не ломает кадр;

- потом постепенно усиливать динамику.

Сначала кадр, потом эффект

Если исходная картинка слабая, никакой Kling ai нейросеть бесплатно не спасет. Хороший source image важнее половины промпта. Чем чище композиция, тем легче управлять движением.

Лучше один прием, чем пять

Один хороший dolly-in сильнее, чем одновременно dolly, roll, fog, hair movement, flying particles и head turn.

Описывайте физику, а не “красоту”

Вместо “ultra cinematic masterpiece” пишите:

- gentle wind;

- slow camera push;

- subtle body shift;

- fabric movement;

- stable lighting.

Модель лучше понимает физику сцены, чем абстрактные эпитеты.

Используйте отрицательные ограничения

Если сцена ломается, полезно указывать, что не нужно:

- avoid distortion

- keep face stable

- no excessive motion

- no warping

- stable hands

- preserve background

Для движения лучше меньше, чем больше

Это правило можно повторять десять раз. Именно оно чаще всего отличает дорогой-looking ролик от дешевого.

Примеры хороших пользовательских сценариев

Для контент-мейкера

Есть портрет для Reels. Нужно легкое оживление. Вы не делаете “клип”, вы делаете subtle motion. Результат выглядит как дорогой loop, а не как демонстрация нейросети.

Для бренда одежды

Есть campaign shot. Вы добавляете мягкую динамику ткани и slow camera move. Получается баннер, сторис или превью, которое выглядит премиально без полноценной съемки.

Для интернет-магазина

Есть product image. Вы анимируете свет, партиклы, камеру и чуть-чуть объект. Это уже мини-реклама.

Для художника или иллюстратора

Есть сильная арт-картинка. Вы даете не действие ради действия, а атмосферный motion: туман, свет, глаза, волосы, ткань, перспектива. И иллюстрация “дышит”.

Для новичка

Есть старое фото или красивый portrait render. Вы используете Kling оживить фото и понимаете, что лучший результат — это не “заставить человека танцевать”, а сделать его живым через микро-движение.

Частые ошибки, из-за которых Kling кажется “плохим”

Слишком общий промпт

Если промпт абстрактный, результат часто тоже абстрактный.

Перегрузка движения

Активный объект + активная камера + сложный фон = артефакты.

Плохой source image

Размытый, перегруженный или плохо скомпонованный исходник почти всегда ухудшает результат.

Непонимание приоритета

Если вам важна детализация лица, не делайте сложный экшен. Если важен экшен — смиритесь, что микродетали могут пострадать.

Попытка оживить все сразу

Лучше одно убедительное движение, чем пять спорных.

Ожидание “кнопки шедевра”

Kling — это не магия. Это инструмент, который любит аккуратную настройку.

FAQ

Kling действительно можно использовать бесплатно?

Да, пользователи часто ищут Kling бесплатно, Kling ai бесплатно и Kling нейросеть бесплатно, потому что хотят протестировать базовые сценарии без глубокого входного порога. На практике бесплатный формат чаще всего подходит, чтобы понять логику image-to-video, промптов и управления движением, а уже потом решать, нужен ли более серьезный рабочий режим.

Что лучше для новичка: Kling 2.1 или Kling 2.5 Turbo?

Если говорить пользовательским языком, Kling 2.1 часто воспринимают как понятный ориентир по качеству и стабильности, а Kling 2.5 Turbo — как более динамичную и смелую по движению версию. Но для новичка важнее не номер модели, а то, насколько аккуратно он управляет motion и camera. Даже сильная модель не спасет перегруженный промпт.

Можно ли в Kling оживлять фото людей без странной мимики?

Да, но лучше использовать мягкое движение: моргание, поворот головы, ветер в волосах, легкое дыхание, dolly-in камеры. Чем агрессивнее мимика и движение, тем выше риск артефактов.

Чем Kling отличается от других AI-video сервисов?

Сильнее всего Kling ощущается в image-to-video, работе с движением камеры, локальной анимации через Motion Brush и более киношной подаче движения. Не всегда везде и не во всех задачах, но именно в этих сценариях его часто выбирают осознанно.

Какой самый простой способ улучшить результат в Kling?

Уменьшить количество движения примерно на треть. Это самый недооцененный совет. Большинство роликов становятся лучше не после “усиления магии”, а после того, как пользователь убирает лишнюю амплитуду и оставляет только одно-два понятных движения.

Заключение

Если говорить честно, Клинг ИИ нравится не потому, что умеет делать “волшебно”, а потому что при правильном подходе дает чувство контроля. Ты не просто нажимаешь generate и надеешься на удачу, а реально управляешь тем, как оживает кадр: что движется, насколько сильно, куда идет камера, что нужно удержать, а что можно отпустить.

И в этом, пожалуй, главная ценность Клинг аи и всей экосистемы нейросеть Клинг. Она хорошо чувствует image-to-video, умеет делать красивое движение, дает инструменты для локальной анимации и позволяет не только “оживить фото”, но и собрать короткий, атмосферный, вполне взрослый по ощущению ролик. Особенно если не суетиться, не перегружать сцену и думать как режиссер, а не как человек, который пытается заставить картинку делать все сразу.

Поэтому лучший способ работать с Kling — не искать идеальный “секретный промпт”, а понять логику: меньше хаоса, больше намерения; меньше резких эффектов, больше направленного движения; меньше абстрактных эпитетов, больше конкретной физики кадра. И тогда Клинг нейросеть на русском языке перестает быть просто модной игрушкой и становится действительно полезным видеогенератором, с которым можно делать и контент, и рекламу, и атмосферные ролики, и просто очень красивые штуки, которые приятно пересматривать.