Veo 3 Google AI: нейросеть Вео 3 бесплатно — как использовать референсные изображения для точного контроля кадров

Генерация видео нейросетями вышла из стадии «интересного эксперимента» и стала полноценным рабочим инструментом для контент-мейкеров, маркетологов, продюсеров, дизайнеров, владельцев брендов и всех, кто хочет быстро превращать идею в визуальный результат. Но вместе с ростом качества вырос и главный запрос пользователей: мало просто получить красивый ролик, нужно уметь управлять кадром, удерживать стиль, сохранять персонажа, объект и композицию от сцены к сцене. Именно поэтому вокруг Veo 3 сегодня так много внимания.

Когда люди ищут Veo бесплатно, google Veo 3, Veo 3 бесплатно или Veo нейросеть бесплатно, чаще всего они хотят не абстрактно «попробовать ИИ-видео», а понять, как выжимать из модели предсказуемый и контролируемый результат. В этом смысле Veo 3 бесплатно интересует пользователей не только как точка входа в сервис, но и как способ проверить, насколько точно модель слушается промпта, держит образ и работает с референсами.

Сильная сторона экосистемы Google здесь как раз в том, что она развивает не только саму модель, но и инструменты управления генерацией. В официальной справке Flow Google отдельно описывает два ключевых механизма контроля: Ingredients — когда вы добавляете референсные изображения или видео как «ингредиенты» сцены, и Frames — когда задаете стартовый и финальный кадр для генерации перехода или направленного движения. Эти функции доступны в Flow и прямо влияют на предсказуемость результата.

Если говорить проще, то современный Veo ai — это уже не «генератор случайных красивых роликов», а система, в которой можно управлять тем, что именно появится в кадре, как будут выглядеть персонажи, какие объекты должны повторяться, как сцена начнется и чем закончится. В этой статье разберем, как работает Veo 3 нейросеть, что сейчас означает Veo 3.1, где реально есть ограниченный бесплатный доступ, как использовать референсные изображения для точного контроля кадров и почему без них даже хороший промпт часто проигрывает в стабильности.

Почему вокруг Veo 3 такой интерес

Причина популярности понятна: Google продвигает Veo как одну из самых сильных моделей для генерации видео, а в официальном описании DeepMind делает акцент на нативном аудио, реалистичности, физике движения и точности следования промпту. Для рынка это важный сигнал: модель воспринимается не просто как еще один text-to-video-инструмент, а как шаг в сторону более кинематографичного и управляемого видео.

Дополнительный интерес появился после того, как Google вывел генерацию Veo в более широкий пользовательский контур: Flow, Gemini, Google Vids, YouTube Shorts, а позже и другие связанные продукты. Это означает, что google Veo нейросеть перестала быть только лабораторной демонстрацией и стала инструментом с разными сценариями применения — от быстрых вертикальных роликов до более продуманного сценического монтажа.

Особенно важным стало развитие версии Veo 3.1. По официальным материалам Google, именно Veo 3.1 получил улучшения в Ingredients to Video, нативную вертикальную генерацию 9:16 и апскейл до 1080p или 4K, а также усилил консистентность персонажей, фонов и объектов между сценами. Для тех, кто строит сериальный контент, рекламу, сторителлинг или продуктовые видео, это не косметическое обновление, а реальная прибавка к контролю.

Поэтому запросы вроде Veo 3 ai, Veo video, Veo 3 видео, Veo video и генерация Veo — это уже не про «новую игрушку», а про рабочую задачу: как сделать так, чтобы модель не просто генерировала эффектно, а работала предсказуемо и повторяемо.

Что такое Veo нейросеть в экосистеме Google

Если говорить без лишней теории, Veo нейросеть — это семейство моделей Google DeepMind для генерации видео. Но на практике пользователю важно не только «что это за модель», а где и как он с ней взаимодействует. И вот здесь экосистема делится на несколько уровней.

Первый уровень — сама модель как технологическое ядро. В публичных описаниях Google Veo подается как система генерации видео высокого качества с акцентом на реализм, физику, промпт-адхеренс и, для Veo 3, нативный звук.

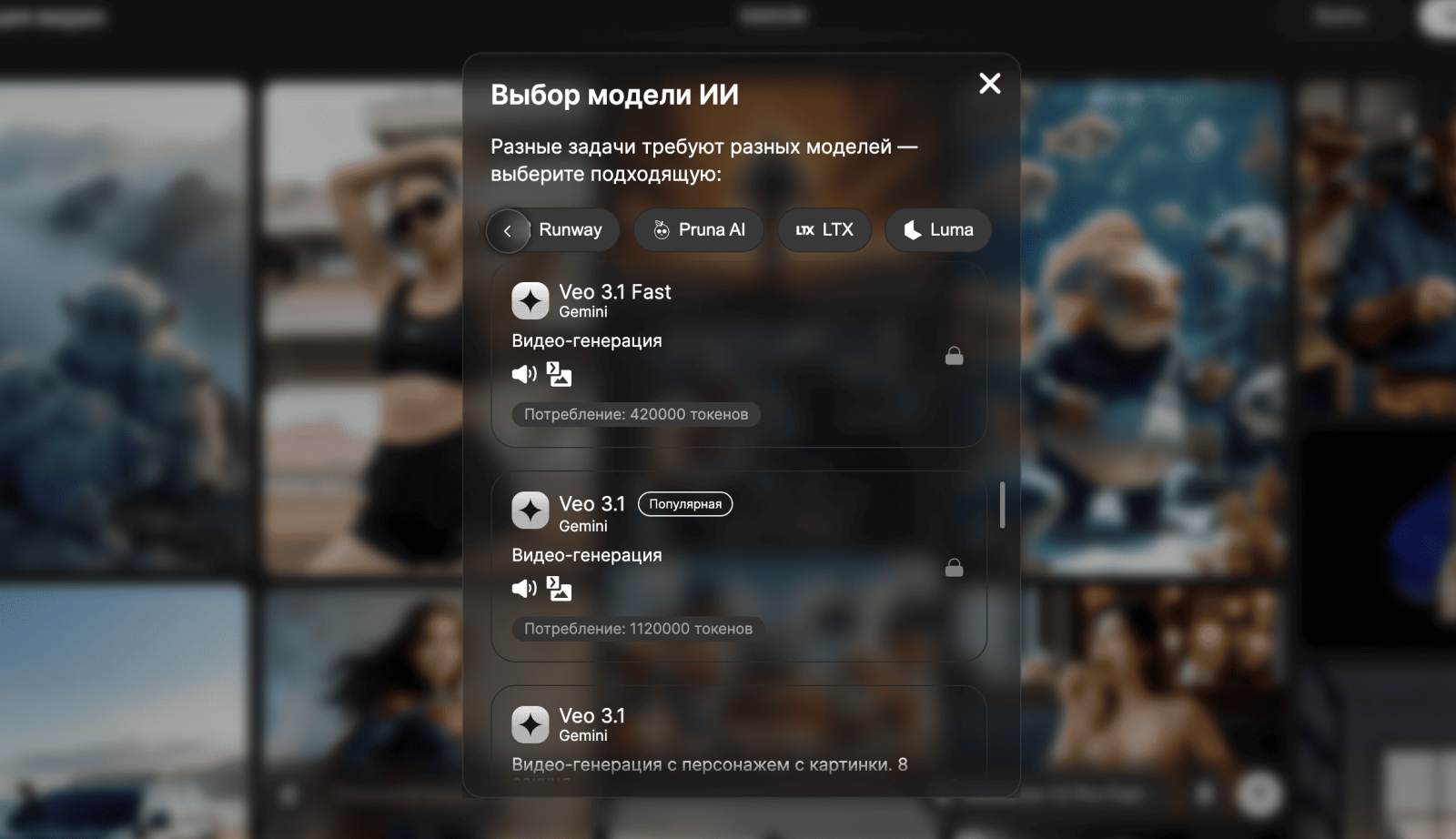

Второй уровень — интерфейсы и продукты, где Veo используется. На сегодня официальные материалы Google указывают Flow как ключевой инструмент для более продвинутой постановки сцены, а также Gemini app, Google Vids, YouTube Shorts, Gemini API и Vertex AI как точки доступа к возможностям google Veo ai и особенно Veo 3.1.

Третий уровень — планы доступа. И здесь начинается то, что обычно интересует пользователей больше всего: насколько реален запрос google Veo бесплатно. На официальной странице Flow прямо указано, что без подписки доступен бесплатный слой: 100 стартовых кредитов и 50 кредитов ежедневно, при этом в списке доступных функций указаны Veo 3.1, Text to Video, Frames to Video и Ingredients to Video. Это важная деталь: ограниченный бесплатный доступ к Veo в Flow действительно заявлен официально.

Но при этом максимальные лимиты, 1080p-апскейл и повышенный доступ Google относит уже к платным планам вроде Google AI Pro и Ultra. То есть формулировка Veo 3 нейросеть бесплатно сегодня честно трактуется так: попробовать можно бесплатно в ограниченном формате, но высокий объем генераций и расширенные лимиты уже относятся к подписке.

Чем Veo 3 отличается от Veo 2 и почему все говорят про Veo 3.1

Для пользователя эволюция линейки важна не ради сравнения «что новее», а ради понимания, где действительно прибавилось контроля. Условно говоря, Veo 2 — это уже сильный этап развития видеогенерации Google, но интерес к google Veo 3 связан именно с переходом к более кинематографичной, аудиально насыщенной и управляемой модели.

Официально Google DeepMind описывает Veo 3 как модель, которая нативно генерирует звуковые эффекты, амбиент и даже диалог, одновременно сохраняя высокий уровень реализма и точности следования промпту. Это важный сдвиг: пользователь начинает думать не только о «картинке», но и о целостной сцене.

Но если говорить о референсных изображениях, то особенно заметный поворот происходит именно в Veo 3.1. Google отдельно выпустила обновление, посвященное Ingredients to Video, где сделала акцент на лучшей консистентности персонажей, объектов и фонов, поддержке вертикального 9:16, мобильному сценарию и апскейлу до 1080p/4K. Для продюсеров, SMM-команд и рекламных креаторов это фактически означает, что Veo 3.1 — версия, с которой референсы начинают играть центральную роль в продакшене.

Именно поэтому в рабочей среде сейчас важно не просто знать слова Veo 2, Veo 3, Veo 3.1, Вео и Вео 3, а понимать их прикладной смысл. Если вам нужна общая генерация — это один разговор. Если нужен контроль персонажа, предмета, фона, стартового и финального кадра — это уже сценарий, в котором Veo 3.1 выглядит особенно сильным.

Почему без референсов даже хороший промпт часто проигрывает

Одна из главных иллюзий AI-видео в том, что достаточно «написать красивый промпт» и модель сама попадет в нужный визуальный образ. На практике этого почти никогда не хватает, если вам важны повторяемость и точность.

Промпт хорошо описывает:

- атмосферу;

- действие;

- стилистику;

- движение камеры;

- цвет;

- настроение;

- жанр.

Но промпт слабо закрепляет:

- конкретное лицо персонажа;

- дизайн предмета;

- точную форму продукта;

- идентичность локации;

- повторяемость объекта между роликами;

- стабильность фактуры и деталей.

Именно тут и вступают в игру референсные изображения. Если вы работаете через Veo официальный сайт экосистемно, то в Flow референсы подаются как Ingredients, а в режиме Frames — как старт и финиш сцены. Это дает модели не только словесное описание, но и визуальную опору. В результате не приходится каждый раз надеяться, что Veo сайт поймет вас «достаточно близко».

Для коммерческой работы это критично. Если вы генерируете серию роликов под бренд, персонажа или продукт, вам нужна не красивая случайность, а стабильность. Поэтому связка промпт + референсы на практике почти всегда сильнее, чем просто очень подробный текст.

Какие типы референсных изображений работают лучше всего

Официальная справка Flow дает важную подсказку: для лучших результатов Google рекомендует использовать subject или product references на plain or segmented background — то есть персонажей и продукты на простом или сегментированном фоне. Это не случайный совет, а рабочее правило.

На практике лучше всего работают несколько типов референсов.

Чистый референс персонажа

Если вы хотите сохранить лицо, прическу, силуэт, одежду или общий образ, самый сильный вариант — один четкий референс без лишнего фона и шумных деталей. Это особенно полезно, когда вы хотите удержать героя от сцены к сцене.

Предметный референс

Для брендов, e-commerce и рекламы это почти обязательный сценарий. Продукт на нейтральном фоне считывается моделью лучше, чем предмет, потерянный внутри сложной композиции. Так легче контролировать форму, пропорции и узнаваемость.

Локационный референс

Если важно удержать ощущение одной и той же среды — офиса, кафе, мастерской, спальни, студии, улицы, интерьерной зоны — полезно давать отдельный кадр пространства как «ингредиент» сцены.

Текстурный или стилевой референс

Иногда вы хотите не буквальную копию объекта, а характер света, палитры, фактуры, пленочного зерна, стилевой обработки. В этом случае референс задает не «кто в кадре», а «как должен ощущаться кадр».

На практике сильнее всего работает разделение ролей: один референс — на героя, второй — на предмет, третий — на локацию. Именно такой сценарий Google показывает и в Google Vids, где поддерживается до трех reference images as ingredients.

Как использовать Ingredients для точного контроля сцены

В Flow механизм Ingredients — один из самых полезных инструментов для управляемой генерации. По официальной инструкции вы можете добавить reference image или video, а затем прямо в промпте описать, как использовать эти ингредиенты внутри клипа. Google даже приводит пример со смешением женщины, лавовой лампы и туманной улицы в единый образ сцены.

Но для коммерческой и продакшн-работы Ingredients лучше использовать чуть строже.

Роль каждого референса должна быть понятна

Не загружайте три случайных картинки и не ждите, что модель сама разберется, что из них важнее. Лучше логически разделять:

- персонаж;

- объект;

- пространство.

Прямо называйте функцию изображения в промпте

Не просто «сделай сцену с этими картинками», а:

- используй первого персонажа как главного героя;

- используй кружку со второго изображения как точный объект в руках;

- сохрани интерьер из третьего изображения как основную локацию.

Не перегружайте сцену лишними задачами

Чем больше целей у одной генерации, тем выше шанс распада образа. Если нужен точный контроль, лучше делать сцену проще, а сложный нарратив собирать из нескольких клипов.

Повторно используйте те же референсы

Google прямо указывает, что повторное использование reference images помогает держать consistent characters, design and objects across multiple clips. Для сериализованного контента это ключевая стратегия.

Если коротко, Ingredients — это инструмент не «добавить картинку ради вдохновения», а закрепить визуальные сущности внутри генерации.

Как использовать Frames для контроля начала и конца ролика

Если Ingredients помогают закрепить сущности, то Frames помогают закрепить траекторию. В Flow отдельно есть режим Frames, где можно добавить start frame и end frame, а затем описать, что должно произойти между ними. Это один из самых мощных способов управлять драматургией короткого AI-клипа.

На практике Frames особенно полезны в трех сценариях.

Контролируемый переход

Например, вам нужно, чтобы сцена началась крупным планом продукта на столе, а закончилась общим планом комнаты. Стартовый и финальный кадр задают диапазон, внутри которого модель достраивает движение.

Анимация статичного изображения

Если у вас есть сильный key visual, через start frame можно заставить модель «оживить» его и довести к конкретному финальному состоянию.

Поддержание композиционной логики

Когда вы делаете серию кадров для одного ролика или кампании, start/end frames помогают удерживать композиционный ритм, а не получать каждый раз полностью непредсказуемое поведение камеры.

Это особенно важно для тех, кто хочет делать не просто Veo видео, а ощущение монтажной последовательности. В таком случае Frames становятся буквально инструментом режиссуры.

Лучшая практика: сочетать Ingredients и Frames

Многие пользователи работают либо с референсами-ингредиентами, либо со стартом-финишем. Но максимальный контроль обычно появляется именно в сочетании этих подходов.

Условно:

- Ingredients отвечают на вопрос «кто и что в кадре»;

- Frames отвечают на вопрос «откуда и куда идет сцена».

Если вы хотите, чтобы герой оставался тем же, продукт был тем же, интерьер узнавался, а движение камеры при этом вело от одной конкретной композиции к другой, одной только текстовой инструкции уже мало. Именно поэтому рабочая связка выглядит так:

- Дать персонажа/объект/локацию как Ingredients.

- Задать точный стартовый и финальный кадр через Frames.

- Сформулировать промпт как описание действия, а не попытку заново описать все с нуля.

Для тех, кто осваивает Veo 3 нейросеть бесплатно в Flow, это один из самых полезных инсайтов: не пытаться выжать весь контроль из одного промпта. Модель работает заметно лучше, когда вы даете ей разные типы ограничителей.

Как писать промпт, если у вас уже есть референсы

Когда подключаются референсные изображения, сам промпт меняется. Ошибка новичков в том, что они продолжают описывать всё подряд слишком подробно, как будто модель не видит приложенные изображения.

На практике промпт с референсами должен:

- уточнять роли референсов;

- описывать действие;

- задавать операторскую логику;

- задавать атмосферу;

- задавать ограничения, которые не видны на референсе.

Например, вместо длинного описания персонажа, который уже есть в reference image, лучше сосредоточиться на:

- движении;

- мизансцене;

- темпе;

- типе плана;

- угле камеры;

- эмоции;

- свете;

- саунд-дизайне, если это поддерживает модель.

Для Veo 3 ai особенно полезно писать промпт как режиссерскую инструкцию:

- wide shot / close-up / medium shot;

- handheld / static / dolly-in;

- dusk / cold fluorescent office / golden hour;

- calm tension / energetic launch vibe / intimate realism.

Именно это помогает получать кадры, которые ощущаются точнее и взрослее, чем просто «красивая нейросеточная генерация».

Как добиться консистентности персонажа между несколькими роликами

Одна из главных проблем AI-видео — дрейф персонажа. В одном ролике герой выглядит почти идеально, во втором меняются черты лица, в третьем пропадает узнаваемость, в четвертом ломается одежда или прическа.

Google отдельно подчеркивает, что в Veo 3.1 Ingredients to Video улучшает identity consistency и помогает удерживать персонажа одним и тем же even as the setting changes. Это один из самых сильных официальных сигналов, что референсы нужно использовать именно для долгих серий, а не только для одного клипа.

Чтобы реально удерживать персонажа:

- используйте один и тот же базовый портретный референс;

- не меняйте одновременно лицо, одежду и фон без необходимости;

- сохраняйте близкий тип света между сценами;

- повторно используйте те же references;

- в промпте называйте героя одинаково;

- для сложных серий держите отдельный «библиотечный» набор reference images.

Для брендов и контент-команд это важнейшая практика. Если вы делаете персонажный канал, серию промо или фирменный storytelling, стабильность героя часто важнее, чем разовая зрелищность кадра.

Как удерживать объект и продукт в рекламных роликах

Для e-commerce, брендов и агентств точный контроль объекта — это практически главная задача. И именно здесь google Veo ai становится особенно интересным, потому что вы можете не только описать продукт словами, но и реально подать его как референс.

Чтобы продукт не «плыл»:

- загружайте его на простом фоне;

- выбирайте изображения без лишних предметов-конкурентов;

- не давайте слишком разные ракурсы на старте, если вам нужен один стабильный объект;

- в промпте указывайте, что предмет должен сохранять exact shape / color / material feel;

- если продукт брендовый, отдельно фиксируйте логотип, упаковку, цветовой код и пропорции.

Google в справке Flow прямо советует plain or segmented background для subject/product references — и это особенно полезно именно в продуктовых задачах.

Если задача стоит как «сделать рекламу, где объект стабилен в каждом клипе», то Veo 3 видео с Ingredients — это уже не просто генеративная игра, а реальный pre-production или even lightweight production tool.

Как работать с вертикальным видео и мобильными форматами

Еще одна важная причина, почему все заговорили про Veo 3.1, — поддержка native vertical outputs for Ingredients to Video. Для YouTube Shorts, Reels и TikTok это критично: вертикальный формат нужен не как обрезанная версия горизонтального, а как полноценная постановка под мобильный экран.

Если вы делаете вертикальное видео:

- сразу стройте композицию под 9:16;

- не пытайтесь переносить горизонтальную логику в вертикаль один в один;

- используйте более явный центр интереса;

- давайте объект или героя крупнее;

- проверяйте, чтобы важные детали не уходили за safe area;

- если работаете через Ingredients, подбирайте референсы с учетом вертикальной читаемости.

Для мобильного контента это дает большой плюс. Раньше приходилось либо мириться с обрезкой, либо заново собирать сцену. Теперь Вео 3 и особенно Veo 3.1 позволяют изначально думать мобильным кадром.

Как выстроить рабочий пайплайн с референсами

Если вы хотите не просто «поэкспериментировать», а построить нормальный продакшн-процесс, лучше сразу работать системно.

Шаг 1. Соберите библиотеку референсов

Отдельно храните:

- персонажей;

- продукты;

- локации;

- текстуры;

- световые схемы;

- ключевые стилевые изображения.

Шаг 2. Назовите ассеты понятно

В Flow можно искать загруженные assets через @, и это становится намного удобнее, если вы заранее называете материалы последовательно.

Шаг 3. Делайте не один «идеальный» ролик, а систему клипов

Сначала тестируйте один объект, затем один персонаж, потом сочетание, потом переходы между кадрами.

Шаг 4. Используйте одни и те же ингредиенты повторно

Это лучший путь к консистентности.

Шаг 5. Отдельно тестируйте Frames

Не смешивайте сразу слишком много задач. Иногда полезно отдельно проверить start/end behavior, а потом уже соединять его с Ingredients.

Такой пайплайн позволяет превратить Veo 3 нейросеть бесплатно из режима хаотичных проб в реальный рабочий инструмент.

Частые ошибки при работе с референсами

Даже сильная модель не спасает от плохой постановки задачи. Чаще всего проблемы возникают не из-за Veo, а из-за логики пользователя.

Слишком много ролей у одной картинки

Если на одном референсе и герой, и объект, и фон, и атмосфера, модель может интерпретировать это слишком свободно.

Случайный набор изображений

Reference images должны работать как система, а не как папка «что под руку попалось».

Перегруженный промпт

Когда вы одновременно пытаетесь задать внешний вид героя, предмет, свет, сюжет, пять действий, сложный саунд и драматическую трансформацию — модель начинает терять фокус.

Отсутствие повторяемости

Если в каждой новой сцене вы даете новые reference images, а потом хотите «стабильного героя», вы сами ломаете консистентность.

Слишком раннее желание «сразу в идеал»

Сначала лучше отработать персонажа, потом объект, потом сцену, потом переход между сценами. Так контроль растет быстрее.

Именно поэтому тем, кто впервые осваивает Вео нейросеть, полезно начинать не с амбиции «сделаю сразу рекламный фильм», а с нескольких коротких тестов на предмет и персонажа.

Реально ли получить бесплатный доступ для обучения и тестов

Если говорить строго по официальной информации, да — для обучения, тестов и первых производственных экспериментов это реально. Но с оговорками.

Flow сейчас официально показывает free tier с 100 бесплатными кредитами и 50 ежедневными кредитами, а в списке функций там прямо указан Veo 3.1, Text to Video, Frames to Video и Ingredients to Video. Это делает Flow одним из самых практичных входов для тех, кто хочет понять, как работает Veo нейросеть бесплатно в реальном интерфейсе.

Для более серьезной работы Google предлагает AI Pro с пробным месяцем и 1000 monthly AI credits в Flow, плюс higher access к Veo в Gemini app и Flow. Ultra уже дает highest access. То есть если ваша цель — научиться работать с референсами, собрать пайплайн и проверить сценарии кадрового контроля, бесплатного слоя достаточно, чтобы понять механику. А вот если нужен production-scale процесс, почти наверняка придется двигаться в сторону подписки.

Поэтому ответ на вопрос «можно ли освоить Veo 3 бесплатно?» — да, в ограниченном режиме можно. Ответ на вопрос «можно ли построить на этом безлимитный поток коммерческой генерации?» — уже нет, официально такой режим Google не обещает.

Как понять, когда вам нужен именно Flow, а не просто генерация в Gemini

Есть хороший практический критерий.

Если вам нужно:

- быстро проверить идею;

- сделать короткий one-off clip;

- набросать визуальный референс для обсуждения;

- сгенерировать одиночный ролик без сложной консистентности,

тогда Gemini с доступом к Veo 3.1 Fast может быть удобнее и быстрее. Google официально разделяет эти сценарии через планы и лимиты Gemini app.

Если же вам нужно:

- референсное управление сценой;

- start/end frames;

- работа с ingredients;

- библиотека ассетов;

- повторяемость персонажей и объектов;

- более профессиональная постановка,

тогда нужен именно Flow. Это и есть причина, почему в креативной среде Veo сайт часто понимают не как одну страницу модели, а как доступ к целой рабочей среде.

Кому особенно полезен контроль кадров через референсы

Эта тема не для всех пользователей одинаково важна. Если вы просто делаете забавные короткие ролики «на попробовать», возможно, вам хватит и простого промпта. Но есть группы, для которых референсы — почти обязательная часть работы.

Это:

- бренды и e-commerce;

- рекламные команды;

- SMM и контент-студии;

- креативные агентства;

- продюсеры коротких сериализованных форматов;

- ютуб-авторы;

- создатели шортсов;

- дизайнеры, которые переводят бренд-визуал в motion;

- filmmakers, использующие AI для previs и ideation.

Для всех них точность кадра — не эстетическая прихоть, а бизнес-задача. Если персонаж каждый раз другой, продукт меняет форму, а локация «плывет», ролик перестает быть полезным. Поэтому именно в этих сегментах Veo 3 ai и режимы Ingredients/Frames раскрываются сильнее всего.

FAQ

Можно ли использовать Veo 3 бесплатно без подписки?

Да, частично можно. На странице Flow Google указывает бесплатный уровень с 100 стартовыми кредитами и 50 кредитами ежедневно, а в списке доступных возможностей там есть Veo 3.1, Text to Video, Frames to Video и Ingredients to Video. Но безлимитный полный доступ бесплатно официально не заявлен.

Чем Veo 3.1 лучше для работы с референсами, чем ранние версии?

Google отдельно пишет, что Veo 3.1 улучшил Ingredients to Video, сделал сильнее identity consistency, удержание объектов и фонов, а также добавил native vertical output и апскейл до 1080p/4K. Для серийной генерации и точного контроля сцен это важное обновление.

Что лучше использовать для контроля кадров: Ingredients или Frames?

Они решают разные задачи. Ingredients помогают закрепить персонажа, объект, стиль или локацию. Frames помогают задать начало и конец сцены. Максимальный контроль обычно получается, когда вы сочетаете оба режима в одной постановке.

Можно ли через gemini Veo делать то же самое, что через Flow?

Не полностью. Gemini app подходит для более быстрых и легких сценариев, а Flow — для более профессионального управления сценами, ассетами, Ingredients и Frames. Поэтому для серьезного контроля кадров Flow обычно предпочтительнее.

Какой главный совет для тех, кто только осваивает Вео нейросеть?

Не пытайтесь сразу делать сложный ролик только на промпте. Сначала соберите чистые референсы персонажа, объекта и фона, потом протестируйте Ingredients, затем отдельно проверьте Frames, и только после этого переходите к более сложным сценам. Так вы быстрее научитесь получать предсказуемый и качественный результат.

Итоги: как использовать референсные изображения для точного контроля кадров

Если свести все к практике, то главный вывод простой: референсы в Veo 3 — это не дополнительная опция «для красоты», а основной инструмент контроля. Именно они помогают удерживать лицо, объект, фон, композицию, ощущение пространства и переход между кадрами. Без них даже хороший промпт слишком часто приводит к визуальной вариативности, которая мешает реальной работе.

Официальные материалы Google подтверждают, что в Flow доступны Ingredients и Frames, что Veo 3.1 усилил consistency для персонажей, объектов и фонов, а также что ограниченный бесплатный доступ существует через free tier Flow с начальными и ежедневными кредитами. Одновременно Google четко показывает: расширенные лимиты, higher access и highest access уже относятся к AI Pro и Ultra.

Поэтому если ваша цель — освоить Вео 3, понять механику референсов и научиться точнее управлять генерацией, лучший путь выглядит так: начать с бесплатного слоя, собрать библиотеку референсов, тестировать Ingredients отдельно от Frames, потом соединять их в единый пайплайн и только после этого масштабировать процесс. В таком подходе Veo бесплатно перестает быть просто заманчивой фразой, а становится реальной точкой входа в управляемый AI-видеопроцесс.