ИИ для создания видео: как создать неросетью видео онлайн и какую выбрать в 2026 году

Создать видео с помощью ИИ сегодня можно буквально за несколько минут: достаточно описать сцену текстом, загрузить изображение или фото, выбрать стиль, формат и модель генерации. Нейросети умеют делать ролики из текста, оживлять статичные изображения, улучшать качество видео, создавать короткие клипы для соцсетей, рекламы, презентаций и контента для бизнеса.

В статье разберем:

- что такое ИИ для создания видео и как он работает;

- какие возможности есть у нейросетей для генерации видео;

- чем полезен сервис Imagify.ru;

- как пошагово создать видео из текста или фото;

- какие модели сейчас самые популярные: Veo, Kling, Grok, Sora;

- какие типы видео можно делать с помощью ИИ;

- где использовать AI-видео в бизнесе, соцсетях и личных задачах;

- какие есть бесплатные сервисы и ограничения бесплатных тарифов;

- какую нейросеть лучше выбрать под разные задачи;

- что важно знать про законность, авторские права и использование чужих образов;

- какие промпты работают лучше всего и какие есть лайфхаки для качественной генерации;

- какие выводы можно сделать при выборе ИИ-сервиса для видео.

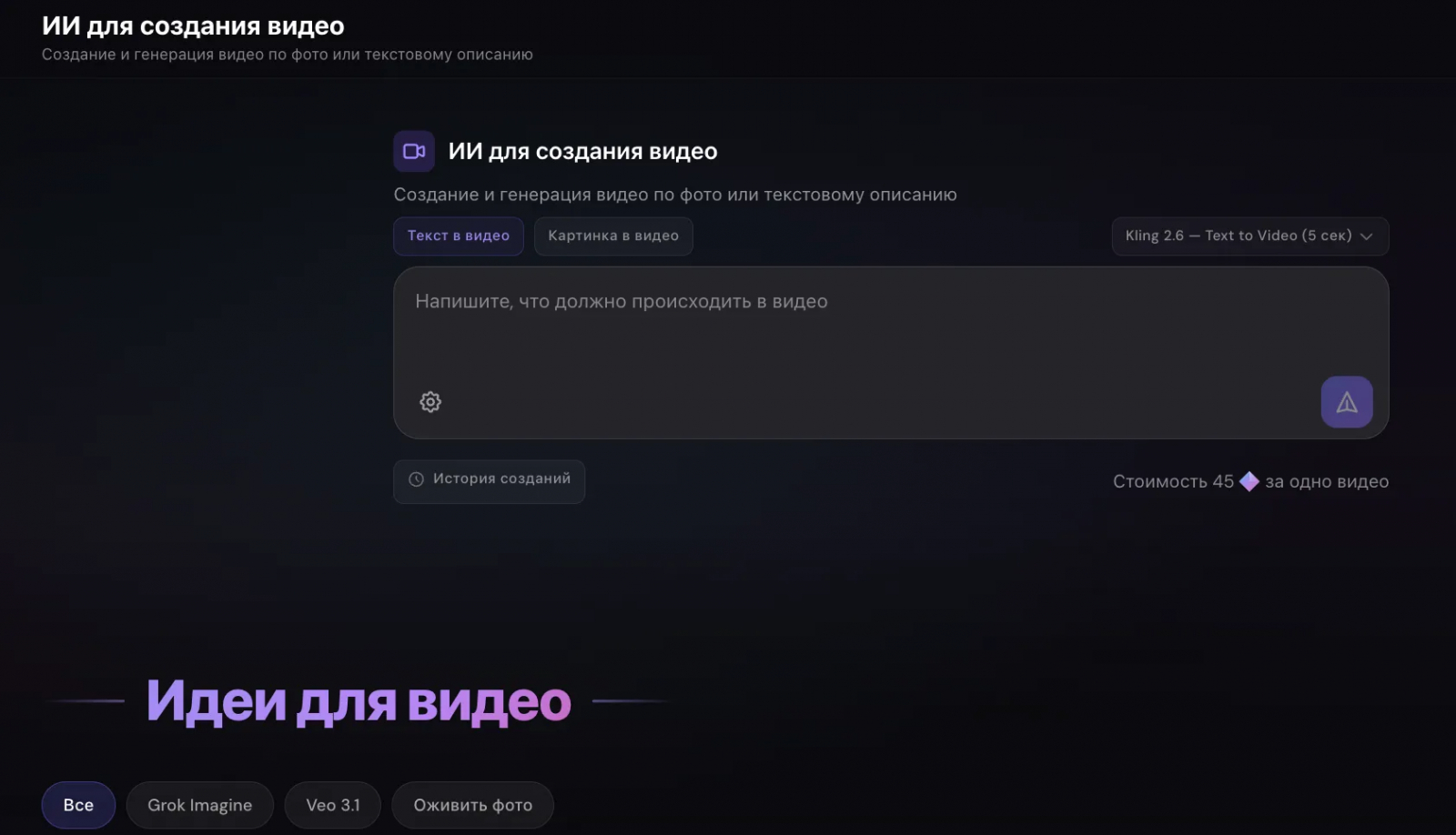

Сервис Imagify.ru объединяет популярные инструменты для генерации видео в одном интерфейсе: здесь доступны модели Veo 3.1, Kling, Sora, Grok Imagine, а также функции оживления фото, Motion control и каталог готовых промптов. Это удобно для пользователей из России, так как сервис работает без обходных расширений, поддерживает оплату в рублях и предлагает готовые сценарии для быстрого старта.

Что такое ИИ для создания видео

Нейросеть для создания видео — это модель искусственного интеллекта, которая генерирует ролик на основе входных данных: текстового описания, изображения, фотографии, иногда — видео-референса с движением. На практике пользователь задает сцену, стиль, движение камеры, атмосферу, формат и длительность, а система собирает из этого новый видеоряд. На Imagify отдельные сценарии прямо описаны как генерация видео по тексту, изображению или сценарию, а также как оживление фото и text-to-video / image-to-video режимы для разных моделей.

Главное отличие AI video generator от обычного видеоредактора в том, что нейросеть не просто склеивает готовые фрагменты, а создает новый контент по вашему запросу. То есть вы можете не иметь отснятого материала вообще: достаточно описать, что должно происходить в кадре. В результате ИИ для видео подходит не только для монтажа, но и для генерации новых сцен, анимации персонажей, визуализации идей и тестирования креативов до запуска полноценного продакшена.

Что умеют современные нейросети для видео

Современные сервисы умеют намного больше, чем просто «оживить картинку». Базовый сценарий — это генерация видео по тексту: вы описываете сцену, персонажа, действие, стиль, свет, настроение, движение камеры, а модель создает короткий ролик по этому описанию. На Imagify такие режимы доступны, например, для Veo 3.1 и Grok Imagine, где страницы прямо отмечают сценарии text-to-video и работу с картинкой как входными данными.

Второй популярный формат — создать видео из фото нейросетью. Это особенно востребовано, когда нужно оживить портрет, сделать эффект движения, превратить карточку товара в динамичный контент или создать короткий ролик на основе одного изображения. У Imagify есть отдельная страница для «Оживления фото ИИ», где такой сценарий вынесен в самостоятельный инструмент.

Третий важный класс — Motion Control, когда нейросеть принимает не только фото, но и референсное видео с движением. В этом случае система не просто «угадывает» анимацию, а старается перенести характер движений из видео на персонажа в изображении. На странице Kling Motion Control у Imagify пользователь загружает фото и видео, после чего нейросеть переносит движение на персонажа из фото.

Кроме генерации, пользователи часто ищут ИИ редактор видео, улучшение качества видео нейросетью, озвучку видео ИИ, перевод видео. Эти задачи уже лежат на стыке генерации, постобработки и контент-пайплайна. На практике нейросети чаще всего используют как часть цепочки: сначала сделать основу ролика, потом доработать изображение, добавить озвучку, адаптировать формат под площадку и улучшить подачу.

Описание сервиса и нейросети Imagify

Imagify.ru — это сервис, в котором собраны сценарии генерации изображений и видео на базе разных AI-моделей. По открытым страницам сайта видно, что в видео-направлении сервис предлагает создание роликов по тексту, картинке или сценарию, отдельный блок «Оживить фото», а также разделы с прямыми нейросетями, включая Grok Imagine и Veo 3.1.

Для пользователей из России сервис выглядит удобным по нескольким причинам. На страницах сайта указаны работа для ряда сценариев, вход через популярные аккаунты, поддержка оплаты в рублях через ЮKassa и наличие каталога идей / промптов, которые можно использовать как шаблоны. На странице Kling Motion Control также сказано, что статус генераций отображается в истории, а при ошибке или отмене средства автоматически возвращаются на баланс.

Imagify подойдет тем, кто хочет не разбираться отдельно в десятках сервисов, а в одном интерфейсе тестировать разные сценарии: создать видео с помощью нейросети, оживить фото, сделать ИИ-видео из изображения, попробовать Veo, Kling, Grok и подобрать вариант под конкретную задачу.

Пошаговая инструкция: как создать видео с помощью нейросети

1. Выберите сценарий генерации

Сначала нужно понять, какой результат вам нужен: видео по тексту, видео из картинки, оживление фото или перенос движения с референсного видео. На Imagify для этого есть разные разделы, в том числе общая страница генерации видео, страница оживления фото и отдельный инструмент Kling Motion Control.

2. Определите подходящую модель

Если вам нужен ролик по описанию — можно смотреть в сторону Veo 3.1 или Grok Imagine. Если хотите анимировать фото или задать движение через референс, логично использовать Kling Motion Control. На сайте Imagify эти модели и сценарии уже разведены по отдельным страницам и категориям.

3. Подготовьте входные данные

Для text-to-video нужен качественный промпт. Для image-to-video — исходное изображение. Для Motion Control — фото персонажа и видео с движением. На странице Kling Motion Control отдельно указаны требования к материалам: в кадре должен быть один человек, голова, плечи и торс должны быть видны полностью, вокруг должно быть свободное пространство, а лицо на фото не должно быть слишком мелким или размытым.

4. Настройте генерацию

Далее выбираются параметры: модель, режим, иногда ориентация персонажа и разрешение. На странице Kling Motion Control такие настройки отмечены отдельно, а для Veo и Grok на страницах видны сценарии text-to-video и работа с картинкой как входом.

5. Запустите генерацию

После отправки запроса остается дождаться результата. Для Kling Motion Control на сайте указано, что генерация обычно занимает 10–20 минут, реже — до 30 минут. Статус отслеживается в разделе истории.

6. Оцените результат и доработайте промпт

Почти всегда хороший AI-ролик получается не с первой попытки, а после 2–3 итераций. Меняют силу описания, уточняют действия в кадре, перестраивают композицию, упрощают сцену или загружают другое изображение. Именно итеративная работа обычно и дает самый сильный результат.

Что умеет нейросеть для создания видео

Когда пользователи ищут «ИИ сделать видео» или «нейросеть для видео», они обычно имеют в виду один из нескольких сценариев.

Первый сценарий — видео по тексту. Вы описываете, что должно происходить: «девушка идет по ночному городу под неоновым светом, cinematic, slow motion, shallow depth of field», и нейросеть пытается собрать такой ролик. На Imagify text-to-video явно указан у Veo 3.1 и Grok Imagine.

Второй сценарий — видео из фото. Это формат, который часто ищут как «сделать видео из фото нейросеть», «создать видео из фото ИИ», «видео из картинки нейросеть». У Imagify для этого есть как минимум отдельная страница «Оживить фото ИИ», а также режимы, где изображение используется как обязательный вход для генерации.

Третий сценарий — перенос движения. Он особенно популярен для трендового контента, танцев, мемов, сторис и коротких вирусных роликов. В Imagify это вынесено в отдельный продукт Kling Motion Control, где логика описана максимально прямо: загружаются фото и видео с движением, после чего персонаж с фото повторяет движение из референса.

Четвертый сценарий — улучшение креатива. Даже если нейросеть не дает финальный ролик «под ключ», она позволяет быстро собрать концепт, рекламный тест, анимацию для карточки товара, тизер, заставку, mood video или основу для дальнейшего монтажа.

Какие есть самые популярные ИИ для видео: Veo, Kling, Grok, Sora

Среди популярных названий, которые чаще всего встречаются в запросах на тему AI video, выделяются Veo, Kling, Grok и Sora. На самом сайте Imagify в открытых разделах для видео явно представлены Veo 3.1, Grok Imagine и Kling Motion Control. В карточках сайта и меню также упоминается Sora как один из ориентиров в тематике сервиса, но по открытым страницам, которые удалось проверить, самые подробно оформленные видео-разделы — это именно Veo, Grok и Kling Motion Control.

Veo

Veo 3.1 нейросеть Google для генерации видео, доступная в России через сервис. Этот вариант логично рассматривать, когда нужен text-to-video или image-to-video сценарий с аккуратной генерацией под запрос.

Kling

Kling особенно силен там, где нужно оживление персонажа, движение, работа с фото и motion-based ролики. На Imagify отдельный упор сделан на Kling 2.6 Motion Control, где можно переносить движения и танцы из видео на статичное фото.

Grok

Grok Imagine в рамках Imagify описан как нейросеть для генерации видео онлайн, причем на странице отдельно упомянуты сценарии «текст в видео» и «картинка в видео». Это удобный вариант для тех, кто хочет быстро протестировать разные форматы генерации в одном интерфейсе.

Sora

Запросы вида «sora ai video», «sora ии видео», «нейросеть для видео sora» очень популярны в поиске как синонимы генерации видео ИИ. В структуре темы Sora уместно сравнивать как один из заметных ориентиров рынка, но в статье для Imagify практичнее делать акцент на тех моделях и режимах, которые у сервиса уже явно представлены на открытых страницах.

Типы контента, которые можно создавать с помощью ИИ-видео

Нейросеть для создания видео полезна не только для «красивых экспериментов». На практике AI-видео делят на несколько понятных типов.

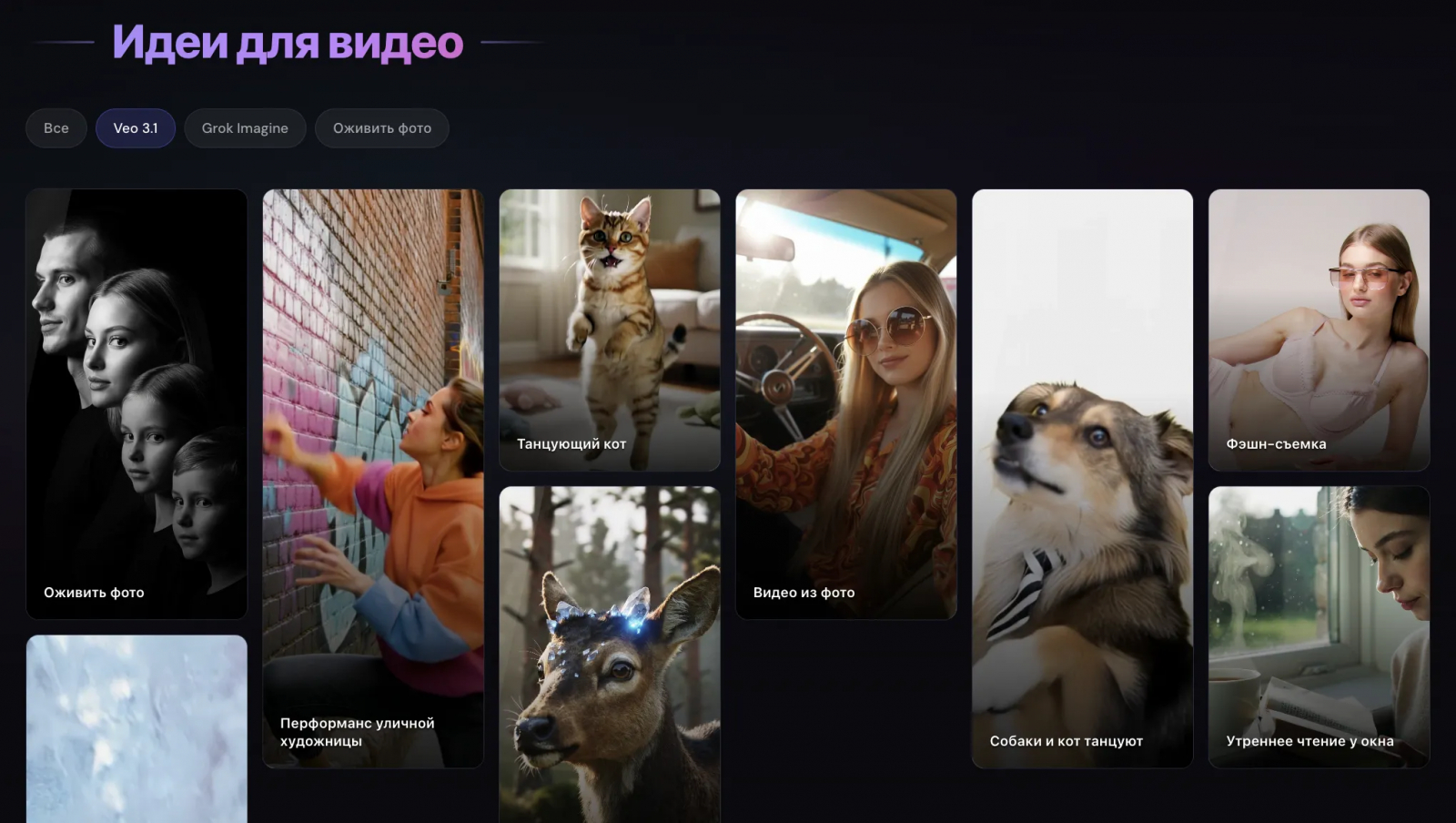

Короткие вертикальные ролики для соцсетей. Это один из самых частых сценариев: Reels, Shorts, TikTok-подобные видео, мемы, танцы, трендовые сцены, промо-вставки. Для этого особенно удобны image-to-video и Motion Control. У Imagify на странице Kling Motion Control прямо показаны идеи вроде трендовых танцев и коротких клипов.

Видео из фото. Это формат для архивных снимков, портретов, сторис, поздравлений, карточек персон, блоговых постов, памятных роликов. Для этого подходит отдельный раздел «Оживить фото ИИ».

Рекламные и товарные ролики. AI-видео помогает оживить упаковку, показать товар в движении, собрать быстрый рекламный прототип или креатив для запуска тестов.

Имиджевые и презентационные видео. Такие ролики используют в корпоративных презентациях, личных проектах, портфолио, промо-материалах, обложках, визуализациях идей для клиента или команды.

Концепт-видео и mood videos. Когда еще нет полноценной съемки, нейросеть позволяет показать атмосферу будущего ролика, настроение, композицию кадра, цвет, ритм и базовую динамику.

Где использовать ИИ-видео

Использование AI-видео быстро вышло за пределы развлекательного контента. Сегодня нейросеть для видео можно применять в маркетинге, SMM, e-commerce, образовании, креативных индустриях и личных проектах.

В бизнесе это полезно для рекламных тестов, тизеров, презентаций, продуктовых анимаций и визуализации идей без долгой подготовки.

В соцсетях — для клипов, заставок, сторис, постов и коротких промо.

В онлайн-магазинах — чтобы оживлять фото товаров и делать карточки более динамичными. В личных проектах — для поздравлений, творчества, семейных роликов, анимации изображений и контента для блогов.

Бесплатные сервисы для создания видео: можно ли сделать ИИ-видео бесплатно

Запросы вида «создать видео ИИ бесплатно», «нейросеть для генерации видео бесплатно», «бесплатный AI генератор видео», — одни из самых массовых. Но здесь важно понимать: полностью бесплатная генерация видео обычно ограничена.

Чаще всего бесплатные тарифы дают:

- ограниченное число генераций;

- невысокое разрешение;

- очередь на обработку;

- водяные знаки;

- короткую длину ролика;

- урезанный выбор моделей.

Для пользователей из России плюсом выглядит именно удобство доступа и оплаты в рублях, а не обещание «безусловно бесплатной» генерации без ограничений.

Поэтому честный ответ такой: создать видео с помощью нейросети бесплатно иногда можно для теста, но если нужен стабильный результат, нормальное качество, несколько итераций и работа без лишних ограничений, обычно приходится переходить на платный формат.

Какую нейросеть лучше всего брать

Универсально лучшей модели для всех задач нет. Выбирать нужно по сценарию.

Если вам нужно создать видео по тексту, логично смотреть на модели и сервисы, где text-to-video является основным сценарием. На Imagify это явно реализовано для Veo 3.1 и Grok Imagine.

Если ваша задача — сделать видео из фото нейросетью, оживить портрет, получить мягкое движение камеры, добавить мимику или динамику, лучше подходят image-to-video сценарии и специальные режимы оживления фото. У Imagify для этого есть отдельный инструмент и связанные страницы.

Если нужен перенос движений, танцы, тренды, ролики с понятной кинематикой, сильнее всего смотрится Kling Motion Control, потому что там движение задается через референсное видео, а не придумывается моделью с нуля.

Если нужен практичный вывод для статьи, его можно сформулировать так:

- для текста в видео — смотрите Veo / Grok;

- для видео из фото — image-to-video и оживление фото;

- для трендовых роликов и переноса движений — Kling Motion Control;

- если хочется один вход в несколько сценариев — удобнее тестировать через Imagify.ru, где эти режимы уже собраны вместе.

Законность и авторские права

Тема авторских прав в AI-видео требует аккуратности. На практике важно разделять несколько вещей: права на исходные материалы, права на музыку, права на изображения людей, товарные знаки и условия использования конкретного сервиса.

Безопасный подход такой:

- использовать свои фото, изображения и референсы либо материалы, на которые у вас есть право;

- не загружать чужой защищенный контент без разрешения;

- не использовать реальные лица, бренды и узнаваемые объекты в коммерческом контенте без проверки прав;

- отдельно проверять музыку, озвучку, логотипы и стоковые элементы;

- перед рекламным запуском уточнять юридические ограничения для своей страны и площадки размещения.

То есть ИИ не отменяет авторское право. Он только меняет способ создания контента.

Полезные промпты для работы с видео и лайфхаки

Качество результата в AI video generation очень сильно зависит от промпта. Чем конкретнее и чище запрос, тем выше шанс получить хороший ролик.

Что писать в промпте

Лучше всего указывать:

- кто в кадре;

- что он делает;

- где происходит сцена;

- стиль;

- свет;

- ракурс;

- движение камеры;

- настроение;

- формат ролика.

Плохой промпт:«Сделай красивое видео»

Лучше:«Молодая девушка идет по вечерней улице Токио, неоновые вывески, мокрый асфальт после дождя, cinematic, slow motion, camera tracking shot, realistic lighting, shallow depth of field, high detail»

Промпт для видео из фото

«Анимируй портрет: легкий поворот головы, естественное моргание, мягкое дыхание, едва заметное движение волос, cinematic portrait, natural skin texture, soft light»

Промпт для рекламного ролика

«Современный премиальный флакон духов на темном фоне, мягкий контровой свет, вращение камеры вокруг объекта, частицы пыли в воздухе, luxury commercial style, macro details»

Промпт для вертикального короткого видео

«Vertical 9:16 social media video, energetic movement, trendy aesthetic, dynamic camera motion, bright lighting, fast pacing, attention-grabbing first second»

Лайфхаки

Первый лайфхак — не перегружать сцену. Если в одном промпте десять действий, три персонажа, смена локаций и сложная драматургия, результат обычно хуже.

Второй лайфхак — задавать движение отдельно. Для роликов с управляемой кинематикой лучше подходят режимы типа Motion Control, где движение можно опереть на референс.

Третий лайфхак — делать несколько итераций. В AI-видео редко побеждает самый длинный промпт. Чаще побеждает наиболее точный.

Четвертый лайфхак — заранее понимать площадку. Если ролик нужен для Reels, лучше сразу думать вертикально и делать короткую, цепляющую первую секунду.

Часто задаваемые вопросы

Какая нейросеть для создания видео лучше всего?

Зависит от задачи. Для text-to-video подойдут модели вроде Veo 3.1 и Grok Imagine, для переноса движений — Kling Motion Control, для оживления изображений — image-to-video и специальные режимы анимации фото. На Imagify эти сценарии разнесены по отдельным инструментам.

Можно ли создать видео ИИ бесплатно?

Иногда можно протестировать сервис бесплатно или с минимальным лимитом, но полноценная генерация высокого качества обычно упирается в ограничения тарифа, длины ролика, очереди или доступных моделей.

Какая нейросеть делает видео из фото?

Для этого подходят image-to-video сценарии, оживление фото и Motion Control. На Imagify есть и отдельное «Оживить фото ИИ», и Kling Motion Control для фото + видео-референса.

Можно ли улучшить качество видео нейросетью?

Да, такие задачи существуют, но это уже ближе к AI-upscaling, улучшению резкости, кадровой интерполяции и постобработке. Не все генераторы видео одинаково сильны именно в улучшении уже готового ролика.

Есть ли ИИ для видео на русском?

Да, для русскоязычных пользователей важны удобный интерфейс, понятные сценарии и оплата из России.

Итоги

Если говорить о практическом выборе, то лучший вариант — не искать одну «магическую» нейросеть на все случаи, а подбирать инструмент под задачу. Для текста в видео нужен один подход, для видео из фото — другой, для управляемого движения — третий. В этом смысле Imagify.ru удобен тем, что собирает в одном месте несколько актуальных сценариев: Veo 3.1, Grok Imagine, оживление фото, Kling Motion Control, идеи для видео и понятный доступ для пользователей из России.

Итоговый вывод простой: ИИ для создания видео — уже рабочий инструмент для контента, маркетинга, блогинга и визуализации идей. А чтобы старт был быстрее и понятнее, удобнее использовать сервис, где несколько моделей и сценариев уже собраны в одном интерфейсе.