Как оживить фото в Kling Motion Control: подробное руководство

Среди популярных видеосервисов появился еще один заметный инструмент — Kling Motion Control. Разберем, в чем сильные стороны этого ИИ, и посмотрим, как начать работать с ним всего за пять простых шагов.

Что это за сервис и чем он отличается от аналогов

В отличие от многих других нейросетей, которые генерируют видео с нуля, Kling дает пользователю гораздо больше контроля и помогает добиваться более реалистичной картинки благодаря немного другому подходу. Он не создает ролик полностью самостоятельно, а использует уже готовые клипы как основу и переносит движения из видео на фотографию. Такой формат отлично подходит как для оживления архивных снимков, так и для создания коммерческого контента.

В качестве отправной точки можно использовать готовый ролик: сервис распознает в нем движения и строит анимированный скелет. Затем на этот каркас накладывается персонаж или объект, который загружает пользователь.

Кроме того, ИИ поддерживает работу с текстовыми промптами. В них можно задать дополнительные параметры: поведение камеры, особенности движения и даже изменения фона.

В результате получается полноценное видео, которое учитывает ваши настройки и позволяет контролировать даже мелкие детали — и этим до сих пор могут похвастаться далеко не все, даже самые продвинутые решения от других разработчиков.

Где пригодится сервис: от оживления фото до роликов для соцсетей

Главное преимущество ИИ от Kling в том, что создание видео можно буквально поставить на поток и стабильно получать качественный результат всего за пару кликов. Важно лишь использовать хорошие исходники.

За счет особенностей модели сервис особенно удобен для повторяющихся задач и быстрой работы с уже существующими форматами. Вот несколько примеров, где Motion Control будет особенно полезен:

- Создание мемов и актуальных роликов для соцсетей.

- Разработка корпоративного стиля с фирменными персонажами в разных сценариях.

- Съемка товаров в динамичных сценах.

- Оживление фотографий с помощью ИИ, включая исторические и семейные архивы.

- Создание видео из изображений для рекламы, блогов и презентаций.

- Подбор или замена актеров, костюмов и декораций для съемок.

Как работает Kling Motion Control

Motion Control внимательно анализирует исходное видео, определяет ключевые точки в скелете персонажа и отслеживает, как они меняются в движении.

Модель разбирает анатомию объекта на изображении и находит точки, которые можно сопоставить с уже знакомой ей структурой. Например, сервис определяет положение конечностей, их взаимосвязь и отслеживает мимику лица.

После этого Motion Control выделяет объект, на который переносится модель движения из оригинального видео. В сам процесс переноса входят не только движения тела, но и работа губ, глаз и другой мимики. Благодаря этому лицо персонажа сразу синхронизируется с тем, что звучит в аудиодорожке.

Как создать видео с помощью Kling Motion Control

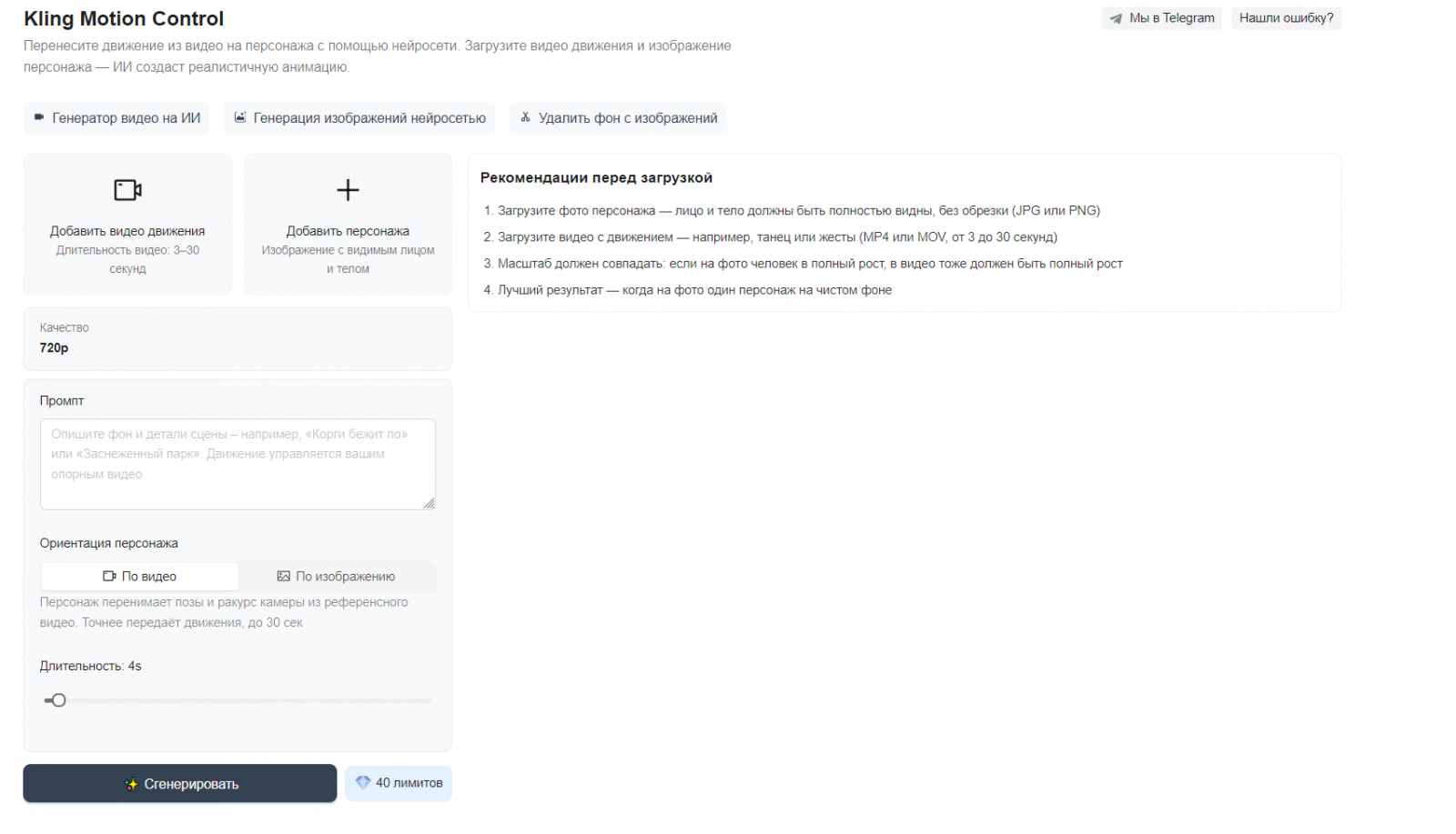

Kling — зарубежная нейросеть, для работы с которой нужен платный доступ и стабильное интернет-соединение. Для части пользователей из России это может стать проблемой: не у всех есть возможность или желание оплачивать сервисы за границей.

В таком случае можно воспользоваться альтернативой — инструментом для генерации видео на базе Motion Control. Его можно оплатить российской картой, поэтому он подойдет тем, кто хочет работать с ИИ без лишних сложностей и обходных решений.

Разберем, как работать с Motion Control, на примере популярного тренда из соцсетей — видео с танцующей собачкой.

Что понадобится перед началом

Для работы в Motion Control нужны три вещи:

- Исходное видео.

- Изображение, которое нужно оживить.

- Текстовый промпт с инструкциями.

Видео выступает основой: из него ИИ считывает движения и общую динамику камеры. Изображение — это база, на которую Motion Control переносит полученную математическую модель. А промпт помогает уточнить детали и повлиять на итоговый результат.

Пошаговый процесс создания видео в инструменте

Motion Control — довольно гибкий инструмент, но для действительно качественного результата потребуется немного практики и понимание принципов его работы. Модель лучше всего справляется в тех случаях, когда видит объект целиком и может корректно сопоставить его геометрию, а хорошо составленный промпт помогает избежать заметных артефактов.

Шаг 1: Подготовьте исходное видео

Исходный ролик должен соответствовать нескольким требованиям:

- Формат MP4 или MOV.

- Длительность — до 30 секунд.

- Размер файла — до 10 Мб.

Видео должно быть достаточно легким, иначе сервис просто не даст его загрузить. Обычно этого можно добиться, если сократить длительность ролика или сжать его до 720p.

Важно: чтобы Motion Control смог построить максимально точную и подробную карту движений, лучше использовать видео с людьми или объектами в полный рост. Так модель сможет выделить полноценный скелет со всеми важными точками артикуляции.

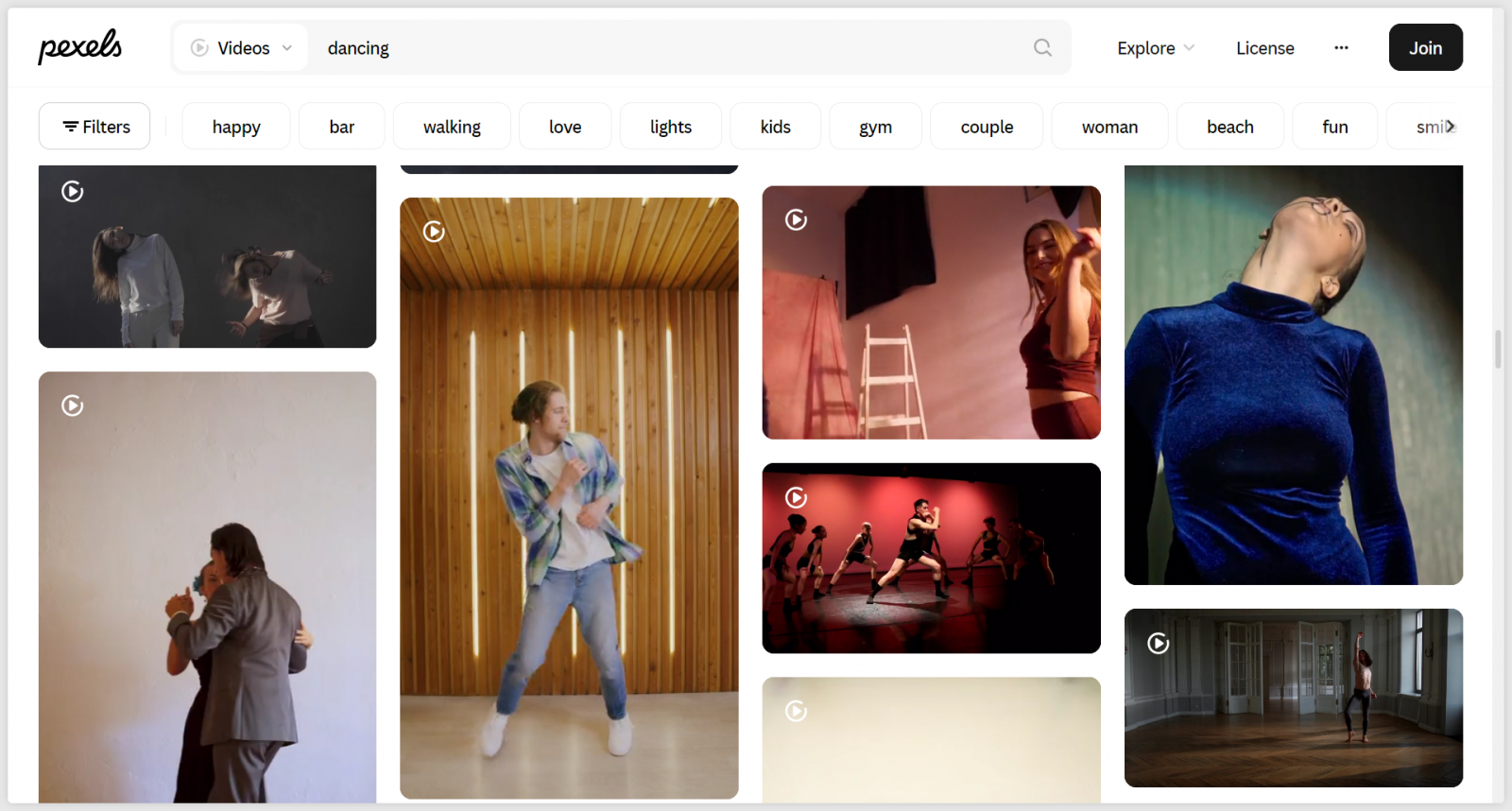

Исходное видео можно снять самостоятельно или найти на стоковых площадках, где доступны большие каталоги роликов с поиском по ключевым словам. Если вы планируете использовать готовое видео в коммерческих целях, обязательно проверьте, есть ли у выбранных материалов соответствующая лицензия. Да и для публикации в личных соцсетях тоже лучше заранее убедиться, что вы не нарушаете авторские права. Бесплатные видеостоки с открытой лицензией можно найти, например, на Pexels, Freepik и Mixkit.

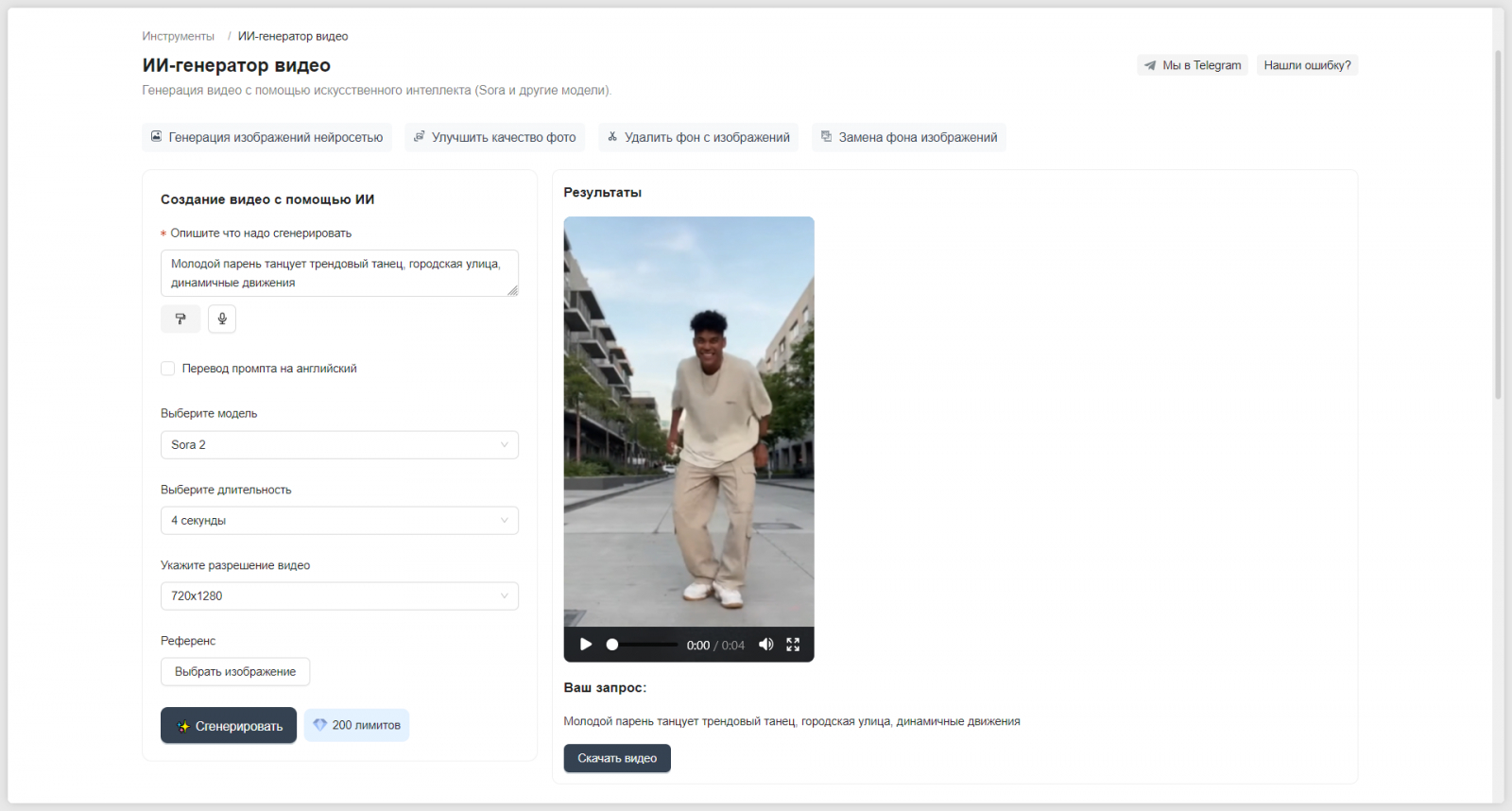

Еще один вариант — сгенерировать видео-референс с помощью ИИ. Этот способ удобен тем, что позволяет сразу получить исходник, который соответствует вашим задачам и уже близок к желаемому результату. Motion Control в связке с другим ИИ-сервисом для генерации видео дает очень сильную комбинацию: вы создаете подходящий ролик и затем используете его как шаблон для новых видео.

Для примера воспользуемся ИИ-генератором видео и создадим собственный оригинальный ролик. Ссылка на нужную страницу находится прямо в интерфейсе Motion Control, поэтому переключаться между инструментами можно быстро и удобно.

Подготовим исходник с помощью простого промпта. Нам нужен ролик с динамичным танцем на естественном фоне — именно это и укажем в инструкции, а также зададим нужные параметры видео, включая длительность и разрешение.

Исходник готов. Чтобы сохранить ролик на устройство, нажмите на него правой кнопкой мыши и выберите пункт «Сохранить видео».

Если Motion Control не загружает видео, проверьте, соответствует ли файл требованиям по размеру, длительности и разрешению. В любом редакторе можно изменить формат, обрезать лишние фрагменты и настроить качество. Для этого подойдут даже простые онлайн-сервисы, например Canva или Microsoft Clipchamp.

Шаг 2: Выберите изображение

Для изображения действует тот же базовый принцип: оптимально использовать картинку с персонажем в полный рост. Это особенно важно, если вы планируете анимировать изображение без заметных искажений в анатомии и пластике движений. Подходящие форматы файлов — JPG и PNG, и чем выше исходное качество, тем лучше.

Изображения для анимации можно взять из личного архива или найти на тех же фотостоках. Обязательно проверьте, допускает ли автор свободное использование картинки. Это особенно важно, если речь идет об известных героях, на которых распространяются не только авторские, но и права на интеллектуальную собственность.

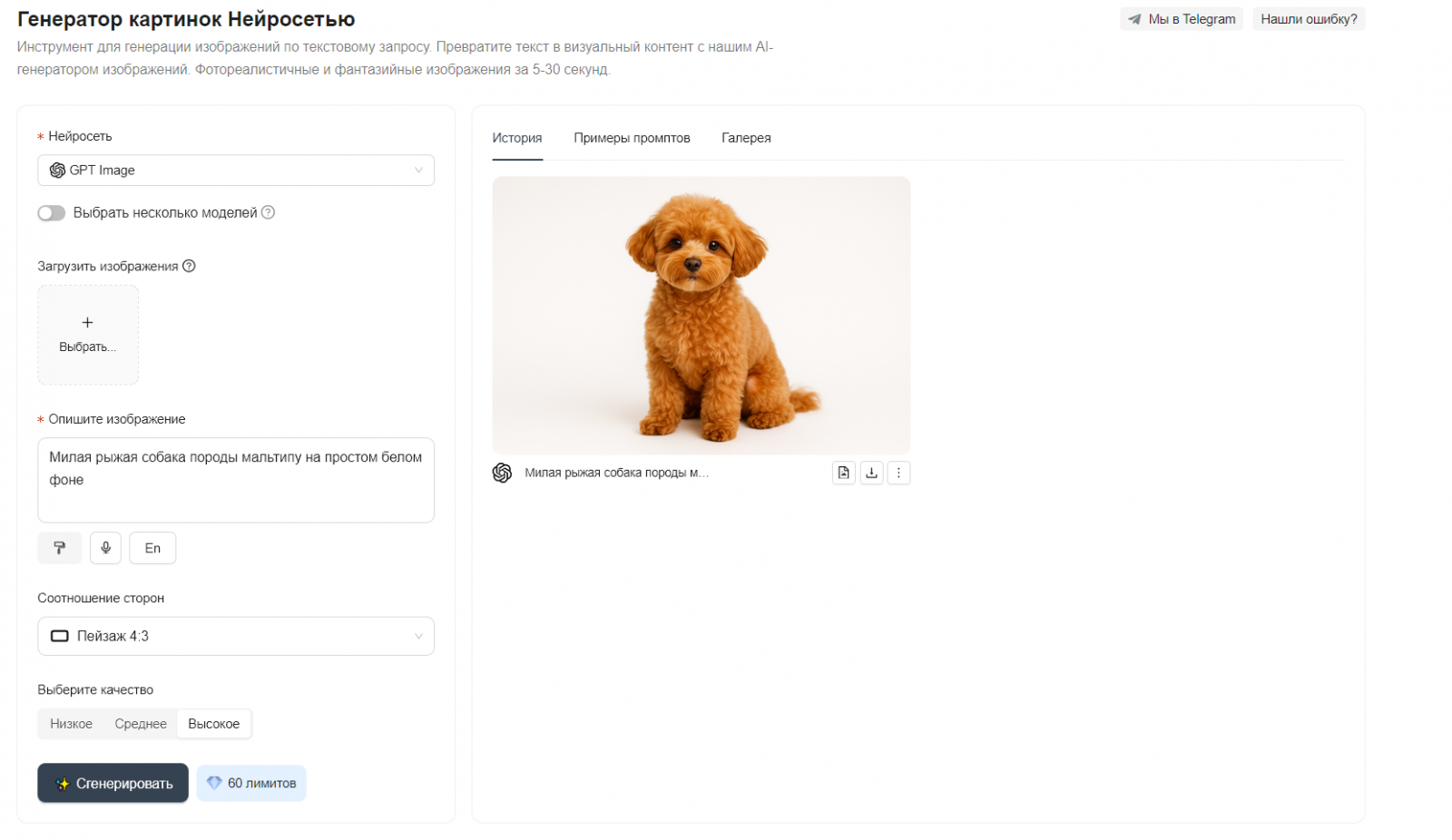

При желании изображение можно сделать самостоятельно:

- Откройте инструмент «Генерация изображений нейросетью», ссылка на него также доступна в интерфейсе Motion Control.

- Выберите ИИ-модель, соотношение сторон и нужное качество.

- Опишите, что должно быть на изображении, и нажмите «Сгенерировать».

- Откройте готовую картинку, щелкните правой кнопкой мыши и выберите «Сохранить изображение», чтобы скачать файл на устройство.

Шаг 3: Напишите промпт для Kling Motion Control

Составьте описание, которое точно передаст вашу идею с учетом выбранных настроек и возможностей инструмента. На этом этапе можно конкретизировать детали исходного материала: кто изображен на картинке и что именно должно происходить в кадре.

Важно помнить, что изменить сам характер действия не получится — Motion Control опирается на исходник и старается максимально точно ему следовать. Через промпт нельзя превратить танец в полет — в таком случае понадобится другой исходный материал.

Зато промпт позволяет управлять поведением камеры. Это особенно важно: если не задать параметры съемки, ИИ сам примет решение, а результат не всегда оказывается удачным. С помощью текста можно указать движение камеры, добавить динамику, наклон или сопровождение персонажа. Если вам нужен обычный статичный кадр, это тоже лучше сразу прописать.

Также через промпт можно повлиять на фон. Поскольку во время обработки сервис отделяет персонажа от остальной части изображения, можно попробовать заменить окружение. Это особенно полезно, если объект изначально находится на пустом однотонном фоне, а вам хочется сделать видео более объемным и глубоким.

Шаг 4: Выберите ориентацию и длительность

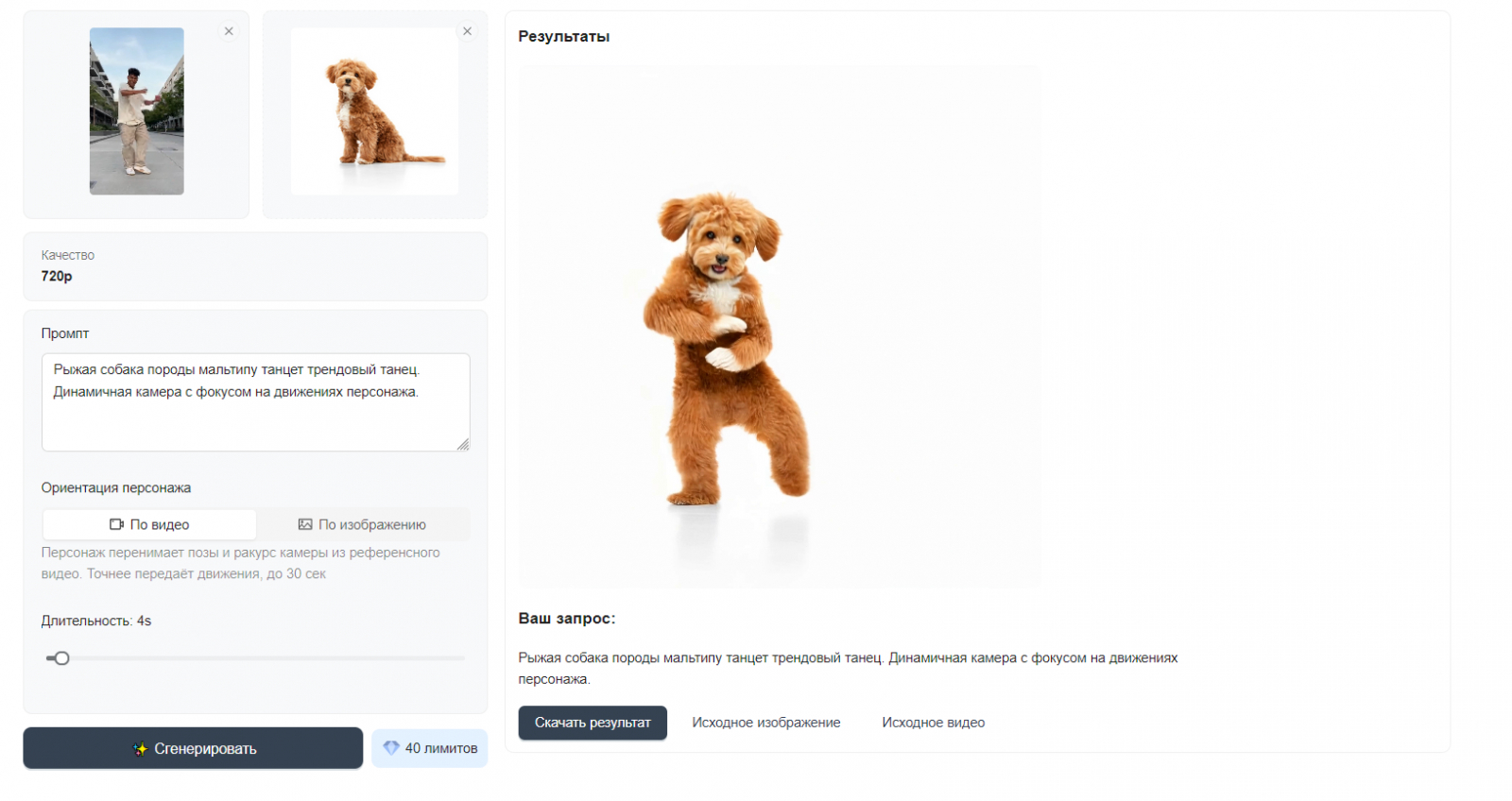

От ориентации персонажа зависит, как Motion Control будет совмещать карту движения из видео с анатомией объекта на фотографии. В нашем примере собака должна повторять движения человека в танце, и это может вызвать определенные трудности.

Чтобы точно перенести движения танцора при ориентации на видео, ИИ придется в каком-то смысле «очеловечить» собаку. Из-за этого могут появиться неестественные деформации — например, слишком длинные лапы или изгибы, которые собакам обычно не свойственны. Но в данном случае реалистичность не является главной целью, поэтому на такие нюансы можно не обращать особого внимания.

Если выбрать ориентацию на фото, Motion Control, наоборот, постарается сохранить более естественное поведение и заставит собаку двигаться так, как могло бы двигаться настоящее животное. Но здесь может пострадать цельность анимации: не все точки будут корректно совмещаться, движения могут стать слишком резкими, а в отдельных кадрах у собаки способны появиться лишняя лапа или второй хвост.

Еще один технический параметр — это длительность. Модель поддерживает ролики до 10 секунд при ориентации на фото и до 30 секунд при ориентации на видео. Здесь многое зависит от длины исходного материала: если движения в ролике равномерные на всем протяжении, можно успешно сгенерировать и более длинное видео. Но лучше всего ИИ обычно показывает себя в коротких фрагментах — стандартным вариантом считаются 4-5 секунд. За такой промежуток времени обычно не успевают проявиться ошибки и артефакты, которые иногда возникают в работе нейросетей.

Шаг 5: Сгенерируйте видео и оцените результат

Убедимся, что все настроено правильно: исходные фото и видео загружены, промпт написан, ориентация и длительность выбраны. Значит, ролик можно отправлять в обработку. Нажмите «Сгенерировать» и немного подождите — обычно это занимает от нескольких секунд до пары минут.

Для примера мы взяли фотографию мальтипу на белом фоне. Так инструменту проще хорошо рассмотреть персонажа и аккуратно отделить его от окружающего пространства. Однако в таком виде ролик выглядит немного однообразно.

Давайте слегка доработаем промпт и добавим в него несколько деталей из исходного видео: пусть собака танцует на городской улице, а на заднем плане будут деревья и дома.

После генерации результат обязательно стоит проверить. Посмотрите, насколько ролик соответствует вашей задумке, нет ли заметных ошибок, нарушений логики или сбоев в последовательности анимации. Если что-то вышло не так, это можно исправить: скорректируйте промпт или попробуйте использовать другой исходник.

Как писать промпты для генерации видео

Основную часть работы Motion Control выполняет, опираясь на загруженные файлы. Но качественный текстовый промпт помогает ИИ точнее понять и содержание видео, и то, какой результат вы хотите получить.

Сосредотачивайтесь на визуальной части, а не только на действиях. Важно описывать, что именно должно появиться в итоговом ролике: особенности персонажа, окружение, атмосферу и другие детали. Движения Motion Control все равно распознает и обработает, но при необходимости их тоже можно уточнить, чтобы повысить точность результата.

Мыслите как режиссер. В промпте можно задать параметры камеры, настроить освещение и повлиять на качество изображения. Чем точнее вы опишете кадр и ключевые акценты, тем проще нейросети будет понять, на что нужно обратить особое внимание.

Используйте простой и понятный язык. Хотя в ответах ИИ может звучать довольно витиевато, сами модели хуже воспринимают расплывчатые инструкции и слишком образные формулировки — из-за этого результат бывает непредсказуемым. Лучше говорить на понятном для модели языке: «мягкий кинематографичный свет», «качество 4K», «детализированная текстура шерсти». Так инструменту будет легче соотнести запрос с известными ему данными и точнее выполнить задачу.

Иногда полезно перевести промпт на английский. Несмотря на то, что большинство ИИ уже умеют работать с разными языками, порой им все же не хватает словарного запаса. В таком случае часть инструкций может потеряться из-за незнакомых слов или случайных опечаток. Если инструмент упорно игнорирует какие-то команды, попробуйте продублировать их на английском или перевести весь текст целиком.

Типичные ошибки при генерации видео и способы их избежать

Как и у любой нейросети, у ИИ от Kling есть свои ограничения. Если не учитывать их в работе, итоговое видео может сильно отличаться от ожидаемого результата. Чтобы не столкнуться с серьезными ошибками и не тратить лишние ресурсы, важно заранее понимать, чего лучше избегать в Motion Control.

Ошибка 1: Слишком много действий

Motion Control строит анимированную модель на базе понятных движений персонажа. Если в ролике будет много людей, и каждый одновременно начнет бежать, прыгать и активно размахивать руками, на выходе получится трудно читаемая смесь движений. Такой результат почти невозможно корректно перенести на изображение, поэтому финальное видео, скорее всего, окажется хаотичным.

Лучше всего, когда в кадре один герой, чьи движения нейросеть и анализирует. Идеальный вариант — одно действие или хотя бы ясная и логичная последовательность движений. Резкие смены действий могут негативно сказаться на работе математической модели. Если по задумке в видео должно быть несколько персонажей с разными действиями, разумнее сначала создать отдельные кадры с каждым из них, а затем собрать все в один ролик.

Ошибка 2: Неподходящие исходные материалы

Очень часто основные сложности начинаются именно с исходников. Чтобы перенос движений сработал корректно, видео и изображение должны быть примерно одного типа — например, оба персонажа показаны в полный рост или оба сняты крупным планом. Важно, чтобы анимационный скелет естественно накладывался на анатомию итогового объекта, иначе движения могут получиться странными и непредсказуемыми.

Ошибка 3: Сырой промпт

Если у вас простое видео и понятное исходное изображение, иногда можно обойтись без слишком подробного промпта. Но если вы хотите получить ролик, который сможет достойно представить ваш бизнес или творческий проект, текстовой части стоит уделить внимание.

Когда нейросеть не получает четких указаний, она начинает додумывать детали сама. В случае с Motion Control это может привести к лишним движениям камеры или, наоборот, к слишком статичной и невыразительной съемке. Без хорошо продуманного промпта сложнее управлять мелкими деталями, менять фон и задавать нужное настроение.

Ошибка 4: Слишком яркие эмоции

Важно, чтобы совпадала не только анатомия персонажа, но и мимика. Нейросети будет непросто корректно передать выражение лица из видео, если на исходной картинке герой уже широко улыбается или демонстрирует сильную эмоцию. Для стартового изображения лучше выбирать фото с нейтральным выражением лица — это универсальная основа для дальнейших изменений. Движения губ, глаз и повороты головы лучше оставить на стороне исходного видео.

Kling Motion Control любят за понятный интерфейс и предсказуемый результат, особенно если нужно анимировать изображение или быстро собрать короткий ролик. Попробуйте этот ИИ: работать с ним проще, чем кажется!