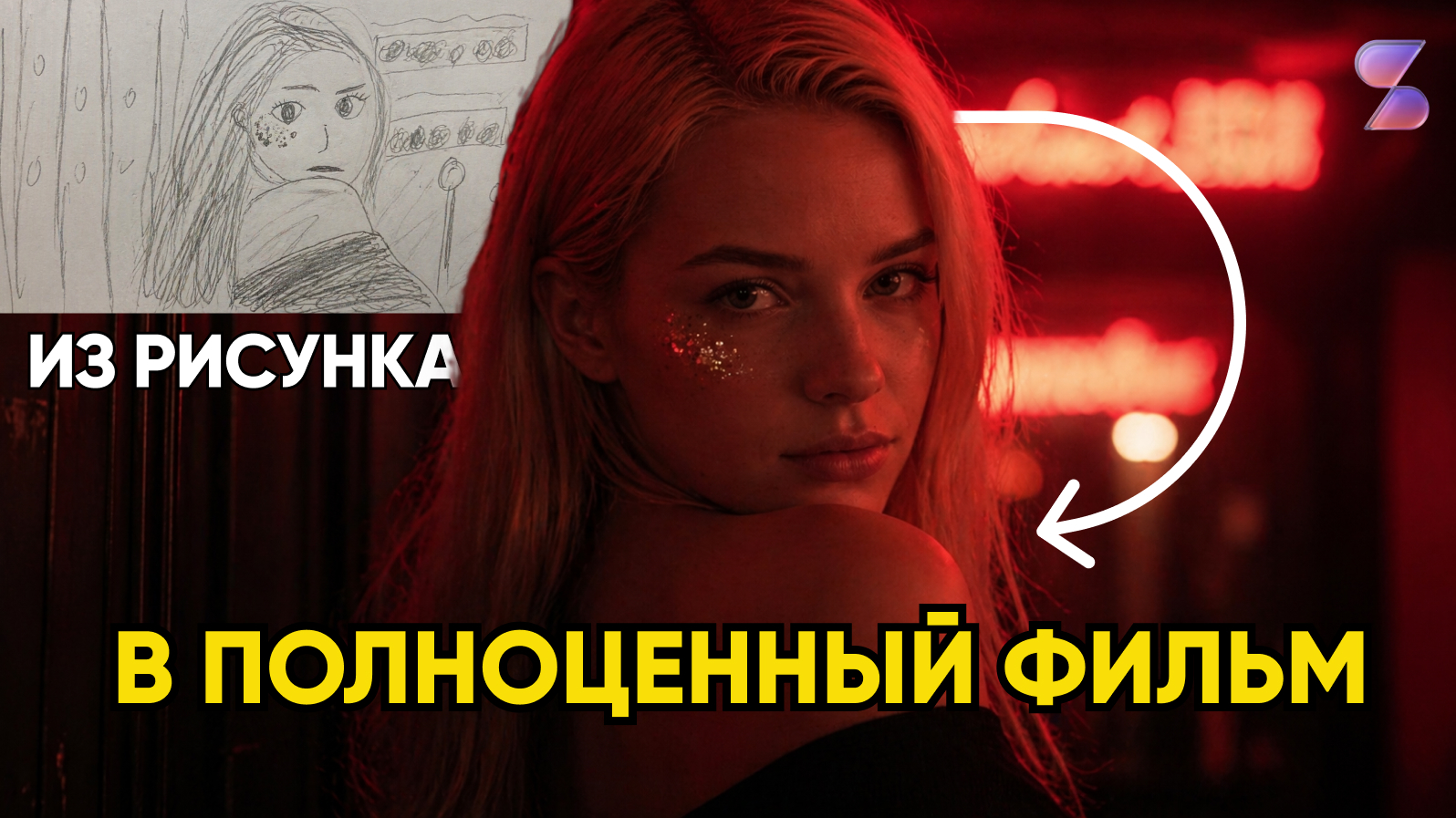

Как оживить фото или рисунок в нейросети и получить видео в SpeShu.AI

Раньше путь от идеи на салфетке до полноценного ролика занимал недели работы студии графики. Сегодня нейросети позволяют «оживить» бумажный набросок за пару минут. Это не просто фильтр — это генерация фильма на основе ваших рисунков и композиции.

От скетча к кинокадру: рабочая связка инструментов

Главная фишка топовых моделей — функция Image-to-Video. Вы даете нейросети визуальную опору (ваш рисунок), и она использует его как «скелет» для будущей сцены.

Нейросеть для изображений (Midjourney или Flux): На этом этапе мы превращаем карандашные линии в детализированный арт. Если на бумаге был человек в плаще на фоне гор, нейросеть картинки сделает из этого фотореалистичный кадр, сохранив ракурс, позу и добавит освещение (если вы это пропишете).

Нейросеть видео (Kling, Veo 3 или Runway Gen-3): Загружаем готовый арт и задаем динамику. Здесь важно прописать не только движение героя, но и работу камеры. Например, cinematic slow motion или handheld camera shake добавят ролику жизни и избавят от ощущения «пластиковой» анимации.

Контроль движения (Motion Brush): В продвинутых инструментах можно буквально «закрасить» кистью ту часть рисунка, которая должна двигаться (например, только дым из трубы или только волосы), оставляя остальной кадр стабильным.

Технические нюансы для профи

Чтобы получить не просто 5-секундную гифку, а короткометражку, нужно работать по принципу раскадровки. Вы рисуете несколько ключевых фаз движения, прогоняете их через нейросети для изображений, а затем анимируете каждую по отдельности.

Нейросеть фото и видео: как добиться реализма. Основная проблема — «эффект мультика». Чтобы видео выглядело как серьезный продакшен, используйте промпты, имитирующие реальную оптику: 35mm lens, shot on Kodak, natural lighting. Чем больше «косяков» реальной камеры вы добавите (блики, зерно, расфокус), тем меньше видео будет казаться сгенерированным.

Нейросети для контент-мейкеров теперь позволяют делать «липсинк» (синхронизацию губ) прямо поверх сгенерированного видео, что превращает немой ролик в полноценную сцену из фильма.

Где все это собрать, не потратив огромный бюджет

Работать с таким стеком технологий сложно из-за «зоопарка» подписок. Одно видео хорошо делает Kling, другое — Luma, а фото-референсы лучше брать в Midjourney.

Для тех, кто не хочет плодить десятки аккаунтов и возиться с оплатой зарубежными картами, существует агрегатор нейросетей SpeShu.AI. Это единое окно, где собраны более 300 топовых моделей. Вы создаете базу для кадра в одной модели и тут же, не переключая вкладки, отправляете её в видео-генератор. Сервис сам подбирает оптимальные настройки, чтобы на выходе получалась чистая картинка без артефактов. Это доступ ко всему мировому ИИ-продакшену в одном интерфейсе.