Seedance 2.0 в России: как пользоваться нейросетью для видео

Среди сервисов для AI-видео Seedance 2.0 сейчас обсуждают особенно активно. Причина понятна: модель умеет делать не просто лёгкую анимацию из картинки, а куда более сложные сцены — с движением камеры, эффектами, трансформациями и плотной динамикой внутри кадра. Для тех, кто давно следит за развитием видеонейросетей, это как минимум интересный релиз.

Но большинству важнее другое: доступен ли Seedance 2.0 в России, можно ли запускать генерации без ограничений, где он работает — на сайте или в Telegram, и насколько он вообще пригоден для реального использования, а не только для тестов. Разберём всё по порядку.

Seedance 2.0 в России: как получить доступ

Для многих это самый важный момент. Сейчас Seedance 2.0 в России доступен без танцев с бубном. Не нужно искать обходные схемы или регистрироваться на зарубежных платформах.

Нейросеть доступна в некоторых российских агрегаторах, например:

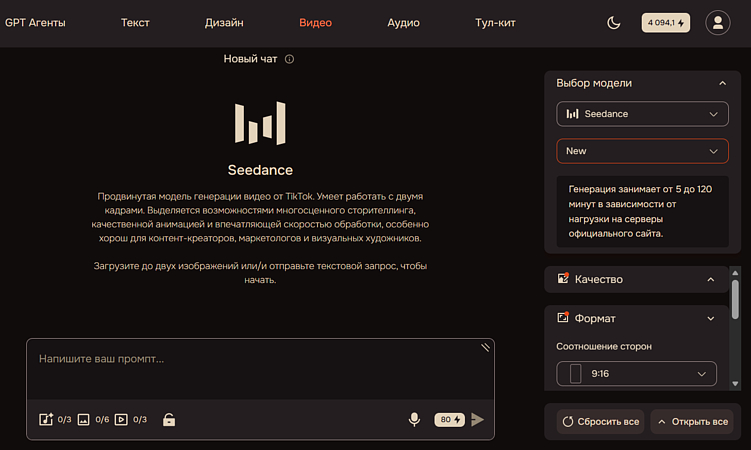

На сайте: Раздел: Видео → Seedance New

Или Telegram-бот: Путь: 🎨 Видео будущего → Seedance New

По сути, это и есть удобный способ получить доступ к Seedance 2.0 из России — быстро и без лишних барьеров.

Что представляет собой Seedance 2.0

Если не уходить в технические формулировки, Seedance 2.0 — это нейросеть для генерации видео по изображению, заточенная под динамичные и визуально насыщенные сцены. Модель берёт исходный кадр и превращает его в ролик, где важна не только плавность движения, но и общая выразительность: свет, атмосфера, эффекты, постановка камеры.

За счёт этого Сидэнс 2.0 заметно отличается от простых аниматоров, которые по сути только добавляют картинке немного движения. Здесь акцент другой: сделать ролик зрелищным, с ощущением режиссуры и визуального масштаба.

Поэтому неудивительно, что люди ищут эту модель по разным запросам:

- Seedance 2.0 в России

- доступ к Сидэнс 2.0

- Seedance 2.0 без ограничений

- Seedance 2.0 Telegram

- Seedance 2.0 сайт

- как пользоваться Seedance 2.0

- нейросеть Seedance 2.0 для видео

Почему Seedance 2.0 вызывает интерес

Видеонейросети развиваются быстро, но слабые места у них долгое время были примерно одинаковыми. Пока сцена простая, всё выглядит хорошо. Как только добавляется активное движение, световые эффекты, сложный фон или камера начинает вести себя не статично, результат часто становится нестабильным.

У Seedance 2.0 главный плюс как раз в том, что он лучше справляется с такими задачами. Не идеально, но ощутимо увереннее. Это особенно видно в сценах, где есть:

- интенсивное движение;

- групповая хореография;

- резкая смена окружения;

- частицы, свечение, дым, вода;

- сложная работа камеры;

- переходы прямо внутри одного ролика.

Если коротко: эта модель интересна тем, кто хочет получить не просто шевелящуюся картинку, а более кинематографичный результат.

Работает ли Seedance 2.0 в России

Да, Seedance 2.0 в России работает. Это один из самых частых вопросов, и здесь как раз всё довольно удобно: сервис доступен без ограничений. Сегодня им можно воспользоваться популярных агрегаторах нейросетей, на сайтах и в Телеграм.

В чём сильные стороны Seedance 2.0

У этой модели есть несколько вещей, которые особенно заметны в работе.

Более уверенная динамика

Когда в кадре происходит много движения, многие AI-видеосервисы начинают упрощать сцену или искажать детали. Seedance 2.0 лучше держит темп и структуру.

Камера ведёт себя убедительнее

Для видео очень важно не только то, что делает объект, но и как это “снято”. В Seedance 2.0 камера может выглядеть более живой: плавные пролёты, нижние ракурсы, смещения, акцент на масштабе сцены.

Эффекты смотрятся дороже

Если в кадре есть огонь, искры, дым, подсветка, модель чаще сохраняет ощущение цельности, а не превращает всё в хаотичный набор визуальных шумов.

Сцены не так легко разваливаются

Это особенно заметно в роликах, где пространство меняется, а объект должен оставаться узнаваемым и стабильно встроенным в сцену.

Кому подойдёт эта нейросеть

На практике Seedance 2.0 будет интересен не только тем, кто просто любит тестировать новые AI-инструменты.

Он может пригодиться:

- блогерам;

- SMM-специалистам;

- авторам Reels и Shorts;

- дизайнерам;

- креаторам;

- тем, кто делает рекламные ролики;

- тем, кому нужен яркий визуальный контент для социальных сетей.

Особенно хорошо модель проявляет себя там, где нужен вау-эффект: танцы, мода, световые сцены, музыкальные ролики, атмосферные видео и визуальные эксперименты.

Как получить доступ к Seedance 2.0 и запустить генерацию

Сам процесс довольно понятный. Если описать его без лишней теории, он выглядит так:

- Открываете Seedance 2.0 через сайт или Telegram.

- Загружаете исходное изображение.

- Выбираете модель 2.0.

- Включаете режим PRO.

- Ставите нужную длительность ролика.

- Пишете промпт.

- Запускаете генерацию.

На первый взгляд всё просто, но итоговый результат очень сильно зависит от двух вещей: исходной картинки и текста запроса.

Как писать промпт для Seedance 2.0

Если говорить честно, половина неудачных генераций происходит не потому, что модель плохая, а потому что запрос написан слишком расплывчато или нелогично.

Для Seedance 2.0 лучше всего работают промпты, где есть:

- кто находится в кадре;

- что именно происходит;

- где происходит действие;

- как движется камера;

- какая атмосфера и визуальная подача нужны.

То есть вместо фразы уровня «сделай красиво и динамично» лучше дать понятную сцену.

Пример рабочего запроса:

Танец в метро

A 25-year-old street dancer in voluminous, baggy jeans and an oversized, glossy, orange-red T-shirt, her braided white pigtails fluttering in the air, executes a fluid, gravity-defying turn that causes her T-shirt to emit a subtle shockwave of red bioluminescent lights, while a group of fully synchronized dancers materialize seamlessly from glowing particles to join her in an expanding, rhythmic dance. They dance inside a massive, elongated subway car. Filmed with a 35mm lens using a floating, drifting camera that glides smoothly along the floor and then drops sharply downwards, creating a dramatic angle from below to capture the breathtaking scale of the synchronized formation. Lighting is subdued and realistic, using rich, atmospheric volumetric effects, beautifully suffused with the glow of the floating lights. Hyper-realistic, cinematic film, 8K resolution, high detail.

Такие промпты полезны тем, что задают не только действие, но и операторскую логику, свет, настроение и масштаб.

Что важно знать про исходники

Если вы используете не один, а несколько референсов, каждому из них присваивается собственное имя:

- @image1

- @image2

- @image3

Это не формальность. Если в промпте не указать нужное обозначение, модель может просто не использовать часть исходных изображений так, как вы рассчитывали.

Сколько занимает генерация

Время зависит от нагрузки. И это нужно учитывать, если вам важна скорость.

Обычно:

- в дневное время генерация занимает примерно 20–60 минут;

- ближе к вечеру и ночью — 5–20 минут.

Если задача не срочная, запускать ролики вечером обычно удобнее.

Сколько задач можно ставить параллельно

Всё зависит от тарифа:

- ELITE и ULTRA ELITE позволяют запускать 2 задачи одновременно;

- PRO и VIP — по 1 задаче.

Для тех, кто делает сразу несколько креативов, это полезно учитывать заранее.

Почему Seedance 2.0 иногда блокирует изображения

Одна из особенностей модели — довольно жёсткая фильтрация реальных лиц. Если загрузить фотографию настоящего человека, система может отклонить исходник. Делается это из-за ограничений, связанных с дипфейками и безопасностью.

На практике это значит следующее:

- реальные фото проходят не всегда;

- крупные планы лица особенно рискованны;

- нейросетевые аватары и более общие ракурсы работают стабильнее.

Если вы не хотите терять время, лучше сразу подбирать исходники с учётом этого ограничения.

Есть ли у Seedance 2.0 недостатки

Да, и это нормально. Иногда модель может дать слишком активную анимацию, где-то сцена может оказаться перегруженной, а в сложных композициях всё ещё возможны артефакты. Плюс хороший результат здесь действительно требует осмысленного промпта.

Но если смотреть трезво, Seedance 2.0 всё равно выглядит одним из самых интересных решений для тех, кто ищет нейросеть для видео в России и хочет получить что-то более выразительное, чем просто базовую анимацию кадра.

Стоит ли тестировать Seedance 2.0

Если вам нужен удобный доступ к Сидэнс 2.0, важна работа без ограничений, а сама задача — делать зрелищные AI-ролики с камерой, движением и атмосферой, попробовать точно стоит.

Сегодня Seedance 2.0 — это не просто очередная нейросеть «для оживления фото», а вполне серьёзный инструмент для создания коротких, визуально насыщенных видео.