Какую аудио нейросеть выбрать в 2026 году: гид по созданию аудио из текста онлайн бесплатно

В 2026 году аудио нейросеть перестала быть игрушкой для энтузиастов. Еще недавно люди пробовали ИИ “ради интереса”: озвучить пару строк, сделать смешной трек, проверить, как робот прочитает текст. Сейчас задача другая. Нужен рабочий инструмент, который помогает быстро создать аудио из текста, озвучить ролик, собрать подложку для видео, сделать демо-песню, записать голос для рекламы или превратить обычный текст в звучащий контент без студии, диктора и долгого монтажа.

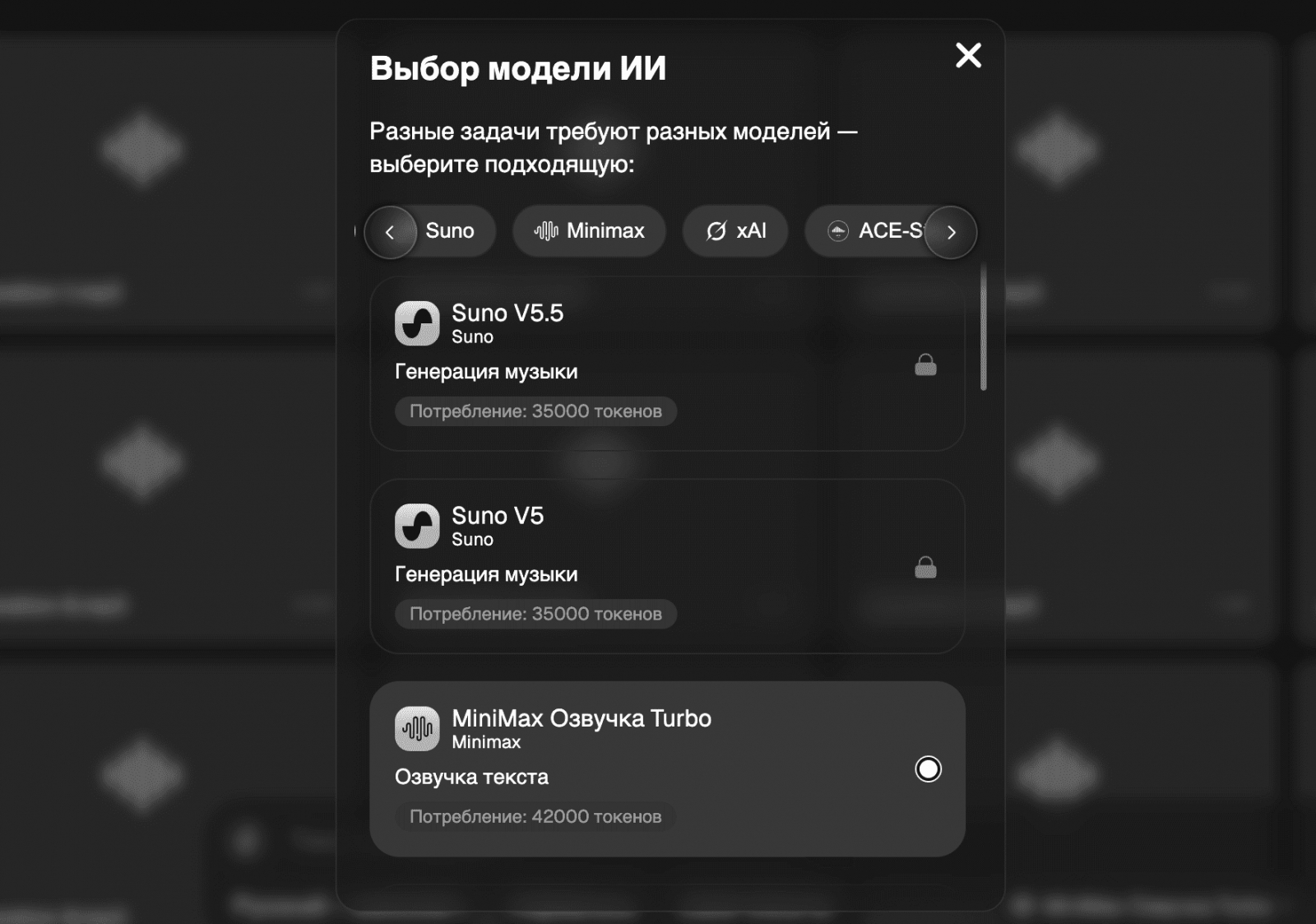

Поэтому вопрос уже звучит не так: “какая нейросеть вообще умеет делать звук”, а так: “какая нейросеть для генерации аудио лучше именно под мою задачу”. В этом гиде разбираются четыре заметных направления, которые в 2026 году чаще всего попадают в поле зрения русскоязычного пользователя: Suno, MiniMax, xAI Text to Speech и ACE-Step.

У каждого свой характер. Suno — это прежде всего музыкальная нейросеть для генерации аудио: песни, демо-треки, музыкальные идеи, джинглы, подложки. MiniMax — сильный вариант, когда нужна нейросеть для создания аудио из текста в голосовом формате. xAI Text to Speech — более современный голосовой движок для быстрых и живых озвучек. ACE-Step — уже история для тех, кто хочет больше контроля, глубже работать с музыкой и не ограничиваться браузерной кнопкой.

Аудио с помощью нейросети: почему в 2026 году выбирать нужно по задаче, а не по хайпу

Одна из самых частых ошибок — искать “лучшую аудио нейросеть вообще”. На практике такого ответа нет. Потому что человек, который хочет создать аудио из текста онлайн для озвучки статьи, и человек, который хочет музыкальный трек с вокалом, ищут два совершенно разных инструмента.

Нейросеть для создания аудио бывает трех типов

Чтобы не путаться, рынок удобнее делить на три большие категории.

Голос и озвучка

Это все, что связано с TTS, озвучкой, дикторским чтением, закадровым голосом, AI-ботами, голосовыми интерфейсами и narration-сценариями. Здесь важны:

- естественная интонация;

- паузы;

- тембр;

- скорость генерации;

- работа с русским языком;

- возможность преобразовать текст в аудио нейросеть бесплатно хотя бы в демо-режиме;

- пригодность для контента, приложений, рекламы и voiceover.

Музыка и песенная генерация

Это уже другой сегмент. Здесь важна генерация аудио из текста как композиции: куплет, припев, инструментал, вокал, жанр, настроение, настроение голоса, музыкальная форма. То есть пользователь ищет не просто “озвучку”, а нейросеть для генерации аудио из текста именно в музыкальном смысле.

Работа с готовым материалом

Есть и третий сценарий: когда нужно не только генерировать с нуля, но и:

- загрузить аудио в нейросеть;

- сделать референс;

- получить новую версию;

- клонировать стиль;

- переработать существующий звук;

- строить workflow без постоянной ручной сборки.

Именно поэтому один и тот же сервис может быть прекрасен как генератор аудио нейросеть для песен и при этом совершенно не подойти, если нужна нейросеть озвучивающая аудио для ролика на YouTube.

Что сегодня реально важно при выборе

Пользователя обычно волнуют не громкие слова “мультимодальный движок”, а понятные вещи:

- можно ли быстро создать аудио;

- насколько естественно звучит русский;

- умеет ли сервис сгенерировать аудио по тексту без роботизированной дикции;

- подходит ли он для музыки или только для голоса;

- есть ли хоть какой-то бесплатный старт;

- можно ли использовать его как нейросеть для работы с аудио, а не как одноразовую игрушку.

Почему русский язык до сих пор решает

На английском хороших решений уже много. А вот генерация аудио на русском все еще остается реальной проверкой качества. В русском важны ударения, паузы, интонация, длина слов, ритм фразы и то, насколько голос звучит естественно. Поэтому один из самых практичных тестов любой нейросети аудио онлайн — дать ей обычный русский текст и послушать, не превращается ли он в “синтезатор сообщений из банка”.

Какой сценарий у вас: озвучка, музыка или универсальный старт

Прежде чем выбирать конкретный сервис, полезно быстро ответить на один вопрос: что именно нужно на выходе?

Если нужна нейросеть для создания аудио из текста голосом

Тогда приоритет — не жанры и аранжировки, а качество речи. Важны:

- тембр;

- эмоциональность;

- плавность;

- работа с длинными абзацами;

- естественные паузы;

- возможность записать аудио нейросеть для ролика, курса, рекламы или приложения.

Здесь логичнее смотреть на MiniMax и xAI Text to Speech.

Если нужна нейросеть для генерации аудио в музыкальном формате

Если цель — трек, песня, музыкальная идея, заставка, демо, подложка, вокальная композиция, то уже нужны Suno или ACE-Step. Тут важны:

- музыкальный жанр;

- темп;

- настроение;

- качество вокала;

- логика композиции;

- возможность быстро сгенерировать аудио в виде песни, а не речи.

Если нужен понятный вход без перегруза

Бывает и так, что пользователь еще сам не знает, что именно ему подойдет. Хочется просто быстро создать аудио с помощью нейросети, проверить одну-две идеи, услышать, как вообще это работает. В таких случаях разумнее начинать с простого интерфейса без сложного техноязыка и уже потом уходить в более продвинутые системы.

Suno: когда нейросеть для генерации аудио нужна именно для музыки

Если говорить простым языком, Suno — это сервис не для “озвучить текст”, а для “сделать песню или музыкальный кусок из идеи”. Это одна из самых узнаваемых музыкальных AI-платформ, и в 2026 году она остается очень популярной именно потому, что позволяет быстро превратить описание в музыку: с вокалом, аранжировкой, настроением и структурой трека.

В русскоязычных обзорах Suno 2026 года сервис описывают как инструмент, который собирает полноценные песни с вокалом, текстом и инструменталом по текстовому запросу; отдельно подчеркивается работа на русском языке, жанровое разнообразие и возможность быстро делать музыкальные демо.

Что умеет Suno на практике

Suno хорош, если нужно:

- создать аудио из текста в виде песни;

- получить трек с вокалом;

- сделать музыкальную заставку;

- собрать демо-композицию;

- быстро проверить настроение и жанр;

- сделать основу для короткого ролика или рекламной идеи.

Если нужен сервис, где можно просто написать “энергичный поп-трек с женским вокалом про лето” и через короткое время услышать результат, Suno очень удобен.

Где Suno особенно сильный

Быстрый музыкальный результат

Главная сила Suno — низкий порог входа. Не нужно быть композитором, аранжировщиком или вокалистом. Пользователь приходит с идеей, а модель быстро превращает ее в звучащий результат. Поэтому запросы вроде сделать аудио из текста нейросеть, сгенерировать аудио из текста нейросеть в музыкальном контексте часто ведут именно сюда.

Песни, а не просто мелодии

Многие сервисы умеют сделать “фончик”. Suno интересен тем, что это уже полноценный song generator. Он работает не только как нейросеть генерирующая аудио, но как модель, которая пытается собирать законченный музыкальный результат.

Работа с русскими текстами

Suno помогает делать песни на русском и подстраивать настроение трека под сюжет. Это важный плюс для локального контента и тех, кому нужна не абстрактная “англоязычная демка”, а живая работа на русском.

Где Suno может не подойти

Если нужна дикторская озвучка текста, Suno — не лучший вариант. Он не решает задачу TTS так, как это делают специализированные голосовые движки. Это не та нейросеть для создания аудио из текста, которую логично брать для озвучки статей, интерфейсов или роликов с закадровым голосом.

Кому подойдет Suno

Suno особенно полезен:

- музыкантам-любителям;

- авторам Reels и Shorts;

- блогерам;

- тем, кто делает музыкальные заставки;

- тем, кому нужна генерация аудио из текста онлайн в музыкальном формате;

- тем, кто хочет быстро сгенерировать аудио нейросеть и услышать песню, а не просто речь.

MiniMax: нейросеть для создания аудио из текста, если нужен голос, а не песня

MiniMax — это уже не музыкальный генератор, а сильный TTS-инструмент. В актуальных русскоязычных материалах его регулярно выделяют как удачный сервис для озвучки текста, где хороши скорость, количество голосов, эмоции и общая “человечность” речи.

Что MiniMax делает лучше всего

MiniMax хорош, если нужно:

- создать аудио из текста онлайн в виде озвучки;

- сделать голос для рекламного ролика;

- озвучить статью, презентацию, видеоурок;

- получить voiceover под монтаж;

- записать аудио с помощью нейросети для приложения или голосового бота;

- работать с TTS на русском языке.

Почему MiniMax часто нравится больше простых озвучек

Голос звучит живее

Если сравнивать с простыми “робот-читателями”, MiniMax заметно выигрывает. У него лучше интонация, более естественные паузы, меньше ощущения, что текст читает синтезатор прошлого поколения. Поэтому когда пользователь ищет озвучка аудио нейросеть, нейросеть озвучивающая аудио, преобразовать текст в аудио нейросеть бесплатно или нейросеть создать аудио по тексту, MiniMax — очень логичный кандидат.

Подходит для длинных фрагментов

Одна из частых проблем дешевых TTS-решений — на короткой фразе все хорошо, а на длинном абзаце речь разваливается. MiniMax как раз интересен тем, что подходит и для более длинной озвучки: объясняющих роликов, narrated-контента, образовательных форматов.

Сильный вариант для русского языка

В публичных русскоязычных страницах MiniMax отдельно продвигается синтез речи на русском с естественными голосами. А в пользовательских разборах 2025–2026 годов сервис хвалят за интонацию, дыхание, паузы и студийное ощущение голоса. Это не значит, что он идеален всегда, но как нейросеть для генерации аудио из текста в голосовом смысле он очень силен.

Где MiniMax не лучший выбор

Если нужна музыка, песня, аранжировка и инструментал, это не его зона. MiniMax — про голос. Не про песенную композицию.

Для каких задач MiniMax особенно хорош

- озвучка роликов;

- voiceover для рекламы;

- озвучка презентаций;

- голос для бота;

- аудиоверсия статьи;

- генерация аудио на русском;

- создать аудио из текста бесплатно в демо-сценарии;

- сгенерировать аудио по тексту для прикладного контента.

xAI Text to Speech: современный голосовой движок для быстрых и живых озвучек

xAI Text to Speech — это интересный вариант для тех, кому нужен современный голосовой AI, но не обязательно музыкальный генератор. В русскоязычных новостях 2026 года запуск этого инструмента подавался как появление TTS-сервиса с более живыми эмоциями и поддержкой нескольких аудиоформатов. То есть это не просто “читает текст”, а пытается делать речь более выразительной.

Для чего xAI TTS подходит лучше всего

Он хорош, если нужно:

- быстро создать аудио из текста;

- получить современный voice-ответ;

- использовать TTS в интерфейсе или продукте;

- сделать голосового ассистента;

- получить закадровый голос для коротких форматов;

- создать аудио с помощью нейросети без сложного музыкального пайплайна.

Где xAI Text to Speech особенно интересен

Быстрые голосовые сценарии

Если нужен voice-first сценарий, а не музыка, xAI выглядит очень современно. Он не пытается быть “всем сразу”, а честно решает задачу перевода текста в речь.

Живая эмоциональность

На уровне позиционирования и первых русскоязычных новостей акцент был именно на живых эмоциях и выразительности. Для пользователя это значит простую вещь: если запрос звучит как создать аудио из текста онлайн бесплатно, но важно, чтобы голос не был деревянным, xAI — логичный вариант для теста.

Подходит для голосовых продуктов

Если MiniMax часто ощущается как мощный TTS-конструктор, то xAI TTS — как современный движок для продуктовых voice-сценариев. Это важно для тех, кто мыслит не только “сделать одну озвучку”, а строит продукт, бота, голосовой интерфейс или быстрый voice-layer.

Где xAI уступает

Если нужен широкий выбор готовых голосов, много ручных параметров и очень явная TTS-ориентация под массовую озвучку контента, MiniMax может быть практичнее. Если нужна музыка — xAI TTS вообще не про это.

Кому подойдет xAI Text to Speech

- тем, кто ищет современную нейросеть для работы с аудио в голосовом формате;

- тем, кто хочет быстро сгенерировать аудио из текста нейросеть;

- тем, кто ищет свежий TTS с живой подачей;

- тем, кому не нужна музыка, а нужна речь.

ACE-Step: музыкальная нейросеть для генерации аудио, если нужен контроль и локальная свобода

ACE-Step — это уже история не про “быстро кликнул и забыл”, а про более серьезную музыкальную работу. В русскоязычных обзорах и постах 2026 года ACE-Step 1.5 описывают как мощную открытую модель для локальной генерации музыки, которая может работать без постоянной подписки, поддерживает длинные композиции, множество жанров, большое число инструментов и даже локальный запуск на относительно доступном железе.

Что делает ACE-Step особенным

ACE-Step — это не просто “еще одна музыкальная нейросеть”. Его особенность в том, что это open-source-ориентированный путь. А значит, он интересен тем, кто хочет:

- больше контроля;

- локальную работу;

- меньше зависимости от облачного интерфейса;

- эксперименты с референсами;

- более глубокий музыкальный workflow.

Для чего ACE-Step подходит лучше всего

ACE-Step особенно полезен, если нужно:

- сгенерировать аудио из текста нейросеть в музыкальном формате;

- сделать длинный музыкальный фрагмент;

- работать с жанрами и инструментами тоньше;

- загрузить аудио в нейросеть как ориентир;

- строить свой локальный pipeline;

- использовать open-source-модель вместо подписочного сервиса.

Где ACE-Step выигрывает

Локальный запуск

Это одно из самых больших преимуществ. Не каждый сервис позволяет работать так, чтобы нейросеть для генерации аудио была по-настоящему “у вас”. Для продвинутых пользователей это важнее, чем кажется. Это и гибкость, и независимость, и возможность глубже настраивать процесс.

Длинные композиции и музыкальное разнообразие

По описаниям и обзорам ACE-Step способен работать с большим количеством жанров, инструментов и длинными музыкальными кусками. Это делает его интересным не только как генератор идеи, но и как инструмент для более серьезной музыкальной работы.

Гибкость для тех, кто хочет “копнуть глубже”

Если нужен инструмент не просто “получить песню”, а “настроить, сравнить, переработать, поработать с референсом”, ACE-Step дает такой путь. В этом его реальная сила.

Где у ACE-Step есть слабые места

Самый честный момент: ACE-Step не так дружелюбен для новичка, как Suno. Кроме того, мнения по качеству вокала и жанровой стабильности расходятся. На Habr ACE-Step 1.5 хвалят как сильную локальную альтернативу Suno, а на VC можно встретить и более критичный разбор про акцент, неровный вокал и неидеальную жанровую устойчивость.

Кому подойдет ACE-Step

- тем, кто хочет open-source путь;

- тем, кому нужен музыкальный контроль;

- тем, кто хочет сделать нейросеть аудио не “кнопкой”, а инструментом;

- тем, кто работает с референсами;

- тем, кто не боится более продвинутого workflow.

Какую нейросеть выбрать в 2026 году под конкретную задачу

Теперь самое важное — не абстрактный рейтинг, а практический выбор.

Если нужна озвучка текста

Берите MiniMax или xAI Text to Speech.

MiniMax — если нужны голоса, интонации, гибкость и более “массовый” TTS.xAI TTS — если нужен современный voice-first движок для быстрых и живых сценариев.

Если нужна музыка

Берите Suno или ACE-Step.

Suno — если нужен самый понятный музыкальный старт.ACE-Step — если нужен более глубокий контроль и локальная работа.

Если нужен самый простой старт без лишней техничности

Логично начинать с понятного веб-интерфейса и уже потом уходить в узкие решения. Это снижает порог входа и помогает понять, нужен ли вообще музыкальный сценарий или нужна только озвучка.

Если нужен русский язык

Для русской озвучки логичнее тестировать MiniMax в первую очередь, потому что именно у него есть более понятная TTS-фокусировка под подобные сценарии. Для русского музыкального контента сильнее обычно ощущается Suno, особенно если нужен быстрый песенный результат.

Как писать запрос, чтобы аудио нейросеть делала результат лучше

Очень многие пользователи недополучают качество только потому, что пишут слишком общий запрос. Это работает и для голоса, и для музыки.

Если нужна озвучка

Хороший запрос должен содержать:

- стиль речи;

- скорость;

- эмоциональность;

- формат;

- задачу;

- желаемую подачу.

Слабый запрос

«Озвучь текст».

Сильный запрос

«Озвучь текст спокойным уверенным голосом, темп средний, без лишней театральности, формат — закадровый голос для короткого обучающего ролика».

Такой формат помогает создать аудио с помощью нейросети заметно лучше.

Если нужна музыка

Полезно задавать:

- жанр;

- темп;

- настроение;

- инструменты;

- наличие вокала;

- мужской или женский голос;

- тему текста;

- желаемую форму трека.

Слабый запрос

«Сделай песню».

Сильный запрос

«Создай энергичный synth-pop трек с женским вокалом, тема — ночной город и ощущение свободы, быстрый темп, яркий припев, воздушные синтезаторы, танцевальное настроение».

Это особенно хорошо работает, когда нужно сгенерировать аудио по тексту в музыкальном формате.

Если есть референсное аудио

Тогда лучше писать так:

- что в нем нравится;

- что нужно сохранить;

- что нужно изменить;

- какой жанр усилить;

- нужен ли более чистый вокал;

- нужен ли другой ритм или настроение.

Это важно там, где можно загрузить аудио в нейросеть и строить результат уже не с нуля.

Частые ошибки, которые мешают получить хороший результат

Даже сильная нейросеть для генерации аудио не спасет, если задача поставлена плохо.

Ошибка 1. Не разделять голос и музыку

Когда пользователь хочет “и песню, и озвучку, и подкаст в одном сервисе”, почти всегда получается путаница. Нужно сначала выбрать тип задачи.

Ошибка 2. Слишком общий запрос

“Сделай красиво” или “озвучь нормально” — это плохие инструкции. AI нужен контекст.

Ошибка 3. Игнорировать русский язык

Если для вас важен русский, тестировать сервис нужно именно на русском тексте, а не по общей репутации.

Ошибка 4. Ожидать идеал с первого клика

Лучший результат обычно получается после 2–3 уточнений. Это нормально.

Ошибка 5. Считать, что бесплатно всегда достаточно

Бесплатный режим хорош для тестов. Но если контент рабочий и важен результат, обычно приходится смотреть шире, чем только на цену входа.

FAQ

Какая аудио нейросеть лучше всего подходит для озвучки текста в 2026 году?

Если нужна именно речь, а не музыка, чаще всего стоит смотреть на MiniMax и xAI Text to Speech. MiniMax сильнее в TTS-логике, голосах, эмоциях и русскоязычной озвучке, а xAI интересен как современный voice-first движок с акцентом на живую подачу.

Что выбрать, если нужно создать музыкальный трек из текста?

Для музыкальных задач логичнее выбирать Suno или ACE-Step. Suno удобнее как быстрый веб-сервис для песен и демо-треков, а ACE-Step интереснее тем, кто хочет локальный запуск, референсы и более гибкий музыкальный workflow.

Можно ли создать аудио из текста онлайн бесплатно?

Да, но обычно речь идет о демо-режиме, пробных лимитах или бесплатных генерациях на старте. У разных сервисов это реализовано по-разному: где-то бесплатный старт проще, где-то сразу заметны ограничения. Для теста идеи этого обычно хватает.

Какая нейросеть для генерации аудио лучше работает на русском языке?

Для русской озвучки особенно интересно выглядит MiniMax, потому что у него есть отдельные русскоязычные TTS-страницы и акцент на естественную речь. Для музыкального русского контента чаще выбирают Suno, если нужна именно песенная генерация.

Что лучше для новичка: Suno, MiniMax, xAI TTS или ACE-Step?

Если нужен самый простой старт — лучше идти в понятный веб-интерфейс и быстро тестировать задачу. Для музыки новичку проще всего зайдет Suno, для озвучки — MiniMax. ACE-Step лучше подходит тем, кто готов глубже разбираться в процессе, а xAI TTS — тем, кому нужен современный голосовой движок под конкретные voice-сценарии.

Итог

В 2026 году вопрос “какую аудио нейросеть выбрать” уже нельзя закрыть одним названием. Слишком разные задачи решают эти сервисы.

Если нужна музыка, быстрее всего и понятнее обычно работает Suno.Если нужна голосовая озвучка, логичнее начинать с MiniMax.Если нужен современный TTS для голосовых сценариев, очень интересен xAI Text to Speech.Если нужен более глубокий музыкальный контроль и локальная свобода, стоит смотреть на ACE-Step.

А самый практичный путь почти всегда один: сначала понять, нужно ли вам создать аудио из текста, песню, голос, подложку или референсный звук. Потом быстро протестировать идею в удобном интерфейсе. И только после этого выбирать более узкий инструмент под свою задачу. Именно так аудио нейросеть перестает быть “прикольной технологией” и становится нормальным рабочим инструментом.