Создать ИИ видео: Где можно сгенерировать ролик с помощью нейросети

Представьте: утро, кофе, пустой экран — и через десять минут у вас готовый видеоролик с кинематографическим светом, плавной камерой и реалистичным движением. Без съёмочной группы, без дорогостоящего оборудования, без монтажа. Именно это умеют современные нейросети для генерации видео — превращать текст или фотографию в полноценный видеоряд, который ещё год назад потребовал бы бюджета на целую продакшн-студию. В этом гайде разберём лучшие инструменты, форматы работы, советы по промптингу и то, где можно сгенерировать видео без ограничений из России.

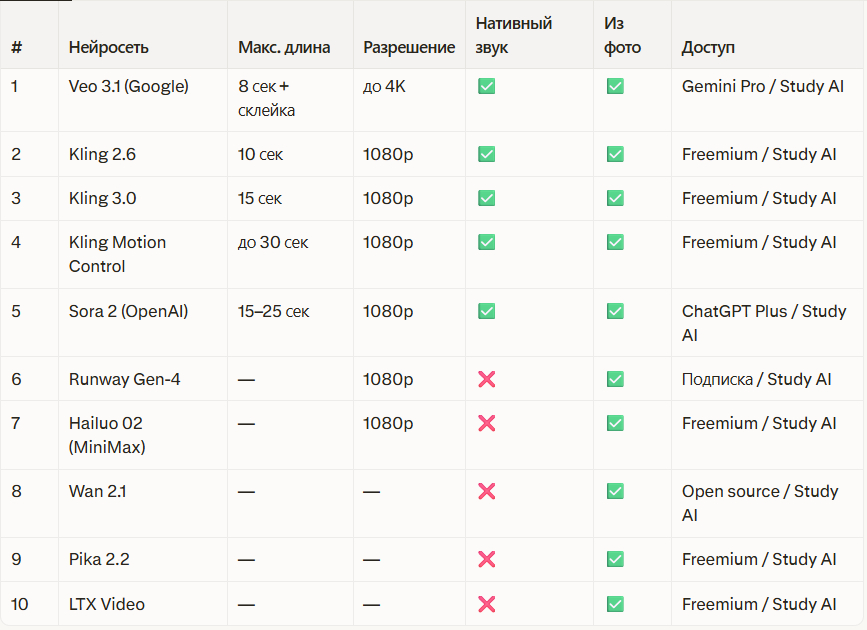

Топ нейросетей для создания видео в 2026 году

Введение: почему нейровидео — это уже не эксперимент

Ещё несколько лет назад создать видеоролик без камеры и команды казалось фантастикой. Сегодня любой ai видео генератор справляется с этим за секунды: достаточно написать текстовый промпт или загрузить фотографию. Нейровидео уже активно используется в рекламе, социальных сетях, образовании и кино — всё это стало реальным не в теории, а в повседневной практике контент-мейкеров и брендов по всему миру.

Единственное, что мешало пользователям из России воспользоваться этими инструментами, — проблема доступа. Лучшие программы ии для создания видео либо заблокированы, либо не принимают российские карты, либо работают только с иностранными аккаунтами. Study AI решил эту проблему: на платформе Study24.ai собраны все ключевые видео-нейросети мира — доступны без танцев с заменой IP-адреса, с русским интерфейсом и оплатой привычной картой в рублях.

Как работает генерация видео онлайн с помощью нейросети

Современная нейронка для создания видео работает на основе диффузионных моделей и трансформеров. Упрощённо: нейросеть обучена на миллиардах видеокадров и научилась предсказывать, как должны выглядеть следующие кадры на основе текстового или визуального описания. На входе модель получает промпт, изображение или фрагмент видео, на выходе — готовый ролик с плавным движением, достоверным светом и перспективой.

Принцип работы одинаков для всех инструментов: вы описываете сцену, задаёте параметры и запускаете генерацию. Нейросеть анализирует запрос, строит последовательность кадров и рендерит видеоряд — обычно это занимает от нескольких секунд до нескольких минут в зависимости от модели и длины ролика. Качество результата зависит от трёх вещей: точности промпта, мощности модели и настроек генерации — длительности, формата и стиля камеры.

Лучшие ИИ для создания видео: разбор каждого инструмента

Veo 3.1 — флагман от Google

Veo 3.1 — это то, что происходит, когда Google сосредотачивает весь потенциал в одной модели. Нейросеть генерирует видео с кинематографическим качеством: сложные сцены, физически достоверное движение, реалистичный свет и плавные переходы между кадрами. Промпт можно писать на русском — модель понимает его без потери качества результата.

Уникальная функция «Ingredients to Video» позволяет загрузить несколько референс-фотографий и создать видео с нужными персонажами, предметами и стилем — фактически это профессиональный ответ на вопрос как сделать ии видео из фото с контролем над каждым элементом кадра. Модель поддерживает форматы 16:9 и вертикальный 9:16 — последнее особенно удобно для Shorts и Reels. Нативная генерация звука и голоса работает прямо внутри модели, без сторонних инструментов.

Veo 3.1 особенно хороша для рекламных роликов, трейлеров, архитектурных визуализаций и любого контента, где важна детализация. Это лучший выбор, если нужен максимально убедительный визуальный ряд с первой попытки.

Где использовать: Gemini app, YouTube Create, Vertex AI, Flow — и на Study AI.

>>> Бесплатная регистрация в Veo 3.1

Kling 2.6 — точность движения и высокая скорость

Kling 2.6 от Kuaishou — одна из самых востребованных нейросетей для генерации видео среди профессионалов. Модель умеет точно передавать движение: персонажи ходят органично, жесты выглядят естественно, объекты подчиняются законам физики. Kling 2.6 обрабатывает запросы быстро и выдаёт видеоряд, который не требует длительной доработки.

Ключевые возможности: видео до 10 секунд в разрешении 1080p, нативная генерация звука по принципу «что видишь — то и слышишь» (фоновые шумы, атмосфера и эффекты генерируются вместе с картинкой). Функция Elements позволяет зафиксировать визуальный образ персонажа или объекта и переиспользовать его в разных сценах — это решает проблему консистентности, с которой сталкивается каждый, кто пробовал создать видео из фото нейросеть и получил разные лица в каждом кадре.

Kling 2.6 — надёжный выбор для регулярного производства контента: рекламных роликов, клипов и видео с повторяющимися героями, когда важно не только качество, но и скорость.

>>> Создать видео с ИИ от Kling 2.6

Kling 3.0 — следующий уровень реализма

Kling 3.0, вышедший в феврале 2026 года, сделал шаг вперёд в сторону режиссёрских инструментов и кинематографического качества. Модель значительно улучшила детализацию лиц, естественность анимации тела и расширила возможности для работы с длинными сценами. Нейросеть точнее следует текстовому описанию, лучше понимает сложные ситуации с несколькими объектами в кадре и создаёт видео с более глубоким ощущением пространства.

Главная новинка — мультишотовая генерация: за один запрос можно задать от 2 до 6 отдельных сцен, каждая со своим ракурсом, движением и настроением, итоговый ролик достигает 15 секунд. Управление камерой стало по-настоящему кинематографичным: доступны режимы pan, dolly, track и static — как в профессиональном видеопроизводстве. Если Kling 2.6 — рабочая лошадка, то Kling 3.0 — выбор для проектов, где каждый кадр должен выглядеть безупречно, и для тех, кто хочет создать видео по тексту с чёткой нарративной структурой.

>>> Создать видео в Kling 3.0 с помощью ИИ

Kling Motion Control — управление каждым движением

Kling Motion Control — отдельный инструмент внутри экосистемы Kling, который превращает генерацию видео нейросеть в нечто близкое к motion capture без студии и костюма с датчиками. Принцип прост: загружаете референс-видео от 3 до 30 секунд с нужным движением и изображение персонажа — нейросеть переносит жесты, пластику тела, мимику и микровыражения на нового героя с высокой точностью.

С помощью Motion Control можно также задать траекторию камеры, указать направление движения объектов и управлять динамикой кадра вручную. В версии Kling 3.0 Motion Control значительно улучшена стабильность лица при длинных и сложных движениях — результат приближается к студийной анимации. Нейронка для создания видео с таким уровнем контроля раньше требовала профессиональной 3D-студии. Это незаменимый инструмент для танцевального контента, боевых сцен, хореографии, рекламных съёмок и кинематографических переходов.

>>> Сделать захват движений в видео через KMC

Sora 2 — от OpenAI с сильным чувством сцены

Sora 2 от OpenAI — ai видео генератор, ориентированный на нарративный и кинематографический контент. Модель умеет удерживать контекст на протяжении всего видео: персонажи не меняются от кадра к кадру, объекты остаются на месте, атмосфера сцены сохраняется. Это делает Sora особенно ценной для коротких историй, презентационных роликов и визуализации идей — там, где нужна целостность, а не набор красивых кадров.

Технические возможности: ролики длиной от 15 до 25 секунд в разрешении 1080p, звук и диалоги синхронизируются с картинкой прямо в процессе рендера. Функция Storyboard позволяет заранее выстроить раскадровку сцен, Stitch — склеить несколько фрагментов в единый ролик до 60 секунд. Функция Cameo даёт возможность вставить себя в ролик с сохранением внешности и голоса — это один из лучших инструментов, если нужно создать видео с помощью ии с реальным человеком в кадре. Доступна через ChatGPT Plus и Pro.

>>> Попробовать бесплатную генерацию нейровидео через Sora

Другие заметные инструменты

Runway Gen-4 — популярная программа ии для создания видео с широкими возможностями редактирования. Позволяет не только создавать ролики с нуля, но и вносить правки в уже готовый видеоряд: менять фон, убирать объекты, корректировать движение. Режим Gen-4 Turbo генерирует кадры значительно быстрее конкурентов — удобно при итеративной работе. Стандарт для агентств и видеостудий, которые встраивают ИИ в существующий пайплайн продакшна.

Hailuo 02 (MiniMax) — азиатская нейросеть с отличной генерацией портретного контента. Особенно хороша для сцен с людьми: лица и мимика получаются живыми и детализированными. Делает ставку на художественность и атмосферу — ролики выходят кинематографичными даже при скромных промптах.

Wan 2.1 — открытая модель с хорошим соотношением качества и скорости генерации. Подходит для экспериментов, прототипирования и быстрых тестов идей без необходимости тратить токены на финальную версию.

Pika 2.2 — удобный инструмент для быстрой генерации коротких роликов. Популярен среди блогеров и SMM-специалистов, которые производят контент для социальных сетей в большом объёме: быстро, просто, без сложных настроек.

LTX Video — нейросеть с акцентом на стилизацию. Создаёт видео в заданной визуальной манере — от анимационного до документального стиля, отличный инструмент для создания видео с помощью ии в нестандартной эстетике.

Как создать видео по тексту с помощью ИИ

Текст-в-видео — базовый режим всех перечисленных моделей. Вы пишете описание того, что должно происходить на экране, выбираете длительность и соотношение сторон — и получаете готовый ролик. Нейронка которая делает видео из текста не подбирает архивные кадры и не монтирует готовые фрагменты: она синтезирует уникальный видеоряд с нуля, именно под ваш запрос, каждый раз новый.

Разные нейросети дают разный результат с одним и тем же промптом: Veo 3.1 акцентирует физическую достоверность и реалистичность деталей, Kling 3.0 — точность движения персонажей, Sora 2 — нарративную связность на протяжении всего ролика. Опытные пользователи часто тестируют один запрос в нескольких моделях и выбирают лучший результат — на Study AI это особенно удобно, потому что все инструменты в одном месте и на едином балансе.

Как сделать ИИ видео из фото

Создать видео из фото нейросеть умеет не менее убедительно, чем из текстового описания. Достаточно загрузить изображение и добавить короткий промпт с указанием движения: что должно ожить, как двигаться, в какую сторону. Нейросеть анализирует фотографию, распознаёт объекты и синтезирует плавную анимацию на основе визуальной информации из снимка.

Этот формат особенно востребован для оживления портретов, анимации пейзажей, создания «живых» обложек для социальных сетей и презентаций. Именно так работает режим image-to-video в Kling, Veo 3.1 и Sora: каждая из этих нейросетей поддерживает генерацию видео из фото без специальных настроек. Если нужна максимальная точность в передаче образа с фотографии в нескольких сценах подряд — Kling 2.6 с функцией Elements сохранит внешность персонажа без изменений от кадра к кадру.

Как написать промпт для генерации видео

Хороший промпт — это половина успеха в том, как создать видео с помощью ии и получить результат, близкий к задуманному. Структура работающего промпта: субъект + действие + окружение + стиль камеры + освещение.

Примеры:

- «Молодая женщина идёт по ночному городу под дождём, slow motion, cinematic tracking shot, неоновые отражения на мокром асфальте»

- «Кот смотрит в окно на падающий снег, статичная камера, тёплый мягкий свет, уютная атмосфера»

- «Дрон облетает горный пейзаж на рассвете, aerial shot, golden hour, кинематографичные цвета»

- «Бариста готовит кофе в маленьком кафе, крупный план рук, мягкий боковой свет, тихое утро»

Избегайте слишком коротких описаний — «кот на диване» даст непредсказуемый результат. Добавляйте детали движения камеры: dolly in, pan left, zoom out — это особенно важно в Kling 3.0, где управление камерой задаётся явно. Все нейросети на Study AI принимают промпты на русском языке — специального знания английского не требуется.

Как выбрать нейросеть под задачу

У каждого инструмента своя ниша, и лучший результат получается тогда, когда модель выбрана под конкретную цель.

- Вертикальный формат для Shorts и Reels → Veo 3.1

- Реклама, кино, архитектурные визуализации → Veo 3.1

- Быстрый контент с консистентным персонажем → Kling 2.6 (Elements)

- Мультишотовая сцена с управлением камерой → Kling 3.0

- Как сделать ии видео из фото максимально точно → Kling 2.6 / Veo 3.1

- Перенос танца или движения на персонажа → Kling Motion Control

- Длинный нарративный ролик с диалогами → Sora 2

- Редактирование и доработка готового видео → Runway Gen-4

- Портретный и мимический контент → Hailuo 02

- Быстрый прототип или тест идеи → Wan 2.1 / Pika 2.2

- Стилизованный контент в заданной эстетике → LTX Video

Почему лучшие ИИ для создания видео недоступны в России напрямую

Большинство топовых видео-нейросетей — американские или азиатские продукты, которые не предусматривают доступ из России на уровне платёжной инфраструктуры. Сайт открывается, но зарегистрироваться или оплатить подписку российской картой — не получится. Часть сервисов добавила прямую геоблокировку. В результате даже технически подготовленный пользователь сталкивается с барьером ещё до первой генерации.

Замена IP решает часть проблем, но не все: платёжный вопрос остаётся. Нужна карта иностранного банка, которую принимает конкретный сервис, без дополнительных комиссий и блокировок. Это стандартная история для всех топовых инструментов — от Sora до Veo 3.1, от Runway до Kling. Именно здесь Study AI закрывает проблему полностью и системно.

Study AI — где можно сгенерировать видео в России

Study24.ai — это платформа, которая решает проблему доступа не как обходной путь, а системно. Команда Study AI интегрировала официальные версии всех ключевых нейросетей в единый русскоязычный интерфейс. Вы работаете напрямую с Veo 3.1, Kling 3.0, Sora 2 или любой другой моделью — без посредников, без потери качества, без необходимости обходить блокировки.

- Без подмены IP— стабильный доступ из любой точки России, без сбоев и внезапных отключений

- Русский интерфейс — все функции переведены, поддержка отвечает на русском языке

- Российские карты — Сбербанк, Тинькофф, ВТБ, Альфа-Банк и другие

- Оплата в рублях — токены покупаются без конвертации и скрытых комиссий

- 50+ нейросетей в одном аккаунте — один баланс, один логин, всё в одном месте

- Официальные модели — те же версии нейросетей, что и у пользователей по всему миру

Study AI работает на токенной системе: вы пополняете баланс и тратите токены по мере использования. Это удобнее ежемесячных подписок, если вы работаете с нейросетями нерегулярно, и выгоднее, если используете сразу несколько инструментов. Токены не сгорают: сегодня генерируете нейровидео, завтра работаете с текстом или изображениями — баланс единый.

Как создать видео с помощью ИИ на Study AI: пошаговая инструкция

- Зарегистрируйтесь на Study AI. Регистрация занимает меньше минуты — потребуется только email. Никаких дополнительных верификаций и долгих форм.

- Пополните баланс. Выберите удобный тариф и оплатите с российской карты в рублях. Токены поступают на счёт сразу после оплаты.

- Откройте нейросеть в каталоге. Найдите нужный инструмент — Veo 3.1, Kling или Sora — и перейдите в рабочее пространство.

- Создайте первое видео. Введите промпт на русском или загрузите фото, выберите параметры и запустите генерацию. Первый ролик готов уже через несколько минут.

Часто задаваемые вопросы

Можно ли сделать ии видео бесплатно?

На Study AI доступны пробные токены для новых пользователей, но их хватает только для тестирования, например, нейросетей для генерации изображений. Для создания видео потребуется хотя бы стартовая подписка.

Как сделать ии видео из фото?

Большинство моделей поддерживают режим image-to-video: загружаете изображение, добавляете описание движения — нейросеть оживляет статичную картинку. Лучше всего с этим справляются Kling 2.6, Veo 3.1 и Sora 2.

Какая нейросеть для генерации видео лучшая в 2026 году?

Универсального победителя нет — выбор зависит от задачи. Для реализма и длинного ролика — Sora 2, для Shorts — Veo 3.1, для анимации персонажей — Kling Motion Control, для скорости — Pika 2.2 или Wan 2.1.

Как генерировать видео с помощью нейросети, если я никогда этого не делал?

Начните с Kling 2.6 — у них простой интерфейс и предсказуемый результат даже с коротким промптом. На Study AI есть русскоязычные подсказки прямо в интерфейсе.

Можно ли использовать нейровидео в коммерческих проектах?

Да, но лицензионные условия у каждого сервиса свои. Перед использованием в рекламе или продаже контента обязательно проверьте Terms of Service выбранной платформы.